曾经以为的科幻画面,在现实世界出现。

人类不能再等了,立即封印AI

6个月

。

这不是捏造的小说场景,竟然有很多科学家签名。

危言耸听,还是逆耳忠言?

是关注人类命运,还是利益驱使?

ChatGPT到底伤到了哪些人?

GPT-5真的有那么可怕?

到了给AI立法的时候了吗?

那到底如何立法呢?

3月29日

,一封引发争论的联名信发布。

信中最核心的呼吁,是

所有AI实验室

暂停

至少

6个月

研发比

GPT-4

更强大的人工智能系统。

信中有几个观点值得注意:

1、人类陷入一场

失控竞赛

,对于

更强大的AI

,没有人能理解、预测和控制。

2、只有确信AI的影响是可控的时候,才应该开发强大的

人工智能系统

。

3、从危险的竞赛中倒退到具有紧急功能的更大的不可预测的黑盒模型。

那么到底是谁在叫停AI,反对GPT-5的研发?

看一下签名的人,有许多AI科技圈的大佬。

SpaceX、Tesla&Twitter CEO:Elon Musk

图灵奖获得者:Yoshua Bengio

纽约大学教授:Gary Marcus

苹果联合创始:Steve Wozniak

…………

反对的反对:叫停AI,不如叫停马斯克

反对“反对GPT-5研发”的人又是谁?

有人支持叫停AI,就一定会有人反对叫停AI。

那么反对“反对研发GPT-5”的人又有哪些?

首先是深度学习领域的大佬

Andrew Ng

。

他很直接地表示:

联名信的想法非常糟糕。

原因在于AI应用已经为人类带来了巨大福祉,在多个领域均有很好的发展空间。

持续对GPT-4进行改进,人类还可以获得更多价值

。

对于

Andrew Ng

的说法,不少人表示赞同。

其中有

Meta数据科学家林致远,英伟达AI研究科学家Jim Fan

等人。

Facebook人工智能研究院智能围棋项目负责人的田渊栋

也表示不会签署联名信。

他在社交媒体中提到,

一旦开始,就没有办法停止或扭转这一趋势,这就是进化的必然。应该换个角度继续向前看,更好地理解 LLM,适应它并利用其力量,感受热度。

从联名信的内容上看,发起者用心良苦。

毕竟这是为了人类未来而叫停AI。

在ChatGPT出现后,就不断有这样一种声音出现:

特别是当GPT-4出现后,这种担忧进一步加强。

它的进化速度太快,以至于相关理论研究都没有跟上。

另外,GPT-4的大模型能力是基于“

涌现效应

”而来。

连

OpenAI创始人Sam Altman

也说,无法理解GPT-4的进化逻辑。

如果

人类无法预测AI

的下一步发展,不知道它未来是好是坏,那么确实应该更加

谨慎

。

但问题在于联名信提出的时间点太敏感了。

还有联名信里面提到的暂停时间“

六个月

”。

六个月能解决联名信里提到的问题吗?持悲观态度。

所以这听起来就有点像是:

在AI这条跑道上我大意了,没上车,你们先等我六个月。

等我上车了跟你们跑到同一起跑线了,AI的风险也就没有了。

所以这到底是是为了人类而反对,还是为了个人利益而反对?

并非所有科学家都反对,现在大佬们立场各异。

比如人工智能三巨头:

Yoshua Bengio、Geoffrey Hinton、Yann LeCun,

但对信中的提议态度却截然不同。

支持派:Yoshua Bengio

在这封联名信中,

最早签名

的便是

Yoshua Bengio。

虽然联名信所有人都可以签名,但对于知名的公众人物,网站都会确认其真实性。

从这方面看,Bengio应该可以算是联名信的

绝对支持者

了。

反对派:Yann LeCun

当联名信发出后,Yann LeCun很快就辟谣:

虽然没有直接说明原因,但在转发的

推特

中也能得知,Yann LeCun认为这封联名信没有任何意义,因为没有人会真正停止。

沉默派:Geoffrey Hinton

与前两位大佬不同,Geoffrey Hinton目前仍然

保持缄默

状态。

目前他没有在联名信上签名,也没有发表相关的意见。

这三人与现在ChatGPT的出现有着

千丝万缕

的联系,尤其是

底层的深度学习神经网络

,他们可以说是

ChatGPT的理论之父

。

这封公开信最终能够起到作用吗?

即便有无数人参与签名,就能暂停巨型AI的实验吗?

人类过去签署了多少次战争协议,但战争被消灭了吗?

拥核国家牵头搞“

核不扩散条约

”,但能让所有人放弃核武器吗?

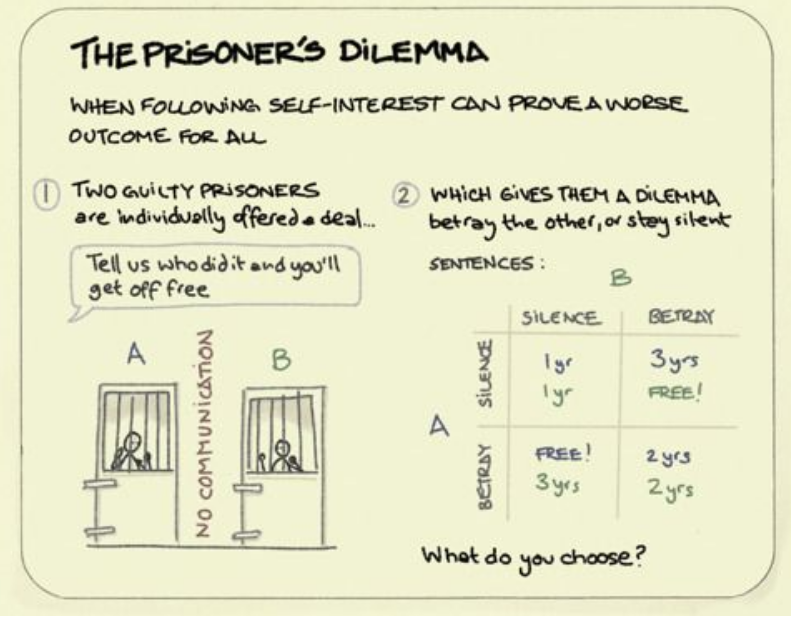

过去的历史经验告诉我们,当ChatGPT诞生的那一刻起,或者说当

人工智能大爆发

的那一刻起,人类就陷入了“

囚徒困境

”之中。

这封向世界各界呼吁的公开信,不过是AI版本的“

大模型不扩散条约

”。

在囚徒困境下,所有人都担心其他人会制造出

更强大的人工智能

。

这样就会陷入到追求更强大AI的“

军备竞赛

”,非但

不会叫停AI

,反而会

加大力度研究AI。

其实这不仅仅是“

囚徒困境

”,更是现实世界的“

黑暗森林

”。

猜疑链已经形成,对于囚徒而言,不叫停AI才是最优解。

国外Reddit论坛

上的一条评论已经能说明这一问题:

Guess who’s not gonna stop:China。

这份公开信,其实直接针对的就是正在训练的

GPT-5。

信中如是说道

:

我们呼吁所有人工智能实验室立即暂停训练比 GPT-4 更强大的人工智能系统(包括目前正在训练的 GPT-5)至少 6 个月。

矛头直指OpenAI,那么OpenAI的回应是什么?

OpenAI其实并没有直接表态,只是呼吁未来AI需要对齐。

OpenAI在官方博客中提到

:

我们的对齐研究旨在使人工智能与人类价值观保持一致并遵循人类意图。我们采用迭代的经验方法:通过尝试对齐功能强大的人工智能系统,可以了解哪些有效,哪些无效,从而提高我们使人工智能系统更安全、更一致的能力。

其实简单说OpenAI的意思是,

人类未来需要的好的AGI,是与人类对齐的AGI。

但实话实说,这句话有些让人膈应。

AI跟人类对齐

,到底是

跟谁对齐

?是跟你

Sam Altman

对齐?

如果是与AI设计者的意图对齐,就一定能保证是安全的吗?

所以也有人说,

与某些人对齐

,也就

意味着与

另外一些人不对齐

。