极客公园微信号:geekpark

机器学习

被戏称为「四大邪术」的「美图术」的强大已经告诉我们不要轻易相信别人发来的照片,至于今年火热的视频直播,更是让大家见识到了「视频美颜」的威力。

不过,今天要讲的这个名叫 Smile Vector 的聊天机器人,它可能比这些美图功能还要强大。因为借助人工智能技术,它可以将任何一张人脸图片转化成带有微笑表情的照片。

笑的不够自然?没关系,技术在进步

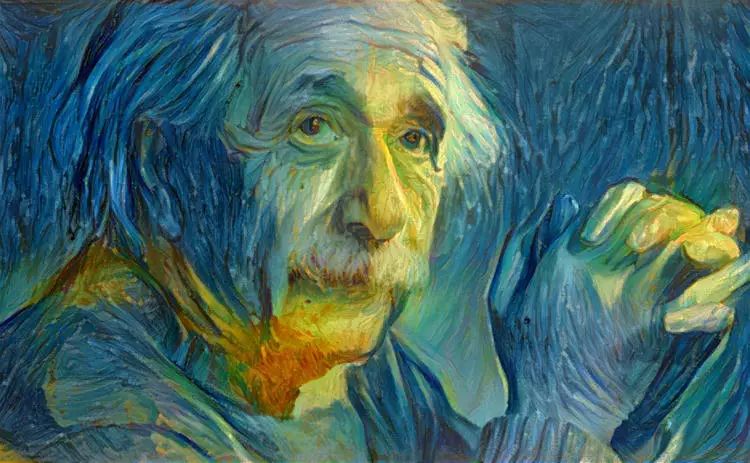

作为一个推特机器人,Smile Vector 对我们来说非常陌生,但它能做的事情却相当有趣,而且接地气。当你把任意一张带有面部表情的图片输入给它,它会通过深度学习的神经网络技术生成图片中人物微笑的表情,下面这张图片就是通过技术实现的。

看上去是不是笑的不够自然?没关系,这只是技术升级上的必经之路。Smile Vector 团队从 2015 年开始就在尝试利用图像识别来训练神经网络。在其推特账号上,我们能看到许多这样的图片。

这件事情向我们证明了什么?人类在拥有能够保存影像的技能之后,对图片的造假一直存在,而到了现在,我们甚至能够让动态图片以假乱真,并且这是由计算机技术自动实现的。

「这的的确确前进了相当大一步。」汤姆·怀特(Tom White),Smile Vector 创始人对此非常看好,「它不仅仅意味着我们具有了修改图像的能力,更重要的是,它更泛用,每个人都能使用。」想象一下,如果我们在 Instagram 中加入一个滤镜,这个滤镜能自动将照片中的人物表情替换成「微笑」或者「大笑」,那么我们不光能伪造肤色,脸型,甚至连表情也可以搞定了。下面这段视频也许能让你感受机器学习的强大。

你可以看到,研究人员已经能实时将自己的表情同步给电视机里出现的人物的脸上,在电视中的人物表情看起来非常自然,几乎感觉不到不正常,这当然要归功于机器学习和计算机视觉在这些年所取得的进步,也许以后当我们再看到电视上面的人物的时候,都不敢轻易相信它是真实的了。

在未来,机器能创造以假乱真的照片和声音

2005 年莱斯特大学 Quian Quiroga 等人的一项神经学研究内容探索了人类大脑神经元和视觉表达的关系,从那时候开始。通过让机器学习技术对大量样本进行识别,借助神经网络技术,技术人员能让机器自动生成从未见过的图片。举个例子,当你塞给机器足够多的蚂蚁的照片,在样本量中不断学习的神经网络就能够对蚂蚁有足够的认识,并最终根据你命令生成一个完全自定义的,这个世界上不存在的版本。

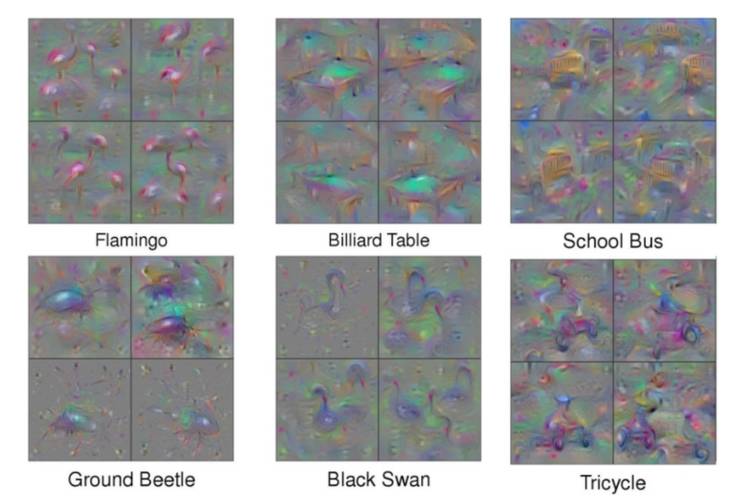

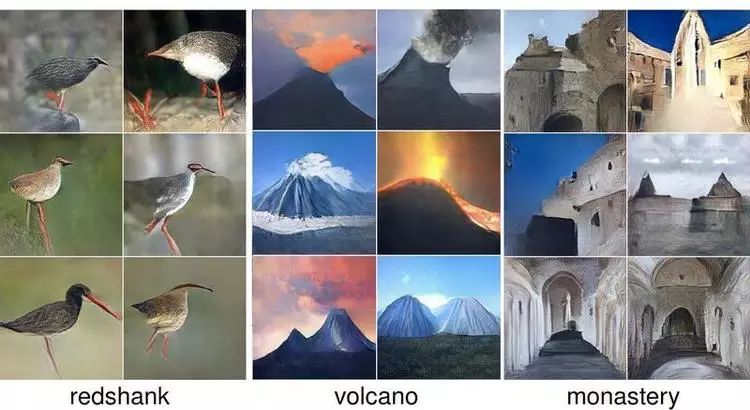

这些就是利用机器学习和神经网络自动生成的物体图片,对比一下 2015 年(图一)和 2016 年(图二)的成果,我们能再一次感受技术进步的速度之快。

这样的机器学习,目前的瓶颈在于图像分辨率达不到很高的要求。而研究人员也表示机器学习遇到的问题就是能够接受的学习样本数量有限。但在未来将能够生成「真实」的全高清图像。

在谈到机器学习和神经网络技术的时候,我们大多数人会觉得这离我们比较遥远。但上面的例子已经提醒我们,它们已经在潜移默化在影响我们的生活了。2016 年,它离我们最近的一次火热交集在一个 app 上——Prisma。

这款应用的基础就是利用了「风格转换」技术,而「风格转换」的实质是利用神经网络将一张图片的风格应用在另一张图片上(与上文所提到的内容非常类似)。于是,Prisma 成为朋友圈里炙手可热的明星应用,今年难得一见的应用宠儿。

而在之后,进一步升级的 Prisma, 能够对视频进行风格化处理。由于「风格转换」相关研究在网络中开源,因此在 Prisma 之后,非常多的同类软件相继出现,这就是机器学习和神经网络与我们生活密切相关的证明,而未来将会呈现的是,机器学习达到一定程度之后,我们需要什么样的素材,机器就能自动生成,利用机器学习,成为人们获得灵感的方法。

在前段时间,Adobe 公司发布了它们的最新研究,用户可以编辑任何人的语音,然后将它像 Photoshop 一样完全重置,你可以想象成日本动漫《名侦探柯南》中的变声器,这意味着你可以借任何人之口来说你想说的内容,而其背后深层次的原理,也离不开机器学习和神经网络。

担心信息造假?但这是历史必然

可能会有人说,技术已经如此强大,那么我们以后看到的,听到的就更难判断真假了。没错,「造假」一直都是我们要面对的问题,但并不只是出现在现在,所以这个观点也值得我们讨论。

从人类有了信息传播之后,我们每一次在传播技术的升级,都会伴随着造假的过程,不论是政治还是军事,科技还是文化,任何能够吸引人们关注的点,都有被造假的可能,更不要说,阴谋论者每时每刻都会想办法让人们陷入耸人听闻的言论之中。

但是,不可否认的是,技术升级,不光会出现「造假」,还会伴随出现「打假」。从技术的源头,我们能够对这些被处理过的图片或者声音进行判断,现代人的意识也能够对信息进行一些常识性的判断,以及对信息的比对。所以我们不用过分担心这件事情,我们应当关心的是,一旦这些技术成熟,我们的道德能否伴随大部分人以及媒介一同进步。

所以,很难预测当未来,声音和图片,甚至视频都能进行如此高精度的造假,我们的社会会怎样,但可以想到的是,那时候的我们,对于信息的判断,和对于技术的运用,一定要比我们更加先进,所以尝试对未来有信心吧,毕竟我们一路都是这样走过来的。

文章部分信息来源 | The Verge