本文约

20000字

,建议阅读

20分钟。

本文从4大个方面为大家解读了数据科学目前的发展状况以及未来的趋势。

大数据时代的到来催生了一门新的学科——数据科学。首先,本文探讨了数据科学的内涵、发展简史、学科地位及知识体系等基本问题,并提出了专业数据科学与专业中的数据科学之间的区别与联系;其次,分析现阶段数据科学的研究特点,并分别提出了专业数据科学、专业中的数据科学及大数据生态系统中的相对热门话题;接着,探讨了数据科学研究中的10个争议及挑战:

思维模式的转变

(知识范式还是数据范式)、

对数据的认识

(主动属性还是被动属性)、

对智能的认识

(更好的算法还是更多的数据)、

主要瓶颈

(数据密集型还是计算密集型)、

数据准备

(数据预处理还是数据加工)、

服务质量

(精准度还是用户体验)、

数据分析

(解释性分析还是预测性分析)、

算法评价

(复杂度还是扩展性)、

研究范式

(第三范式还是第四范式)、

人才培养

(数据工程师还是数据科学家)。再次,提出了数据科学研究的10个发展趋势:预测模型及相关分析的重视、模型集成及元分析的兴起、数据在先,模式在后或无模式的出现、数据一致性及现实主义的回归、多副本技术及靠近数据原则的广泛应用、多样化技术及一体化应用并存、简单计算及实用主义占据主导地位、数据产品开发及数据科学的嵌入式应用、专家余及公众数据科学的兴起、数据科学家与人才培养的探讨。最后,结合本文工作,为数据科学研究者给出了几点建议和注意事项。

大数据正在改变着人们的工作、生活与思维模式,进而对文化、技术和学术研究产生了深远影响。一方面,大数据时代给各学科领域带来了新的机遇——认识论和研究范式的转变,出现了一种区别于传统科学研究中沿用至今的“知识范式”的新研究范式——“数据范式”。“数据范式”的广为应用成为现代科学研究的一个重要转变。另一方面, 大数据带来的挑战在于数据的获得、存储、计算不再是瓶颈或难题,各学科领域中的传统知识与新兴数据之间的矛盾日益突出,传统知识无法解释和有效利用新兴的大数据,进而促使传统理论与方法的革命性变化。

目前,大数据已受到各学科领域的高度关注,成为包括计算机科学和统计学在内的多个学科领域的新研究方向,表现出不同专业领域中的数据研究相互高度融合的趋势,进而即将独立出一门新兴学科——数据科学。同时,大数据研究中仍存在一些误区或曲解,如片面追求数据规模、过于强调计算架构和算法、过度依赖分析工具、忽视数据重用、混淆数据科学与大数据的概念以及全盘否定大数据等。因此,现代社会需要一门新学科来系统研究大数据时代的新现象、理念、理论、方法、技术、工具和实践,即“数据科学”。

本文第1节探讨数据科学的内涵、发展简史、学科地位和知识体系等四个基本问题,并提出了数据科学的两个基本类型——专业数据科学和专业中的数据科学。第2节提出现阶段数据科学研究的特点——本质问题的系统研究较少,反而周边问题的讨论较多,并分别分析了专业数据科学、专业中数据科学以及大数据生态系统中的相对热门话题。第3节探讨数据科学研究中的10个争议——思维模式的转变(知识范式还是数据范式)、对数据的认识视角(主动属性还是被动属性)、对智能的认识侧重点(更好的算法还是更多的数据)、主要瓶颈(数据密集型还是计算密集型)、数据准备(数据预处理还是数据加工)、服务质量(精准度还是用户体验)、数据分析(解释性分析还是预测性分析)、算法评价(复杂度还是扩展性)、研究范式(第三范式还是第四范式)和人才培养(数据工程师还是数据科学家),并分别提出了研究挑战。第4节分析了数据科学研究的10个发展趋势——预测模型及相关分析的重视、模型集成及元分析的兴起、数据在先,模式在后或无模式的出现、数据一致性及现实主义的回归、多副本技术及靠近数据原则的应用、多样化技术及一体化应用并存、简单计算及实用主义占据主导地位、数据产品开发及数据科学的嵌入式应用、专家余及公众数据科学的兴起以及数据科学家与人才培养的探讨。最后总结全文,并对数据科学研究者提出了几点建议。

“数据科学”与“大数据”是两个既有区别又有联系的术语,可以将数据科学理解为大数据时代一门新科学,即以揭示数据时代,尤其是大数据时代新的挑战、机会、思维和模式为研究目的,由大数据时代新出现的理论、方法、模型、技术、平台、工具、应用和最佳实践组成的一整套知识体系。

1. 数据科学的内涵及兴起

1974年,著名计算机科学家、图灵奖获得者Peter Naur在其著作《计算机方法的简明调研(Concise Survey of Computer Methods)》的前言中首次明确提出了数据科学(Data Science)的概念,“数据科学是一门基于数据处理的科学”,并提到了数据科学与数据学(Datalogy)的区别——前者是解决数据(问题)的科学(the science of dealing with data),而后者侧重于数据处理及其在教育领域中的应用(the science of data and of data processes and its place in education)。

Peter Naur首次明确提出数据科学的概念之后,数据科学研究经历了一段漫长的沉默期。直到2001年,当时在贝尔实验室工作的William S. Cleveland在学术期刊International Statistical Review上发表题为《数据科学——拓展统计学技术领域的行动计划(Data Science: an Action Plan for Expanding the Technical Areas of the Field of Statistics》的论文,主张数据科学是统计学的一个重要研究方向,数据科学再度受到统计学领域的关注。之后,2013年,Mattmann C A和 Dhar V在《自然(Nature)》和《美国计算机学会通讯(Communications of the ACM)》 上分别发表题为《计算——数据科学的愿景(Computing: A vision for data science)》和《数据科学与预测(Data science and prediction)》论文,从计算机科学与技术视角讨论数据科学的内涵,使数据科学纳入计算机科学与技术专业的研究范畴。然而,数据科学被更多人关注是因为后来发生了三个标志性事件:一是Patil DJ和 Davenport T H于2012年在哈佛商业评论上发表题为《数据科学家——21世纪最性感的职业(Data scientist: the sexiest job of the 21st century)》;二是2012年大数据思维首次应用于美国总统大选,成就奥巴马,击败罗姆尼,成功连任;三是美国白宫于2015年首次设立数据科学家的岗位,并聘请Patil DJ作为白宫第一任首席数据科学家。

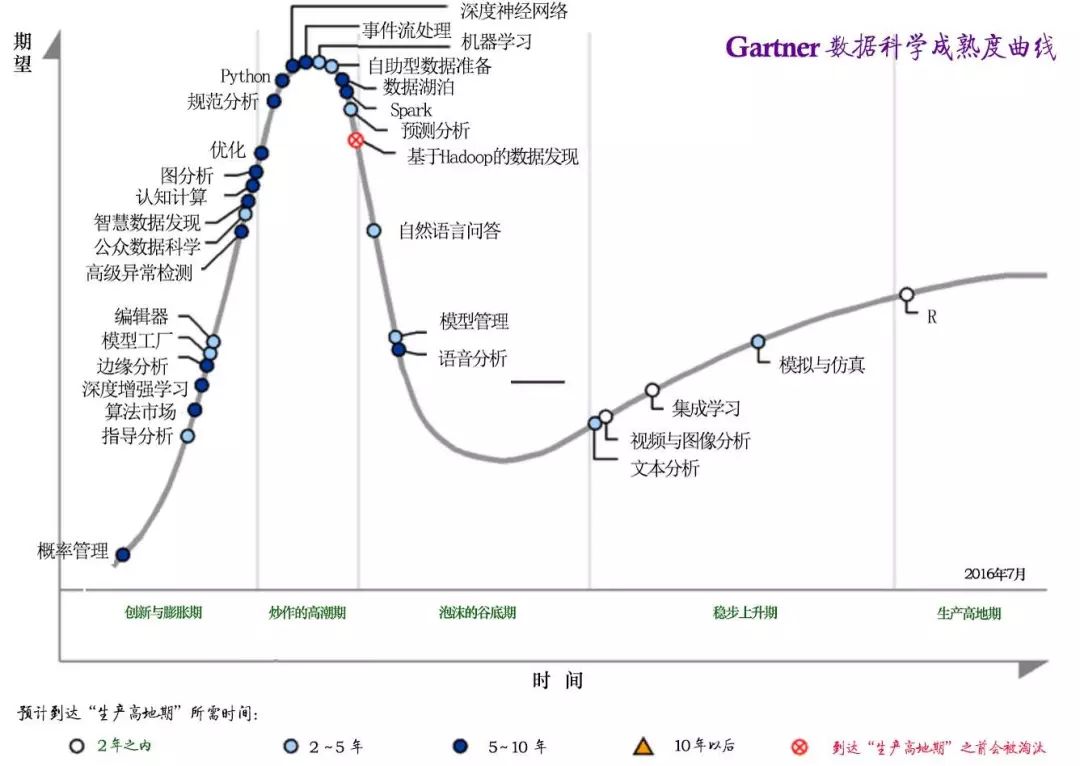

Gartner的调研及其新技术成长曲线(Gartner's 2014 Hype Cycle for Emerging Technologies)表示,数据科学的发展于2014年7月已经接近创新与膨胀期的末端,将在2~5年之内开始应用于生产高地期(plateau of Productivity)。同时,Gartner的另一项研究揭示了数据科学本身的成长曲线(Hype Cycle for Data Science),如图1所示。从图1可以看出,数据科学的各组成部分的成熟度不同:R的成熟度最高,已广泛应用于生产活动;其次是模拟与仿真、集成学习、视频与图像分析、文本分析等,正在趋于成熟,即将投入实际应用;基于Hadoop的数据发现可能要消失;语音分析、模型管理、自然语言问答等已经渡过了炒作期,正在走向实际应用;公众数据科学、模型工厂、算法市场(经济)、规范分析等正处于高速发展之中。

图1 数据科学的成长曲线(2016)

2. 数据科学的学科地位

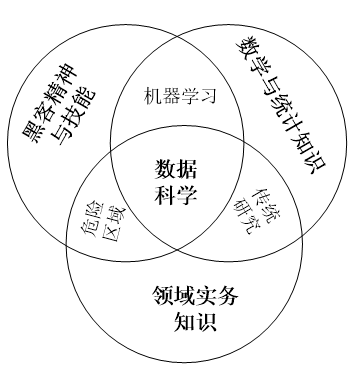

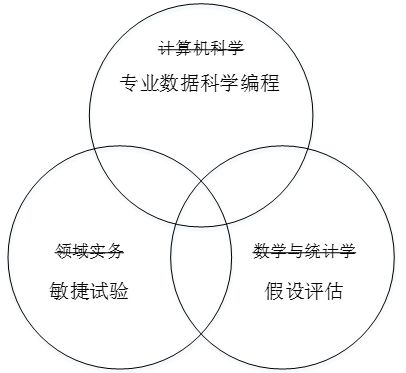

2010年,Drew Conway 提出了第一张揭示数据科学的学科地位的维恩图——《数据科学维恩图(The Data Science Venn Diagram)》(图2),首次明确探讨了数据科学的学科定位问题。在他看来,数据科学处于统计学、机器学习和领域知识的交叉之处。后来,其他学者在此基础上提出了诸多修正或改进版本,如图3是Jerry Overton于2016年给出的数据科学维恩图。但是,后续版本对数据科学的贡献和影响远不及Drew Convey首次提出的数据科学维恩图。

|

|

|

|

图2 Drew Conway的数据科学韦恩图(2010)

|

图3 Jerry Overton的数据科学韦恩图(2016

)

|

从Drew Conway的《数据科学维恩图》的中心部分可看出,数据科学位于统计学、机器学和某一领域知识的交叉之处,具备较为显著的交叉型学科的特点,即数据科学是一门以统计学、机器学习和领域知识为理论基础的新兴学科。同时,从该图的外围可看出,数据科学家需要具备数学与统计学知识、领域实战和黑客精神,说明数据科学不仅需要理论知识和实践经验,而且还涉及黑客精神,即数据科学具有三个基本要素:理论(数学与统计学)、实践(领域实务)和精神(黑客精神)。

3. 数据科学的知识体系

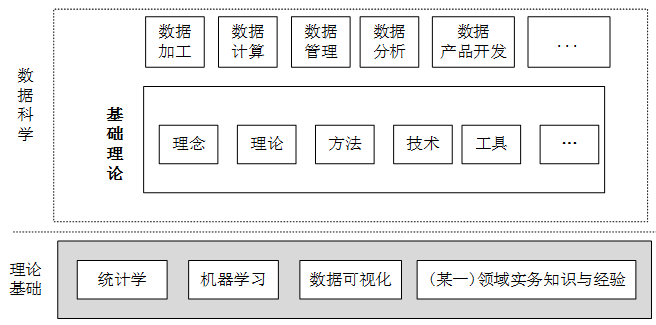

从知识体系看,数据科学主要以统计学、机器学习、数据可视化以及(某一)领域知识为理论基础,其主要研究内容包括数据科学基础理论、数据加工、数据计算、数据管理、数据分析和数据产品开发,如图4所示。

图4 数据科学的知识体系

4. 专业数据科学及专业中的数据科学

数据科学是一门与领域知识和行业实践高度交融的学科。从目前的研究现状看,数据科学可以分为两类:专业数据科学与专业中的数据科学。其中,“专业数据科学”是以独立学科的形式存在,与其他传统学科(如计算机科学、统计学、新闻学、社会学等)并列的一门新兴科学;“专业中的数据科学”是指依存于某一专业领域中的大数据研究,其特点是与所属专业的耦合度较高,难以直接移植到另一个专业领域,如数据新闻(Data Journalism)、材料数据科学(Materials Data Science)、大数据金融(Big Data Finance)、大数据社会、大数据伦理(Big Data Ethics)和大数据教育(Big Data Education)等。

专业数据科学与专业中的数据科学的联系如下:专业数据科学聚集了不同专业中的数据科学中的共性理念、理论、方法、术语与工具;相对于专业中的数据科学,专业数据科学更具有共性和可移植性,并为不同专业中的数据科学研究奠定了理论基础;专业中的数据科学代表的是不同专业中对数据科学的差异性认识和区别化应用。

目前,数据科学的研究特点是对本质问题的系统研究少,然而对周边问题的讨论较多,可从以下四个方面进行分类分析。

1. 周边问题仍为研究热点

从文献分布看,数据科学的研究主题可以分为两类:核心问题和周边问题。前者代表的是数据科学的基础理论——数据科学特有的理念、理论、方法、技术、工具、应用及代表性实践;后者代表的是数据科学的底层理论(理论基础,如统计学、机器学习等)、上层应用(应用理论,如数据新闻、大数据金融、大数据社会、大数据生态系统等)以及相关研究(如云计算、物联网、移动计算等)。文献数量和研究深度表明,现阶段的数据科学研究热点仍聚焦在周边问题的讨论之上,而对数据科学的核心问题的研究远远不够。数据科学的周边问题的研究主要集中在:

2. 专业数据科学研究中相对热门话题

从研究视角看,数据科学的研究可以分为两类:专业数据科学和专业中的数据科学。前者代表的是将数据科学当作一门独立于传统科学的新兴学科来研究,强调的是其学科基础性:后者代表的是将数据科学当作传统学科的新研究方向和思维模式来研究,强调的是数据科学的学科交叉性。从目前的研究现状看,专业数据科学研究的热热门话题有:

除了上述问题之外,大数据的安全、大数据环境下的个人隐私保护、数据科学的项目管理及团队建设、公众数据科学(Citizen Data Science)等是目前在专业数据科学研究中讨论较多的问题。

3. 专业中的数据科学研究的相对热门话题

相对于专业数据科学,专业中的数据科学研究具有差异性和隐蔽性。差异性主要表现在各学科领域对数据科学的关注点和视角不同;隐蔽性是指专业中的数据科学研究往往间接地吸收和借鉴数据科学或类似于数据科学的思想,而并不明确采用或直接运用数据科学的规范术语。从目前的研究看,以下几个专业中的数据科学研究尤为活跃:

智慧类应用:如何将大数据应用于智慧城市、智慧医疗、智慧养老、智慧交通、智慧教育等领域,发挥数据的驱动作用,进而实现更高的智慧。

敏捷类应用:如何将大数据思维用于软件开发、项目管理以及组织管理之中,进而实现敏捷软件开发、敏捷项目管理和敏捷组织,提升其应变能力和可持续发展能力。

4. 大数据生态系统研究中相对热门话题

在不同的学科领域,大数据时代的科学研究所面临问题、挑战和关注点不同。从计算机科学视角看,新的数据处理需求已经超出了现有的存储与计算能力;从统计学视角看,大数据挑战在于样本的规模接近总体时,如何直接在总体上进行统计分析;从机器学习角度看,训练样本集接近测试样本集时,如何用简单模型及模型集成方法实现较高的智能水平;从数据分析角度看,如何从海量数据中快速洞察有价值的数据,并通过试验设计和模拟仿真,实现数据到智慧的转变。但是,从数据科学视角看,其研究中的常见争议及背后的研究挑战可以归纳为10个方面:

1. 思维模式——知识范式还是数据范式

在传统科学研究中,由于数据的获得、存储和计算能力所限,人们往往采取的是知识范式(“数据→知识→问题”的范式),从数据,尤其是样本数据中提炼出知识之后,用知识去解决现实问题。大数据时代的到来及数据科学出现为人们提供了另一种研究思路,即数据范式(“数据→问题”范式),在尚未从数据中提炼出知识的前提下,用数据直接解决问题。数据范式强调的是在尚未将数据转换为知识的前提下,直接用数据去解决现实世界中的问题。以机器翻译为例,传统机器翻译方法是基于自然语言理解,准确说是基于语言学和统计学的知识进行,属于知识范式的范畴。但是,这种传统机器翻译效果一直并不理想,且尚无突破性进展。然而,近几年兴起的机器翻译方法改变了传统机器翻译的思维模式,采取的是“数据范式”——直接从历史跨语言语料库中快速洞见所需结果。上世纪五十年以来的IBM 机器翻译的缓慢发展以及2000以后的Google机器翻译的迅速兴起也反映了这种思维模式的变革。

与传统认识中的“知识就是力量”类似,在大数据时代,数据也成为一种重要力量。如何组织、挖掘和利用数据成为现代组织的核心竞争力。目前,思维模式变革的主要挑战在于如何完成以数据为中心的设计、数据驱动型决策和数据密集型应用。

2. 数据的认识——主动属性还是被动属性

在传统科学研究中,数据一直被当作是被动的东西,人们主要从被动属性方面去对待数据。以关系数据库为例,人们先定义关系模式,然后将数据按照关系模式的要求进行强制转换后放入数据库中,完成数据挖掘和分析任务。

在大数据思维模式的背后,一个根本性的变革在于人们开始意识到数据的主动属性——不再简单认为数据是一种死的、被动的东西,而更加重视数据的积极作者用,提出了数据在先、模式在后或无模式、让数据说话、数据驱动型应用、数据业务化、数据洞察和以数据为中心的思维模式等新术语。

因此,如何正确认识数据及如何充分发挥数据的主动属性成为数据科学的重要研究任务。目前,相关研究的主要挑战在于如何实现数据洞察、以数据为中心的设计、敏捷软件开发、数据驱动型决策以及智慧类应用研发。

3. 智能的认识——更好的算法还是更多的数据

在传统学术研究中,智能主要来自于算法,尤其是复杂的算法。算法的复杂度随着智能水平得到提升。例如,KNN算法是机器学习中常用的分类算法,其算法思想非常简单。人们根据不同应用场景提出多种改进或演化方案,虽然智能水平有所提高,但随之而来的问题是算法复杂度的提升。但是,数据范式表明,数据也可以直接用于解决问题,引发了一场关于“更多数据还是更好模型(More data or Better Model debate)”的讨论,经过这场大讨论,人们得出了相对一致的结论——“更多数据+简单算法=最好的模型(more data+ simple Algorithem= the best model)”。

因此,如何设计出简单高效的算法以及算法的集成应用成为数据科学的重要挑战。目前,关于智能的实现方式的挑战在于算法设计、算法集成、维度灾难和深度学习。

4. 研发瓶颈——数据密集型还是计算密集型

传统的软件开发与算法设计的重点是解决计算密集型的问题,计算是研究难点和瓶颈。但是,随着大规模分布式计算,尤其是云计算的普及,计算不再是人们需要解决的首要瓶颈。因此,软件开发与算法设计的主要矛盾从计算转向数据,出现了数据密集型应用。在数据密集型应用中,数据是主要关注点与瓶颈。数据密集型问题的研究将进一步推动以数据为中心的研究范式。

目前,数据密集型应用的主要挑战在于副本数据技术、物化视图、计算的本地化、数据模型的多样化和数据一致性保障。

5. 数据准备——数据预处理还是数据加工

在传统数据研究中,数据准备主要强调的是将复杂数据转换为简单数据,对脏数据进行清洗处理后得到干净数据,从而防止“垃圾进垃圾出”现象的出现,主要涉及重复数据的过滤、错误数据的识别以及缺失数据的处理。可见,数据预处理主要关注的是数据的质量维度的问题。但是,由于从小数据到大数据之间存在质量涌现现象——个别小数据的质量问题(如缺失数据、错误数据或重复数据)不影响整个大数据的可用性,大数据处理中关注的并非为传统意义上的数据预处理,而其关注点转向另一个重要课题——数据加工。

在数据科学中,数据加工是指数据的创造性增值过程,包括两种表现形式:数据打磨(data wrangling)或数据改写(data munging)。与数据预处理不同的是,数据加工更加强调的是如何将数据科学家的3C精神融入数据处理工作之中,从而达到数据增值的目的。因此,数据加工并不仅限于技术工作的范畴,而且还涉及到艺术层面的创造,如需要采用数据柔术(Data Jujitsu)和整齐化处理(Data Tidying)的方法进行数据加工处理。

数据加工概念的提出意味着人们对数据复杂性的认识发生了重要的变革,即开始接受数据的复杂性特征,认为复杂性是数据本身的固有特征。与此同时,数据准备的关注点转向另一个重要问题,即如何发挥人的增值作用。目前,数据加工的研究主要挑战集中在:

-

数据打磨或数据改写理念的提出:如何在数据科学项目中充分发挥数据科学家的作用,进而实现数据处理活动的增值效果;

-

数据打磨或数据改写技术的实现:基于Python、R以及大数据技术实现数据加工的理念与方法;

-

数据柔术:如何有艺术性地将数据转换为产品;

-

整齐化处理:将数据转换为大数据算法和大数据技术能够直接处理的形态。

6. 服务质量——精准度还是用户体验

查全率和查准率是传统数据研究中评价服务质量的两个核心指标。但是,当总体为未知、数据量迅速增长、数据种类不断变化和数据处理速度要求高时,查全率和查准率的追求成为不可能。因此,在大数据环境下,更加重视的是用户体验,而不是查全率和查准率。在用户体验的评价中,响应速度是最为重要指标之一。Aberdeen Group的调查发现“页面的显示速度每延迟1秒,网站访问量就会降低11%,从而导致营业额减少7%,顾客满意度下降16%”Google发现“响应时间每延迟0.5秒,查询数将会减少20%”;Amazon发现“响应时间延迟0.1秒,营业额下降1%。

目前,用户体验研究的主要挑战在于如何确保较快的响应速度、设计人机交互、实现服务虚拟化以及提供按需服务。

7. 数据分析——解释性分析还是预测性分析

理论完美主义者认为只有掌握了因果关系才能正确认识和有效利用客观现象。传统数据分析往往是理论完美主义的指导下完成,试图通过对历史数据进行深度分析之后,达到深刻理解自我或解释客观现象的目的,侧重的是因果分析,即以解释型分析为主。

在大数据环境下,数据分析的重点从因果分析转向相关分析,更加重视的是事物之间的相关关系。然而,在这种变革的背后是数据分析指导思想的根本性变化——从理论完美主义转向现实实用主义,侧重于数据分析的实用性,更加重视对未来的预测,即预测型分析。相对于解释性分析,预测性分析具有更强的时效性,可以迅速洞见事物之间的内在联系以及其商业价值。

因此,数据科学的一个重要特点是预测性分析和解释性分析的分离。预测性分析主要由数据科学家完成,一般不需要领域知识;解释性分析则发生在预测性分析之后,数据科学家将预测性分析中的洞察结果转交给领域专家,由领域专家负责完成解释性分析。可见,数据科学家一般不做解释性分析,或者说,解释性分析往往超出数据科学家的能力范畴,需要由具体领域的专家完成。预测性分析和解释性分析的分离也是数据科学家和领域专家之间协同工作的主要实现方式。

大数据分析的主要挑战源自于数据的复杂性、噪声数据的分析、数据的依赖度。提出面向大数据分析的新方法、技术与工具,尤其是大数据分析方法的动态演化、实时计算和弹性计算成为相关研究中亟待解决的问题。

8. 算法评价——复杂度还是可扩展性

复杂度,尤其是时间复杂度和空间复杂度,是传统算法的两个重要评价指标 ,分别代表的是算法的运行所需的时间成本和内存成本。但是,在大数据环境下,算法设计的一个重要特点是上层需求和底层数据处于动态变化之中,因此,算法应支持按需服务和数据驱动型应用。例如,谷歌于2008年推出预测流感疫情工具——谷歌流感趋势(Google Flu Trends,GFT),及时准确预测了当时H1N1在全美范围的传播,但是,2013年1月的估计比实际数据高两倍,主要原因之一是缺乏算法动态性(Algorithm Dynamics)和用户使用行为习惯的变化。

在大数据时代,算法的可扩展性主要代表的是算法的可伸缩能力。目前,相关研究的主要挑战在于低维度算法在高维数据中的应用、维度灾难、数据规约以及数据密集型应用。

9. 研究范式——第三范式还是第四范式

图灵奖获得者Jim Gray 曾提出,人类科学研究活动已经历过三种不同范式的演变过程(原始社会的“实验科学范式”、以模型和归纳为特征的“理论科学范式”和以模拟仿真为特征的“计算科学范式”),目前正在从“计算科学范式”转向“数据密集型科学发现范式(Data-intensive Scientific Discovery)”。第四范式,即“数据密集型科学发现范式”的主要特点是科学研究人员只需要从大数据中查找和挖掘所需要的信息和知识,无须直接面对所研究的物理对象。例如,在大数据时代,天文学家的研究方式发生了新的变化——其主要研究任务变为从海量数据库中发现所需的物体或现象的照片,而不再需要亲自进行太空拍照。

第四范式的提出反映了人们对世界的固有认识发生了根本性的变化——从二元认识(精神世界/物理世界)转向三元认识(精神世界/数据世界/物理世界),即在原有的“精神世界”和“物理世界”之间出现了一个新的世界——数据世界。因此,科学研究者往往直接面对的是数据世界,通过对数据世界的研究达到认识和改造物理世界的目的。对于科学研究者而言,数据世界中已积累的“历史数据”往往足以完成一项科研任务,数据科学家不需要亲自到物理世界采用问卷和访谈的方法收集数据——“调研数据”。同时,与“调研数据”相比,“历史数据”更具有客观性和可信度。目前,相关研究主要挑战在于第三范式与第四范式的区别、第四范式的内涵、理论深入研究以及领域应用。

10. 人才培养——数据工程师还是数据科学家

传统科学领域中,数据相关的人才培养的目标定位于数据工程师——从事数据的组织、管理、备份、恢复工作的人才。但是,在大数据时代,数据工程师无法胜任数据科学的研究任务,需要的是一类全新的人才——数据科学家。二者的主要区别在于:数据工程师负责的是数据的管理,而数据科学家擅长的是基于数据的管理,如基于数据的决策、产品开发、业务定义等。

目前,关于数据科学家的研究及人才培养的挑战在于正确分析岗位职责与用人需求、数据科学家的素质与能力要求、数据科学项目管理以及数据科学家的职业规划。

在梳理研究热点、争议及挑战的基础上,我们需要进一步分析数据科学研究的发展趋势。从整体上讲,数据科学研究的主要发展趋势可以总结为:

1. 预测模型及相关分析的重视

数据科学的研究责任在于预测模型而不在于解释模型。以预测模型为中心的数据科学更偏向于实用主义,更加关注的是“对未来的预测能力”,而不是“对过去的解释水平”。因此,数据科学的研究更加重视的是“现在能为未来做什么?”,而不是“过去对现在的影响是什么?”

数据科学中重视预测模型而不是解释模型的另一个现实基础在于“人们往往先发现规律,后发现原因”。从方法论层次看,以发现预测模型为目的的研究往往提倡的是假设演绎(Hypothetico-Deductive)研究范式,先提出研究假设,然后采用试验设计和演绎分析方法论证研究假设成立与否。然而,一个好的研究假设的提出需要研究者,尤其是数据科学家的特有素质——创造力、批判性思考和好奇心。

与解释模型不同的是,预测模型更加重视的是模型的简单性,而不是复杂性,主要原因有两个,一是预测模型对计算时间的要求较高,甚至需要进行实时分析,然而简单模型的计算效率往往高于复杂模型;二是经验证明,正如奥卡姆剃刀定律(Occam's razor)所言,在其他条件相同的情况下,就预测而言,简单模型比复杂模型更可靠。

预测模型往往建立在相关关系,而不是因果关系。通常,相关关系可以帮助我们预测未来,而因果关系有助于进一步理解和控制未来。从表面上看,预测模型依赖的是相关关系的分析,但在本质上属于一种数据驱动型的“数据范式”,与基于知识范式的解释模型有着本质性的区别。

2. 模型集成及元分析的兴起

传统数据分析的通用做法是用一个数据模型即可解决一项数据处理任务。在这种以单一模型为基础的数据分析中,为了提升数据处理的信度和效度,需要对模型进行优化和调整,导致数据模型复杂度的增长。也就是说,传统数据分析中的数据模型有两个基本特征:单一性和复杂性。

但是,在大数据背景下,人们很难找到一个能够处理动态且异构数据的单一模型,因此,开始寻求多个模型的集成应用。与传统数据分析不同的是,大数据分析中所涉及的模型往往是极其简单,即大数据分析中的数据模型也有两个基本特征:多样性和简单性。

可见,模型集成成为数据科学研究的一个新问题。通常,大数据分析采用多个较为简单的数据模型,将数据分析任务分解成分散在多个层次,多个活动的小任务,并通过简单模型及其集成方法达到最终数据处理目的。例如,在深度学习之中,由多处理层组成的计算模型可通过多层抽象来学习数据表征。

模型集成的背后是元分析的兴起。传统统计学重视的基于零次或一次数据的基本分析,包括描述性统计、参数估计和假设检验。在大数据环境下,二次数据和三次数据的分析显得更为重要,数据分析工作往往在众多小模型的分析结果的基础上进行二次分析,即元分析。

3. 数据在先,模式在后或无模式的出现

传统数据管理,尤其是关系型数据库中采用的是“模式在先、数据在后(Schema First,Data Later)”的建设模式,即先定义模式,然后严格按照模式要求存储和管理数据;当需要调整模式时,不仅需要重定义数据结构,而且还需要修改上层应用程序。然而,在大数据环境下,无法沿用“模式在先、数据在后(Schema First,Data Later)”的建设模式,主要原因有两个:一是数据模式可能为不断变化或根本不存在;二是按照预定模式进行数据的存储和处理时容易导致信息丢失。