人工智能是在像人类一样思考,抑或仅仅只是简单的计算?

我思故我在。这已成为了当代哲学关于自我、意识和个人主义的基础。

在笛卡尔看来,思想是可以自证的:他不需要对其进行定义。思想是什么?智能是什么?机器能否具备思想和智能?人工智能技术带来的不仅是答案,也有许多问题。我们可以来做以下的思想实验。

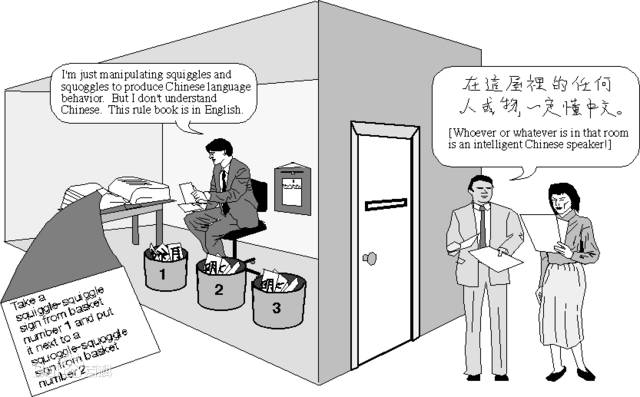

想象一位只说英语的人身处一个房间中,房间的一侧有个小窗口。他随身携带一本关于中英文翻译规则的书。写着中文的纸片通过小窗口送入房间,而房间中的人可以利用自己的书来翻译这些文字,并从另一个小窗口递出。因此,一侧的纸片上写着中文,而另一侧的纸片上有着完美翻译的英文,但实际上这个人根本就不会说中文。

这一思想实验最初由约翰·希尔(John Searle)提出,常常被用于简单地证明,定义智能有多么困难。如果房间里的人足够多,那么你就可以完成几乎所有一切任务:画出或描述图片,或是翻译或修正任何语言。但这是否是一种智能?房间以外的人可能会认为,这就是智能,但房间里的人不会这样看。

如果房间里不是人,而全部是晶体管,那么这就非常像是一台计算机。因此,一个很自然的问题就是,计算机是否就是一个更复杂的“中文房间”?这个问题的一种答案是:如果房间里不是晶体管,而是神经元,那么情况又要怎么看?这带来了更多问题。

在这里,我们并非想要解决这个困扰哲学家已久的问题。我们或许需要更务实。

目前,人工智能被用于描述多种系统。尽管许多系统实际上并不能称作人工智能,但由于人工智能本身也缺乏明确的定义,因此很难做出反驳。简单而言,人工智能是一种软件,试图复制人类的思维过程或随之而来的结果。这带来了很大的解释余地。

你可以让人工智能为你选择下一首歌曲,人工智能可以控制机器人的腿,人工智能可以识别照片中的对象并进行描述,人工智能可以将德语翻译成英语、俄语和韩语。这些任务都是人类所擅长的,而自动化可以带来很大的便利。

然而最终,即使最复杂的任务也只是个任务。在接受了数百万个句子的训练之后,神经网络可以在8种语言之间进行无缝的翻译。然而,这只是一台非常复杂的机器,根据开发者设定的规则去进行计算。如果某件事可以被归纳为类似“中文房间”的机制,无论这件事多么庞大、多么复杂,那么我们是否还可以将其称作智能,而不仅仅是计算?

在这里,我们开始将人工智能分为“弱”人工智能和“强”人工智能。这并不是人工智能的不同类型,而是一种思考人工智能本质的方式。与许多哲学上的差异类似,没有任何一者更加正确。但这样的区分确实很重要。

一方面,有人认为,无论人工智能多么复杂,都不可能胜过人工智能的开发者:人工智能无法突破其机械的本质。甚至在这些限制以内,人工智能可以完成不可思议的工作,但最终这也只是非常强大的软件。这就是“弱”人工智能的观点。持这种观点的人士认为,由于这些基础性限制的存在,更应该关注的是如何开发系统,使其擅长单个的任务。

相对的另一方面是“强”人工智能。这种观点认为,人工智能的性能有可能足够强大,从而与人脑相仿。这类人士认为,人脑自身不过是另一个“中文房间”。

如果我们大脑中的生物结构能产生所谓的智能和意识,那么为何基于硅材料的电路无法实现同样的目标?根据“强”人工智能的理论,未来某天我们将可以开发出与人脑相当,甚至超过人脑的智能。

而这里又出现了一个问题:对于智能,我们并没有可行的定义。

过去3000年中,很难说,在定义智能的过程中,我们是否取得了任何有意义的进展。至少我们曾得出过许多明显错误的观念,例如智能可以被简单的测量,或者说智力与生物性特征,例如头型和脑容量相关。

关于是什么构成了智能,我们似乎都有各自的想法,因此很难证明一种人工智能是否有资格称作智能。在各种概念中,有一种足够简单、足够基本的想法值得进一步关注:智能就是解决新问题的能力。

这意味着“适应能力”、“通用性”,而不仅仅是“推理”、“判断”和“感知”能力。解决问题,做出推理很重要,但更重要的是将解决某种问题的能力转化为解决其他问题的能力。这样的转化将是智能的关键,即使没有人清楚应当如何正式描述这样的概念。

未来某天,我们的人工智能是否会出现这样的适应性,从而可以解决从未被定义过的新问题?研究人员正在努力开发下一代人工智能,使其学习并处理前所未见的细节,从而可以像人类一样行事。

人工智能是在思考还是在计算,这或许是哲学家和计算机科学家的问题,但我们开始关注这一问题本身已经是一项了不起的成就。

公众号搜索“腾讯研究院”收听研究院及各子中心账号