作者 |

Xiaoshuai Hao

编辑 | 深蓝AI

点击下方

卡片

,关注“

自动驾驶之心

”公众号

自动驾驶系统包括感知、预测、决策、规划等不同的功能模块。对于其中的自动驾驶规划模块而言,要想实现准确安全的路径规划,就需要利用自动驾驶车辆上配置的传感器采集周围的环境信息构建地图。

本文介绍了MapFusion:一种用于多模态地图构建的新型BEV特征融合网络。

©️【深蓝AI】编译

论文标题:MapFusion: A Novel BEV Feature Fusion Network for Multi-modal Map Construction

论文作者:Xiaoshuai Hao, Yunfeng Diao, Mengchuan Wei, Yifan Yang, Peng Hao, Rong Yin, Hui Zhang, Weiming Li, Shu Zhao, Yu Liu

论文地

址:https://arxiv.org/abs/2502.04377

▲图1| 自动驾驶系统中地图构建任务示意图©️【深蓝AI】编译

图1展示了高精地图(HD Map)与地图分割(Map Segmentation)两类地图构建任务示意图。

现有的地图构建算法根据所使用的传感器数据进行划分,大体可以分成三种。

分别是基于纯视觉的、基于纯激光雷达的以及基于相机和激光雷达融合的。

在这三类方法当中,由于多模态融合算法可以充分利用不同模态数据之间的信息互补优势,其性能明显高于其他两类单模态的地图构建算法。

近年来,学术界已经提出了不少采用多模态的地图构建算法,比如,X-Align采用基于元素相加的方式进行多模态BEV特征的融合过程;BEVFusion采用两种模态加权平均的BEV特征融合方式;HDMapNet采用两种不同模态通道拼接的方式完成BEV特征的融合。

尽管上述融合方式取得了不错的性能,但是这些方法通常忽略了不同模态特征之间的交互过程,影响了最终的地图构建效果。

在本文中,

提出了跨模态交互变换器(CIT)模块,通过采用自注意力的方式实现了两种模态BEV特征之间的更加有效交互。

同时,文中还进一步提出了双向动态融合(DDF)模块实现自适应的从不同模态之间选择有价值的信息构建最终的BEV融合特征。

本文的主要贡献总结如下:

-

提出了一种名为MapFusion的多模态地图构建算法,实现对于不同模态之间的更加高效的交互和集成,提高最终的高精地图和地图分割任务的效果。

-

为了解决视觉和点云模态语义特征不对齐问题,设计了名为跨模态交互变换器模块,通过自注意力的方式实现两类模态特征的有效交互。

-

为了更好的解决两类模态的特征融合问题,提出了名为双向动态融合模块,自适应的从两类特征中选择有价值的信息完成融合特征的构建。

-

大量实验表明,提出的MapFusion算法模型高于nuScenes数据集中高精地图和BEV地图分割任务的SOTA算法

3.6%和6.2%

。

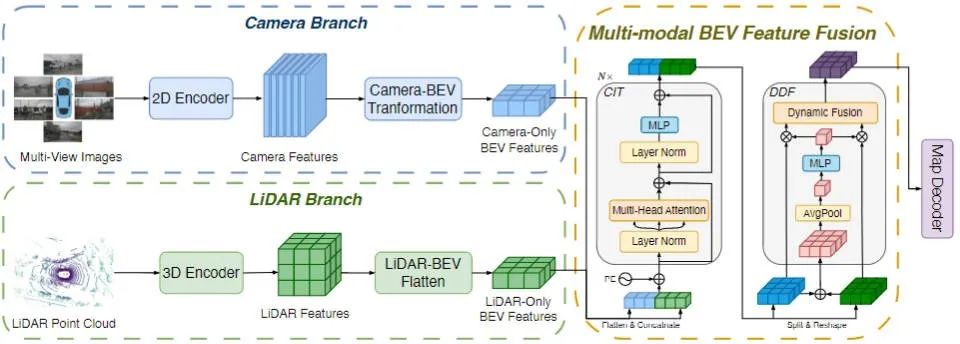

MapFusion算法模型的网络结构如图2所示。具体而言,给定传感器采集的环视图像和点云数据,分别利用2D编码器和3D编码器完成各自模态的特征提取和BEV特征构建;然后将两个模态的BEV特征喂入提出的跨模态交互变换器中实现两类特征的交互,接下来利用双向动态融合模块实现两类特征的融合,最后接Map Decoder输出地图的构建结果。

▲图2| MapFusion算法模型的整体框架图©️【深蓝AI】编译

■ 1.1. 跨模态交互变换器(CIT)

在上文中提到,由于不同模态之间存在语义不对齐问题,本文采用了跨模态交互变换器来缓解这一问题的发生。具体而言,

CIT模块的整体流程可以总结为以下几步。

1.将相机分支和雷达分支输出的BEV特征进行展平,并按照矩阵的顺序进行排列,从而得到

和

。

2.为了能够让不同模态的token在训练的过程中进行区分,本文添加了PE位置编码。

3.由于跨模态交互变换器采用了Transformer中自注意力的思想,所以将添加了位置编码后的多模态数据利用线性层进行转换,得到

矩阵。

4.按照Transformer中自注意力的计算公式,计算

之间的相似性矩阵,最终与

进行加权;同时为了获得来自不同位置的子空间的多种复杂注意力关系,本文也采用了多头注意力的计算方式完成自注意力部分的计算。

5.最后对上一步得到的多头注意力输出结果采用非线性变换的方式得到输出特征

。这一步得到的输出特征会被转换为

和

用于后续的特征融合。