正文

▷

每周一条油管频道 Arxiv Insights 视频

雷锋字幕组译制

翻译 | 刘宁 校对 | 凡江 整理 | 囧囧

当下的图像识别技术看似愈发成熟了,但神经网络还是会犯错,特别是碰到人为伪造图片时,神经网络基本识别无能:

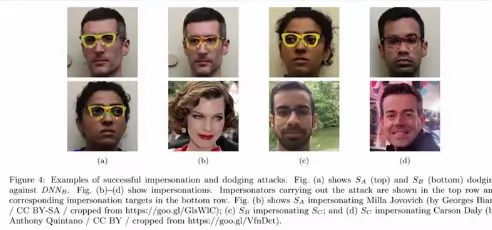

比如你只要带上这幅特制3D眼睛,在神经网络的眼里,你就算已经化成灰了,他根本识别不出来你是谁。

再比如你伪造个车牌,神经网络直接就懵了,基本上全世界的交通摄像头都识别不出来你是真是假。

想要骗过神经网络,也不要什么超高伎俩,随便动动手脚,在原图上增加一点噪音,或是更改一些像素点就成了。但是想骗过人类就难了,我们通常都能知道某张图是伪造的或是人为制作出来的。

假如我们输入一张熊猫的图片,通过卷积神经网络的计算,它被归类为是熊猫。神经网络的运作过程是:在神经网络输出层中随机选择输出神经元(并非代表熊猫的神经元)→将梯度下降法运用于输入熊猫图片的像素点→最大限度地激活目标神经元。但是,如果我们采用调整输入图片像素值,就能骗过神经网络,从而得到错误的分类。

对抗样本不仅可以用于计算机视觉领域,还可以用于自然语言处理领域。像在Amazon,booking,TripAdvisor等网站的信息,大多源于用户在网站上反馈的评价,评价通常会用感情分析来处理和汇总。仅仅修改评价中的几个字,就能完全反转模型对情感的判断。

本视频将介绍对抗攻击及其防御的相关知识,并从以下几个方面介绍:

-

什么是对抗样本?

-

对抗样本出现在哪些场合?

-

对抗样本有什么特性?

-

如何防御对抗样本?

视频讲解通俗易懂,有兴趣钻研的童鞋可以参考:

产生和防御对抗样本的新方法 | 分享总结

————— 新人福利 —————

关注AI 科技评论,回复

1

获取

【数百 G 神经网络 / AI / 大数据资源,教程,论文】

————— AI 科技评论招人了 —————

AI 科技评论期待你的加入,和我们一起见证未来!

现诚招学术编辑、学术兼职、学术外翻

详情请点击

招聘启事

————— 给爱学习的你的福利 —————

AI科技评论年度巨献

特辑热卖中

扫码或点击

阅读原文

立即购买

▼

▼

▼

————————————————————