主要观点总结

英伟达创始人兼CEO黄仁勋在CES 2025上发表主题演讲,发布了包括RTX 50系列显卡、全球最小AI超级计算机Project DIGITS、世界基础模型开发平台Cosmos等一系列新产品和技术。演讲还涉及AI性能提升、基础模型、物理AI等多个领域的进展和创新。

关键观点总结

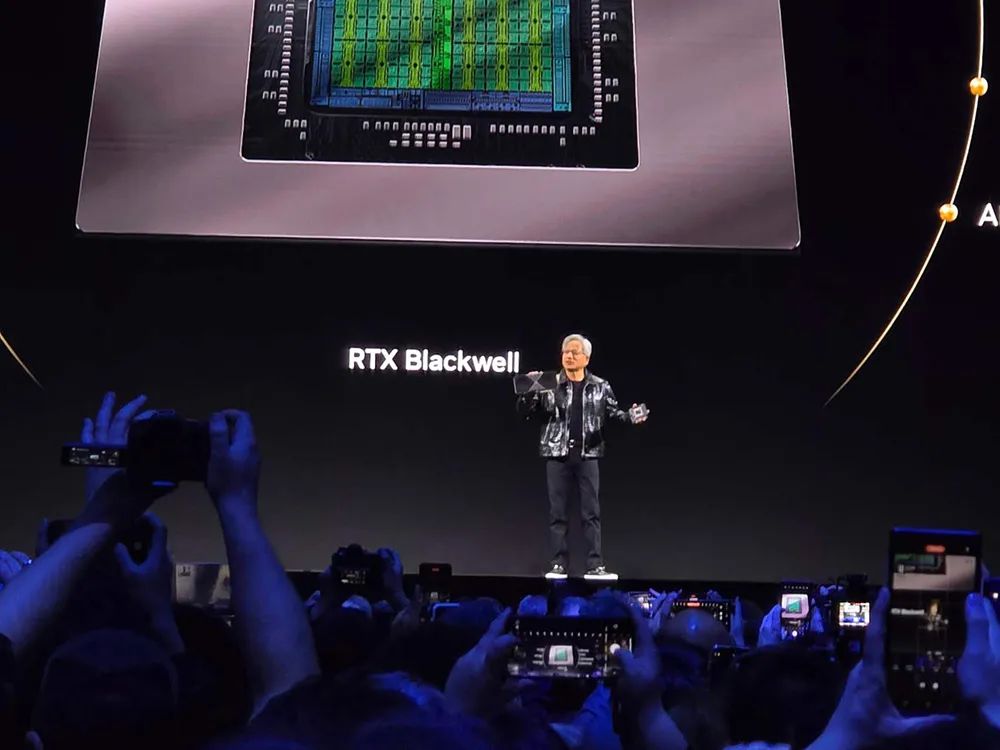

关键观点1: RTX 50系列显卡发布

英伟达发布了新款RTX 50系列显卡,包括RTX 5090、RTX 5080和RTX 5070等型号。这些显卡具有强大的AI性能和光线追踪能力,是消费级市场的重磅产品。

关键观点2: 全球最小AI超级计算机Project DIGITS发布

英伟达推出了全球最小AI超级计算机Project DIGITS,能够运行高达2000亿参数的AI模型。它采用了全新的GB10 Grace Blackwell超级芯片,是掌上AI超算的一种形式。

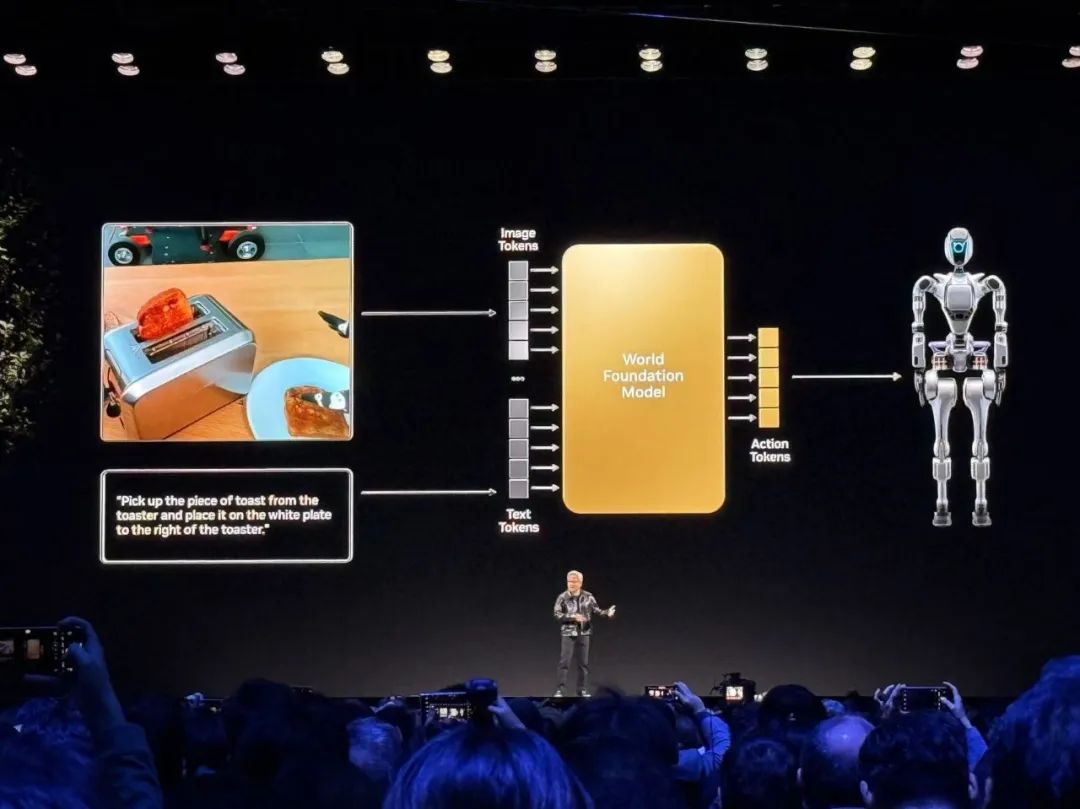

关键观点3: 世界基础模型开发平台Cosmos推出

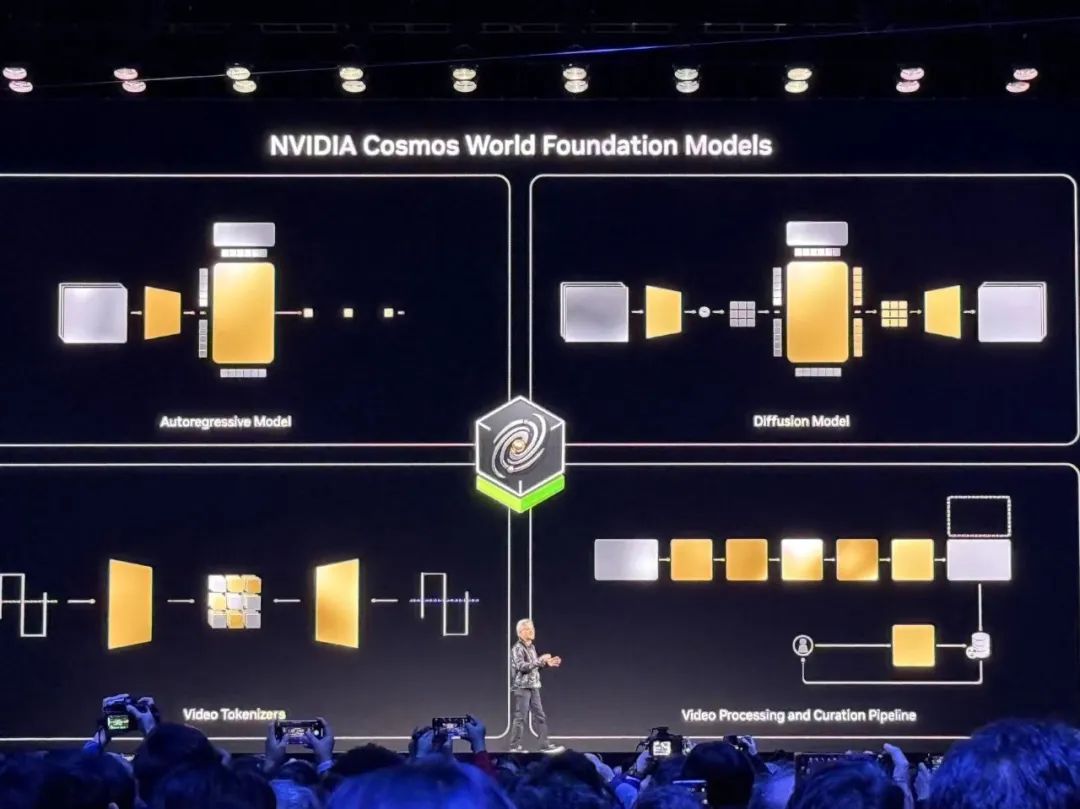

英伟达发布了世界基础模型开发平台Cosmos,专为开发机器人和自动驾驶而设计。它拥有开放的扩散和自回归模型,以及先进的视频tokenizer、护栏和加速数据处理流程,旨在加速先进物理AI开发。

关键观点4: AI性能提升和新技术发布

英伟达的新技术和产品包括DLSS 4、RTX神经网络着色器、全新ACE技术等,这些技术能够提升游戏的画质和性能,增强AI驱动功能,为开发者提供更多工具和平台来创建智能应用。

关键观点5: 企业级AI agents和合作伙伴

英伟达与多家合作伙伴合作构建AI Blueprint,旨在帮助企业快速将AI agents投入生产。这些AI agents具有代理型AI和物理AI的能力,能够在各行业创造智能和生产力。

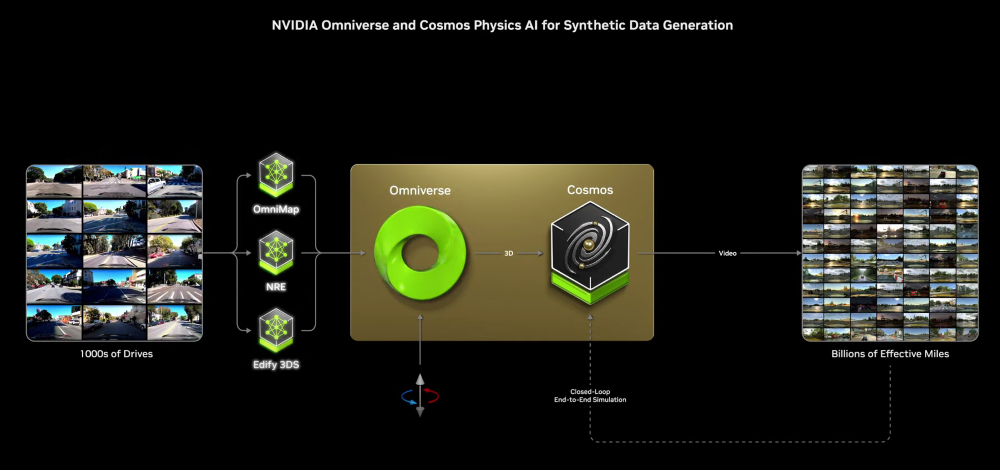

关键观点6: 自动驾驶和机器人技术的进展

英伟达发布了适用于自动驾驶和机器人技术的新产品和技术,包括Omniverse Blueprint和Isaac GR00T合成运动生成Blueprint等。这些技术将帮助开发人员更容易地为物理AI构建数字孪生,并加速自动驾驶汽车的开发和测试。

正文

智东西拉斯维加斯1月6日报道,今日,在年度“科技风向标”国际消费电子展(CES 2025)开幕前夕,英伟达创始人兼CEO黄仁勋发表主题演讲,智东西作为受邀媒体从现场发来报道。

“皮衣老黄”不愧是科技圈顶流,演讲火爆程度堪比热门明星演唱会,开场前2个半小时门外已经排起长队。

18:42,热场音乐戛然而止,会场霎时从人声鼎沸转为屏息凝神,一段开场视频后,黄仁勋穿了件闪亮的新皮衣,意气风发地走上演讲台,与现场观众寒暄。

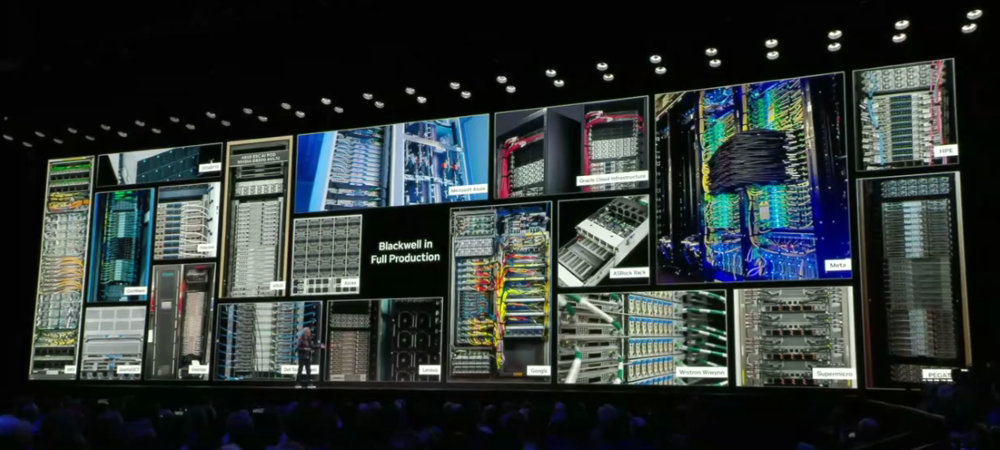

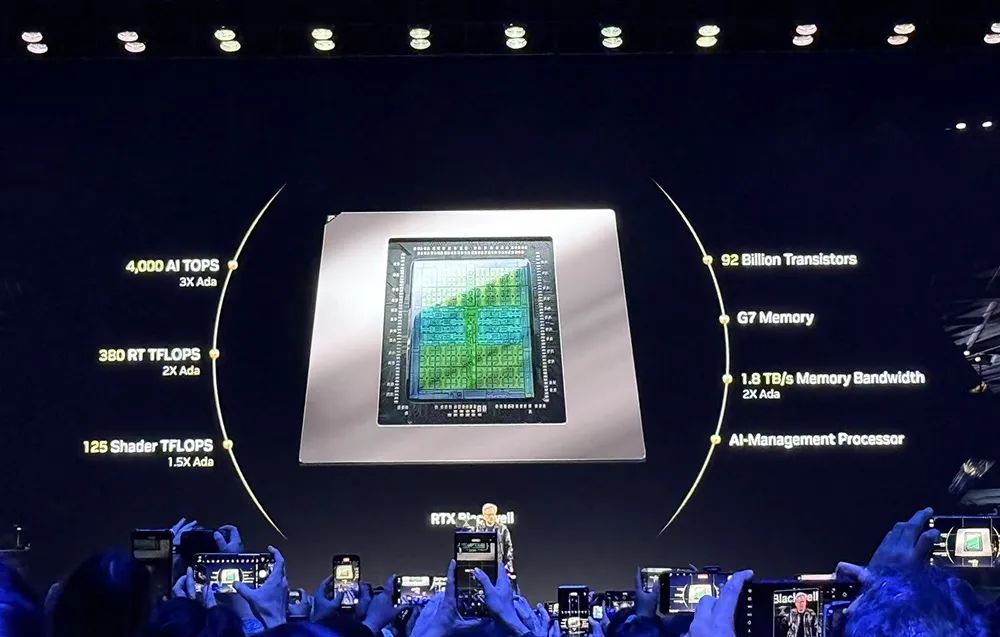

皮衣开光追是假,但新显卡GeForce RTX 50系列的光追是实打实的强。黄仁勋称Blackwell融合了AI驱动的神经网络渲染和光线追踪,是英伟达自25年前推出可编程着色技术以来最重要的计算机图形创新。

新一代旗舰显卡RTX 5090无疑是年度重头戏之一。RTX 5090拥有920亿颗晶体管,AI算力最高达3352TOPS ,性能达到RTX 4090 D GPU的2倍(得益于架构创新和DLSS 4)。

演讲期间宣布的RTX 5090售价1999美元,RTX 5080售价999美元,RTX 5070Ti售价749美元,RTX 5070只卖549美元。对于国内台式机用户,拥有2375 AI TOPS的RTX 5090 D售价16499元,拥有1801 AI TOPS的RTX 5080售价8299元,将于1月30日上市。拥有1406 AI TOPS的RTX 5070 Ti建议零售价为749美元,拥有988 AI TOPS的RTX 5070建议零售价为549美元,产品将于2月上市。5080和5070Founders Edition京东在售。RTX 5090、RTX 5080、RTX 5070 Ti笔记本电脑将于3月上市,RTX 5070笔记本电脑将于4月由全球领先OEM发售。

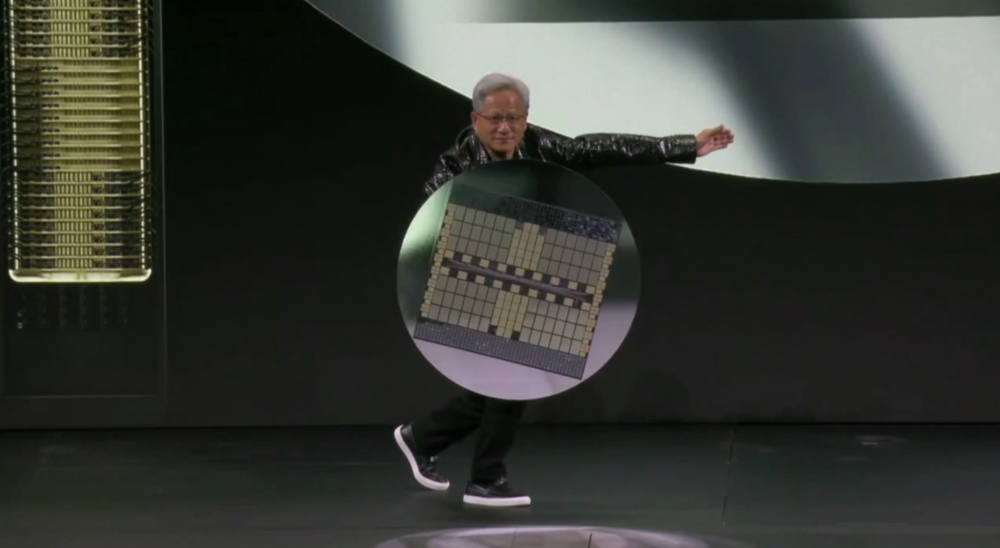

作为英伟达2025年第一场重磅发布活动,猛料当然不能只有消费级显卡。光是在硬件上,黄仁勋就接连整活儿,先搬出一个由72块Blackwell GPU组成的NVLink72巨型“盾牌”,并现场cosplay起美国队长,引起现场观众的欢呼。

在最后的One More Thing环节,黄仁勋发布单手可持的全球最小AI超级计算机Project DIGITS,搭载全新GB10超级芯片,小到能塞进口袋里,堪称“掌上超算”。如果将两台相连,能跑4050亿个参数的AI模型,3000美元起售。

此外,黄仁勋连珠炮般亮出一大波全新基础模型,以及面向AI agents、物理AI、人形机器人、自动驾驶的多款新品。作为科技圈知名“预言家”,黄仁勋对AI的前瞻性判断,对接下来科技产业走向极具参考价值。他判断在感知AI、生成式AI后,AI浪潮的下一站是代理型AI(Agentic AI),再之后是物理AI(Physical AI)。黄仁勋相信,机器人的ChatGPT时刻即将到来,而世界基础模型对于推进机器人和自动驾驶汽车的开发至关重要。

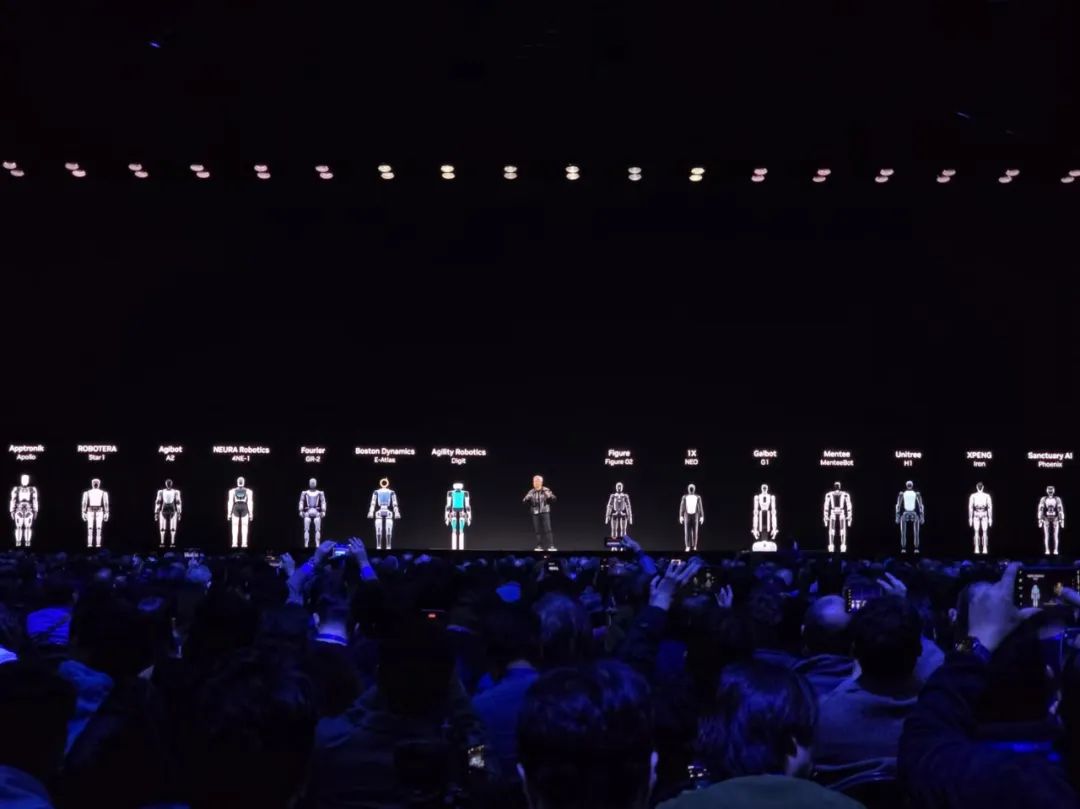

黄仁勋还现场公布了一些人形机器人、自动驾驶汽车合作厂商。其国内人形机器人合作伙伴有银河通用G1、宇树科技H1、小鹏“老铁”等,国内自动驾驶合作伙伴有比亚迪、理想、蔚来、小米、极氪等。

英伟达GeForce RTX 50系列是第一款支持FP4精度的消费类GPU,将FLUX等模型的AI图像生成性能提高到上一代硬件的2倍,并能在更小的内存占用中本地运行。该系列GPU还内置第九代NVIDIA编码器,用于高级视频编辑,支持4:2:2专业级色彩格式,并配备DLSS 4和32GB VRAM,以解决大规模的3D项目。

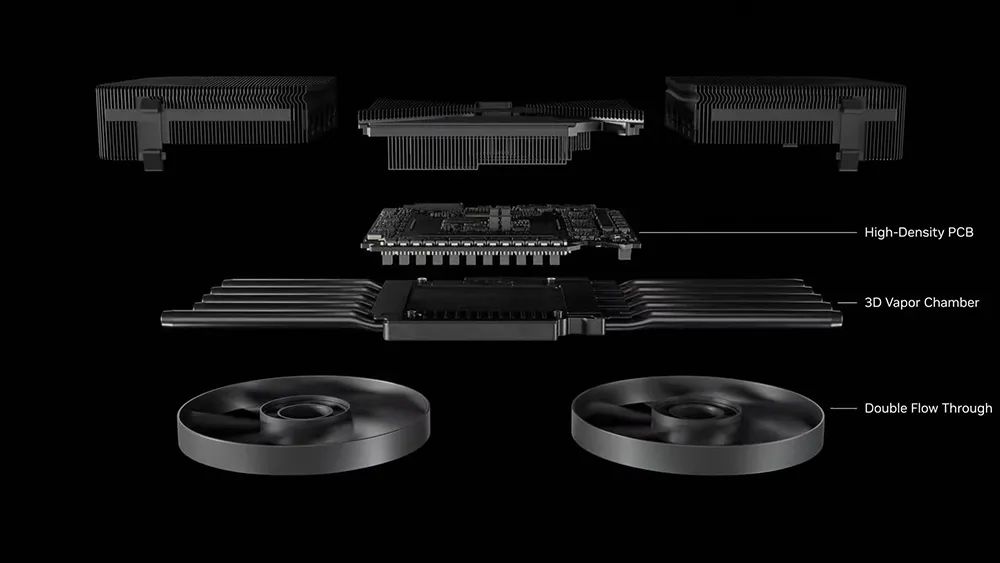

RTX 50系列采用Blackwell架构、第五代Tensor Cores、第四代RT Cores,在AI渲染领域,包括神经网络着色器、数字人技术、几何图形和光照等方面取得突破。基于Blackwell架构的NVIDIA Max-Q技术最高可延长电池续航时间达40%。

DLSS 4首次推出多帧生成技术,借助AI可为每个渲染帧生成多达3帧,从而进一步提高帧率。该技术可与全套DLSS技术协同运行,相比传统渲染技术相比,性能提升高达8倍,同时通过NVIDIA Reflex技术保证响应速度。

DLSS 4还引入了图形行业第一个实时应用的Transformer模型架构。基于Transformer的DLSS超分辨率和光纤重建模型有2倍的参数量和4倍以上的计算量,可提高画面稳定性,减少伪影,增加细节并增强抗锯齿效果。超过75款游戏和应用程序将在RTX 50系列上支持DLSS 4。

此外,NVIDIA Reflex 2引入了Frame Warp创新技术,可在将渲染帧发送至显示器前,根据最新的鼠标输入信号对其进行更新,从而降低游戏延迟,相比原生渲染最高可减少75%的延迟,提高游戏响应速度。英伟达还推出了RTX神经网络着色器(RTX Neural Shaders),将小型AI网络融入可编程着色器,为实时游戏带来电影级的材质、光照等。RTX Neural Faces

只需使用简单的光栅化面孔和3D面部姿态数据作为输入,即可使用生成式AI实时渲染具有时间稳定性的逼真面孔,配备了全新的支持光线追踪毛发和皮肤的 RTX技术。全新RTX Mega Geometry可将场景中的光线追踪三角形数量至多增加100倍,提升游戏角色及环境真实感。RTX 50系列的出色AI算力能够在游戏渲染的同时为自主游戏角色提供动力。英伟达推出了一套新ACE技术,使游戏角色能够像人类玩家一样感知、计划和行动。由ACE驱动的自主角色被整合到《绝地求生》和即将推出的生活模拟游戏《InZOI》,以及Wemade Next的《MIR5》中。NVIDIA Broadcast应用为主播带来两项AI驱动功能:可升级麦克风音频质量的音棚音效(Studio Voice),可对面部重新打光的虚拟补光 (Virtual Key Light)。Streamlabs推出由NVIDIA ACE和Inworld驱动的智能直播助手,担任助播、制作和技术助手的角色以增强直播效果。

英伟达还发布了可在RTX AI PC本地运行的基础模型。这些模型作为NIM微服务提供,由RTX 50系列GPU加速。适配RTX AI PC的AI基础模型涵盖大语言模型、视觉语言模型、图像生成模型、语音模型、检索增强生成(RAG)的嵌入模型、PDF提取和计算机视觉模型等。NIM微服务及PC上运行AI的所有必要组件均已针对所有英伟达GPU的部署进行了优化。

黄仁勋提到英伟达想将AI放到PC上,希望让Windows PC成为世界级的AI PC,而一个方法是Windows WSL 2(Windows Subsystem for Linux 2),它有两个操作系统,针对云原生应用程序进行了优化,开箱即用。

为了展示如何使用NIM构建AI agent和助手,英伟达将发布来自Black Forest Labs、Meta、Mistral、Stability AI等顶级开发商的一系列NIM微服务和RTX AI PC的AI Blueprint。英伟达还推出了一款具有视觉能力的PC虚拟化身Project R2X。它能够让信息触手可及,协助用户使用桌面应用、视频电话会议、阅读和总结文档等。R2X将在数月内向RTX50系列和笔记本电脑用户开放下载。全球最小AI超级计算机:搭载GB10超级芯片,能跑2000亿参数模型

为了让AI超算能摆到每个人的桌上,英伟达发布全球最小AI超级计算机Project DIGITS,能跑2000亿个参数的AI模型。

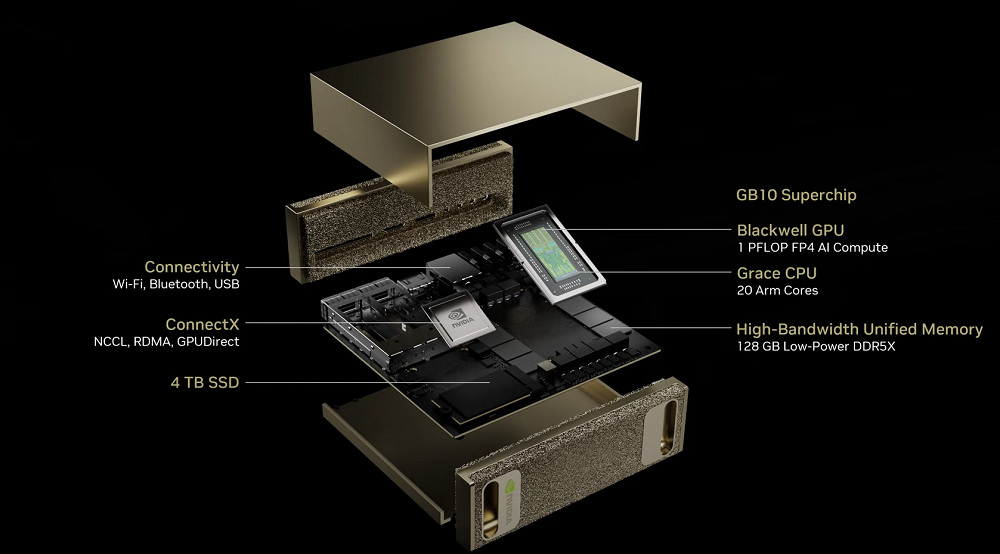

两台Project DIGITS可通过NVIDIA ConnectX网络连接,运行多达4050亿个参数的AI模型。这相当于是台掌上AI超算,采用了全新的GB10 Grace Blackwell超级芯片。

GB10由英伟达和联发科合作设计,通过NVLink-C2C互连技术将Blackwell GPU和有20个Arm能效核的Grace CPU连接,可在FP4精度下提供多达1PFLOPS的AI算力。每台Project DIGITS拥有128GB的高带宽统一内存和高达4TB的NVMe存储。Project DIGITS将于5月推出,3000美元(约合人民币2.2万元)起售。

英伟达判断代理型AI代表了生成式AI进化的下一波浪潮,使AI能解决复杂的多步骤问题、复杂推理和规划。对此,英伟达推出了Llama Nemotron系列开放许可的基础模型,为AI agents开发提供优化的构建模块:1)Nano(4B):最具成本效益的模型,针对低延迟的实时应用程序进行了优化,非常适合部署在PC和边缘设备上;2)Super(49B):在单个GPU上提供卓越吞吐量的高精度模型;3)Ultra(253B):精度最高的型号,专为要求最高性能的数据中心规模应用而设计。这些模型基于Llama构建,可帮助开发人员在一系列应用程序中创建和部署AI agent,包括客户支持、欺诈检测、产品供应链和库存管理优化。Llama Nemotron模型使用英伟达最新技术和高质量数据集进行蒸馏、修剪和训练,使模型足够小,能在各种计算平台上运行,同时提供高精度和增加的模型吞吐量,增强了agent能力,擅长指令遵循、聊天、函数调用、编程和数学。除了新模型外,英伟达与合作伙伴推出了多款生成式AI Blueprint,用于降低企业级AI agents的开发门槛。

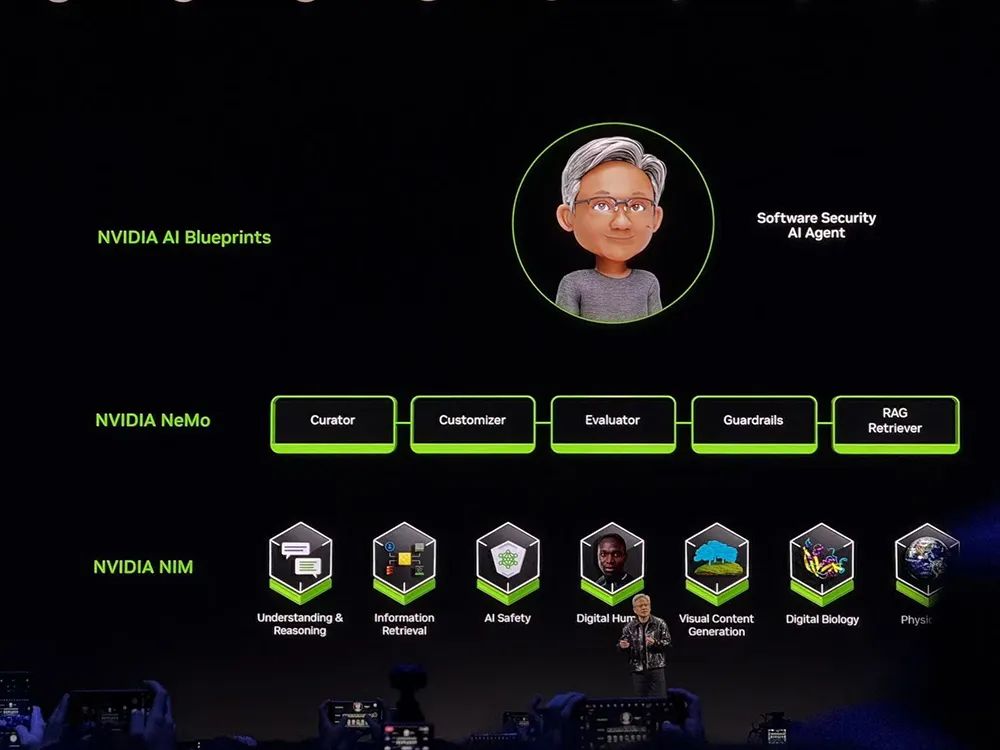

英伟达将AI Blueprint称作“构建AI agents的起点”,目标使全球2500万名软件开发人员能轻松将AI集成到各行业的应用程序中,为超10亿的知识工作者构建agents。AI Blueprint提供NVIDIA NIM微服务、NeMo和代理型AI框架,可实现AI agents的编排、管理和可追溯性。只需点击一下,开发人员就能构建和运行新的代理型AI Blueprint。有了AI Blueprint,开发人员可以构建和部署能做推理、规划的自定义AI agent并采取行动,并采取行动快速分析大量数据,从视频、PDF及图像中总结和提取实时见解。要管理、监控、协调多个AI agents一起工作,对编排系统提出很高要求。英伟达与CrewAI、Daily、LangChain、LlamaIndex、Weights & Biases五家代理型AI编排和管理工具供应商合作构建AI Blueprint,用于软件开发、实时语音对话、结构化报告生成、博客创建、AI虚拟助手等。

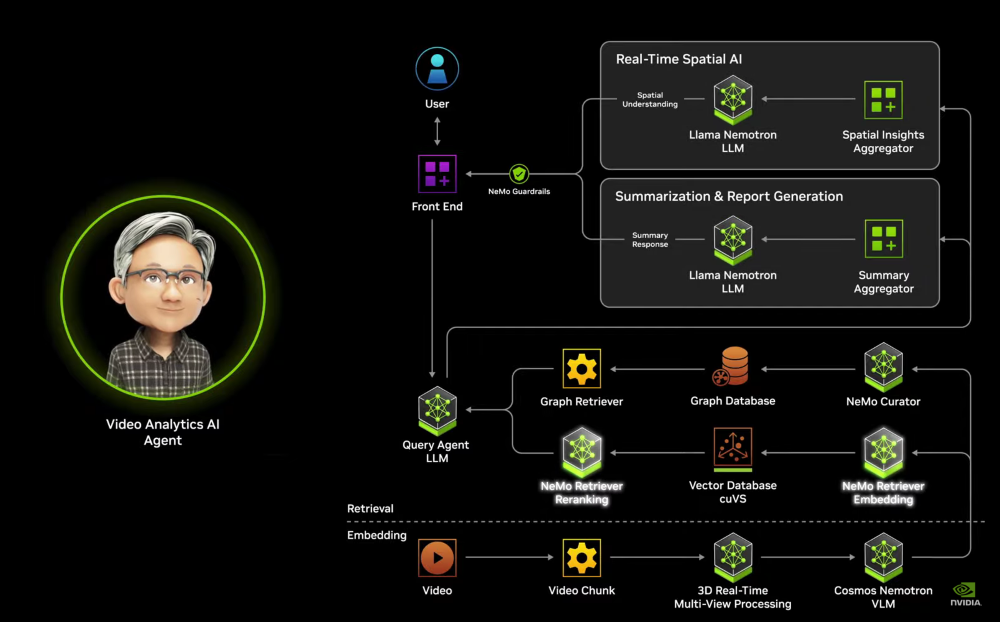

英伟达还推出了自家的两个AI Blueprint:一个用于PDF转播客,将复杂PDF文件轻松转换成好理解的、用自然声音叙述的对话式播客。另一个用于视频搜索和总结,构建于Metropolis平台上,由Cosmos Nemotron视觉语言模型、Llama Nemotron大语言模型和NeMo Retriever进行强化,提供了构建和部署可分析大量视频和图像内容的AI agents的工具。

为了帮助企业快速将AI agents投入生产,埃森哲宣布用NVIDIA AI Enterprise构建AI Refinery,包括NVIDIA NeMo、NVIDIA NIM微服务和AI Blueprint。埃森哲计划在今年年底前推出100多个AI Refinery行业agent解决方案。埃森哲与英伟达合作构建了12个全新行业agents解决方案,涉及公共部门招聘、电信代理协助联络中心、保险理赔承保、银行遗留现代化、消费品和服务的收入增长管理、生命科学临床试验伙伴、工业资产故障排除和B2B营销等。

物理AI将改变价值50万亿美元的产业,涉及1000亿的工厂、20万的仓库、未来数十亿计的人形机器人和15亿的汽车及卡车。自动驾驶汽车的发展由三种不同的计算机实现:1)DGX系统用于在数据中心训练基于AI的堆栈;2)在OVX系统上运行Omniverse用于模拟和合成数据生成;3)AGX车载计算机用于处理实时传感器数据以确保安全。这三款计算机同样被用来构建物理AI,在此基础上,英伟达今日发布了又一新组成部分——世界基础模型开发平台Cosmos。

Cosmos拥有一套开放的扩散和自回归模型,还有先进的视频tokenizer、护栏和加速数据处理流程,专为开发机器人和自动驾驶而设计,旨在加速先进物理AI开发。这些模型接受了18000万亿次tokens的训练,包括2000万小时的真实世界自动驾驶、机器人、无人机镜头和合成数据。模型也有3款:1)Nano(约15B):针对实时、低延迟推理和边缘部署进行了优化;3)Ultra(约70B):以获得最大的质量和保真度,最适合用于提取定制模型。当与Omniverse 3D输出配对时,扩散模型生成可控的、高质量的合成视频数据,以引导机器人和自动驾驶感知模型的训练。自回归模型根据输入帧和文本预测视频帧序列中接下来应该出现的内容,使实时预测下一个token成为可能。开发人员可使用这些开放模型,从文本、图像、视频等输入以及机器人传感器或运动数据的组合中生成基于物理的视频,也可以用其生成合成数据以增强训练数据集,还可以通过微调这些世界基础模型来构建定制模型。

其他模型包括:120亿参数上采样模型,用于精炼文本提示;70亿参数视频解码器,用于优化增强现实;护栏模型,确保可靠、安全地使用。相比最先进的方法,Cosmos的tokenizers提供8倍的总压缩和12倍的处理速度,在训练和推理方面提供了更出色的质量和更低的计算成本。Omniverse和Cosmos世界基础模型相结合,使开发人员能够更轻松地生成大量可控、逼真的合成数据,帮助物理AI模型做出更好的行动,还有助于减少世界模型相关的潜在幻觉。

1X、Agile Robots、Agility Robotics、Figure AI、小鹏、Foretellix、Uber、Waabi、Wayve等都采用Cosmos加速和加强模型开发。