陈桦 编译整理

量子位 报道 | 公众号 QbitAI

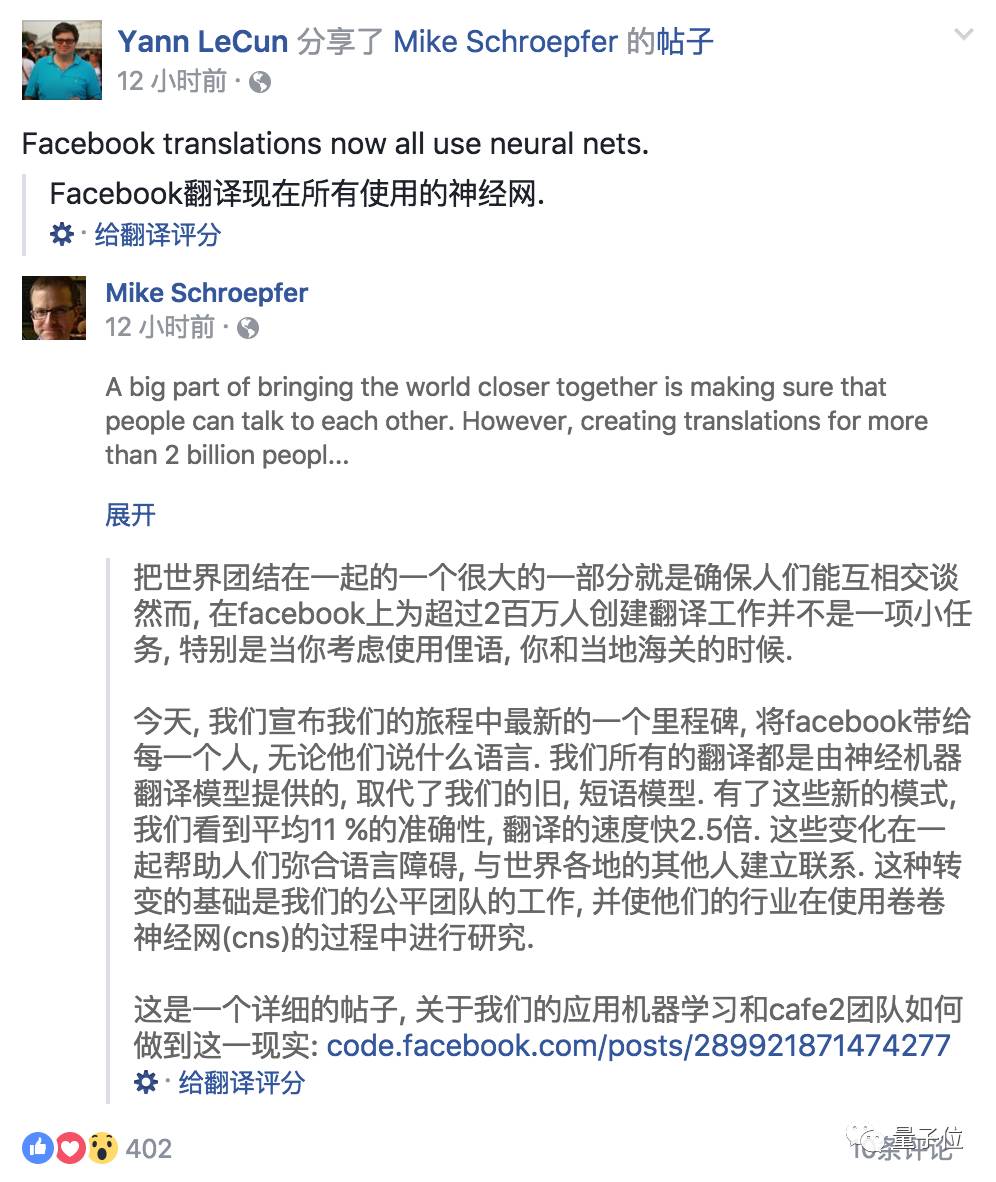

Facebook今天宣布,他们已经完成了向神经机器翻译技术的迁移。

换句话说,Facebook目前开始使用卷积神经网络(CNN)和递归神经网络(RNN)去自动翻译Facebook平台上的内容。

Facebook使用Caffe2深度学习框架来部署他们的神经机器翻译,同时还把他们为这个项目开发的LSTM等RNN模块作为Caffe2的组件开源出来。

量子位立即去测试了一下,效果……还算能看懂:

谷歌、微软和Facebook开发神经机器翻译技术已有一段时间,这些公司同时也在抛弃老式基于短语的统计机器翻译技术。

相对基于短语的方法,基于神经网络的方法更有前景,而最重要的是这种方法能带来更准确的结果。

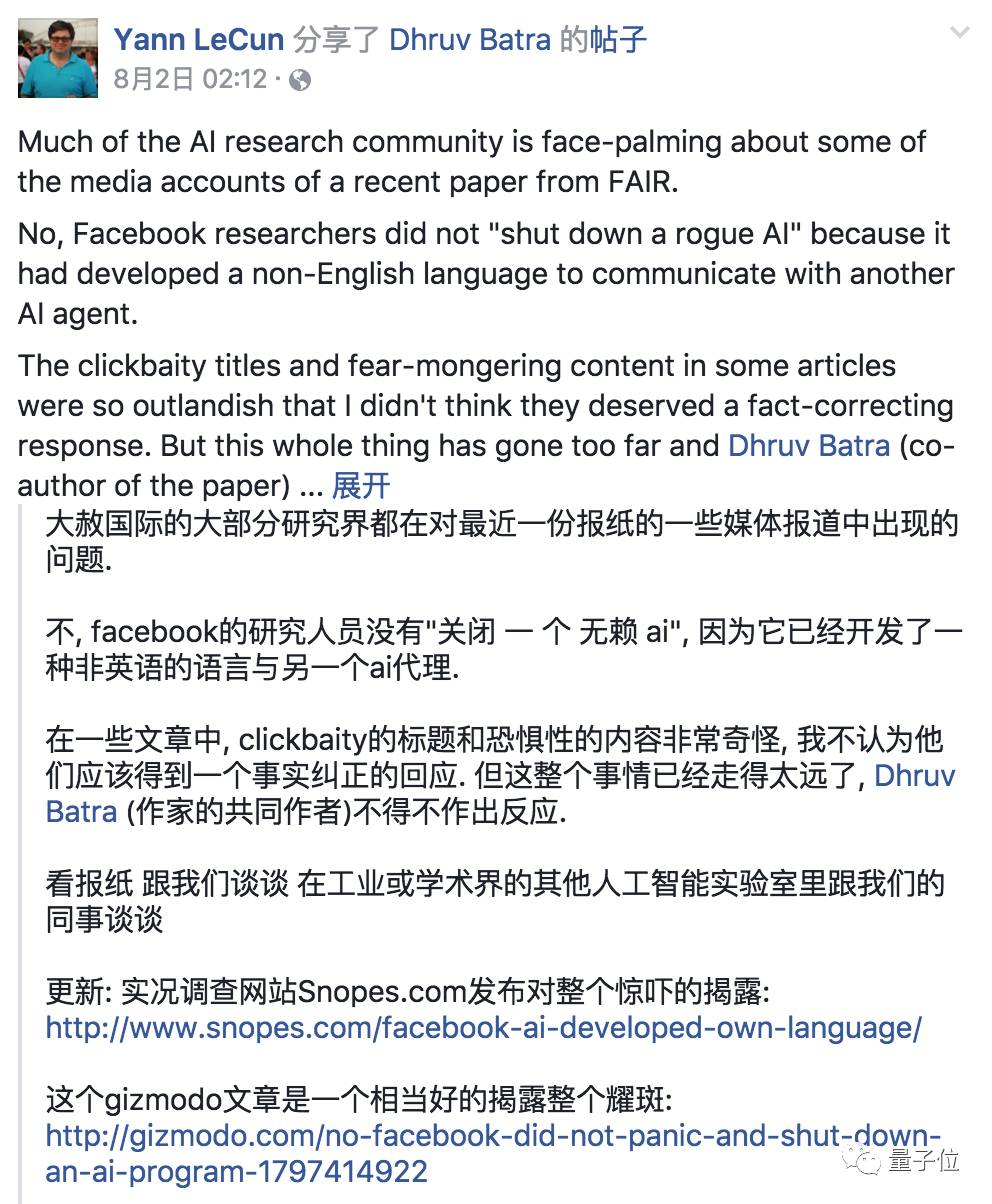

当然,“准确”只是相对的,神经网络仍需努力,比如说这段反驳“Facebook AI失控事件”文字:

传统机器翻译的原理很简单。利用关键短语,基于短语的系统可以翻译整个句子,随后通过概率方法来输出最终翻译结果。

与此不同,神经网络模型进行了层次更高的抽象化处理,将句子表达变成了多维向量表示的一部分。这意味着,系统尝试根据“上下文”,而不仅仅是短语来翻译。

这样的机制并不完美,研究者仍在探索,如何处理长期依赖关系(即在长文本中确保理解能力和准确性)。不过,这种方法仍然很有前景,并且已经带来了不错的结果。

2016年9月,谷歌宣布了向神经机器翻译发展的第一步。两个月后,微软也宣布了类似的消息。

ACL昨天评出的最佳论文奖

之中,也有一项颁给了一篇神经机器翻译论文:OpenNMT。

Facebook在这方面的工作已持续了约1年,而目前正在启动技术的全面部署。

Facebook人工智能研究部门(FAIR)今年5月发表了自主研究结果,并在GitHub上开源了相关的CNN模型。

Facebook语言技术团队工程经理Necip Fazil Ayan表示:“我们的问题与大多数标准场合不同,这主要是由于我们在Facebook上看到的语言类型。我们看到了许多非正式用语和俚语缩写。语言的风格差异很大。”

利用新的神经机器翻译技术,Facebook的翻译质量提升了10%。

关于

Facebook将CNN用于机器翻译

的详情,见该公司博客文章:

https://code.facebook.com/posts/289921871474277/transitioning-entirely-to-neural-machine-translation/

关于Caffe2的RNN模块:

https://caffe2.ai/blog/2017/08/03/caffe2-adds-RNN-support.html

关于Facebook的CNN机器翻译,详情见

论文:https://fb.me/convolutional-s2s.pdf

代码:https://github.com/facebookresearch/fairseq

8月9日(周三)晚,量子位邀请三角兽首席科学家王宝勋,分享基于对抗学习的生成式对话模型,欢迎扫码报名

▼

量子位AI社群6群即将满员,欢迎对AI感兴趣的同学加入,加群请添加微信号qbitbot2;

此外,量子位的专业细分群(

自动驾驶

、

CV

、

NLP

、

机器学习

等)正在招募,面向正在从事相关领域的工程师及研究人员。

进群请添加微信号qbitbot2,并务必备注相应群的关键词~通过审核后我们将邀请进群。(专业群审核较严,敬请谅解)

量子位正在招募编辑/记者,工作地点在北京中关村。期待有才气、有热情的同学加入我们!相关细节,请在量子位公众号(QbitAI)对话界面,回复“招聘”两个字。