雷锋网消息,

7月7日,为期三天的「CCF - GAIR」大会,在深圳大中华喜来登酒店开幕。今天的第三位讲者是Subbarao Kambhampati教授,他现在是AAAI(美国人工智能学会)的主席,同时他也是亚利桑拿州立大学的教授,他主要的研究是在自动化的决策机制,特别是在人工感知的人工智能领域。

同时他也是一个非常知名的教授,他花了很多的时间,同时特别提到了关于人工智能对于人类感知以及社会的影响,同时他自己本人也是AAAI的成员,他也在很多的国际机构任职。他在2016年的大会的项目,以及2016—2025的AAAI项目当中提供相关的咨询服务。

Subbarao为我们讲述了人工智能的兴起,人工智能与人类学习模式的不同,一些人工智能的挑战,关于人工智能伦理的一些思考,最后还介绍了他进行的研究。

雷锋网将其演讲内容进行了整理。

机器学习的过程与人类不一样

人工智能在过去并不十分受重视,但是现在,越来越多的媒体关注人工智能。很多国家也希望AI能带来变革。但机器的学习过程与人类是不一样的。人类会观察这个世界上的事物,然后开始有了情感的智能,然后他们有了社会的智能,另外他们还会有感知的智能和推理的智能。而机器的过程则相反。不一样的原因是:计算机解决问题的方案跟人类解决问题的方案是不一样的。

谈谈世界的格局

AI可以帮助我们的孩子进行基础知识的积累。未来的人工智能推理技能将会得到极大的提高。但是现在的AI技术大热可能会蒙蔽我们的双眼,看不到它的前景。现在我们的AI做得还不够,我们还可以有超智能。例如应用在犯罪分子行为预测。

如何谨慎地使用人工智能

像犯罪分子行为预测这样的系统是非常有争议的,必须要有合理、公平、道德的理由。AI现在是强有力的技术。很多公司对其进行了商业化,所以我们需要促进审慎的、有伦理的AI的发展。同时,我们在人工智能领域还有很多挑战,例如,如何让机器能理解语言背后的含义,如何让人工智能对世界有完整的理解,如何让人机交互不会有不良事件。

人工智能和人类应该如何交互

Subbarao也告诉了我们在人工智能与人类交互方面,我们应该关注的部分:

-

我们能看到人工智能的正面报道,也能看到负面的。负面报道,我们必须关注

-

有意识的人工智能,如何让人和机器能有效协作

-

人类希望能够有能够感知的机器人与自己对话

他认为,人类会对周围的环境、事物有情感上的反应。这是我们的情感的智能和社会的智能。我们需要社会的智能和情感的智能来弥补机器所不具备的这两部分的技能。

此外,Subbarao还向大家介绍自己的研究,其研究的主要目的主要是能够对人类情感做出识别,并推测人类动作的意图和期待。最后,他还向大家做了一个简短的关于AAAI(美国人工智能学会)的介绍。

以下是雷锋网整理的Subbarao演讲速记:

我来自亚利桑那州立大学,我今天将和大家共同探讨一下AI的崛起以及人工智能的发展,非常感谢主办方邀请我来中国,这也是我第三次来到中国。

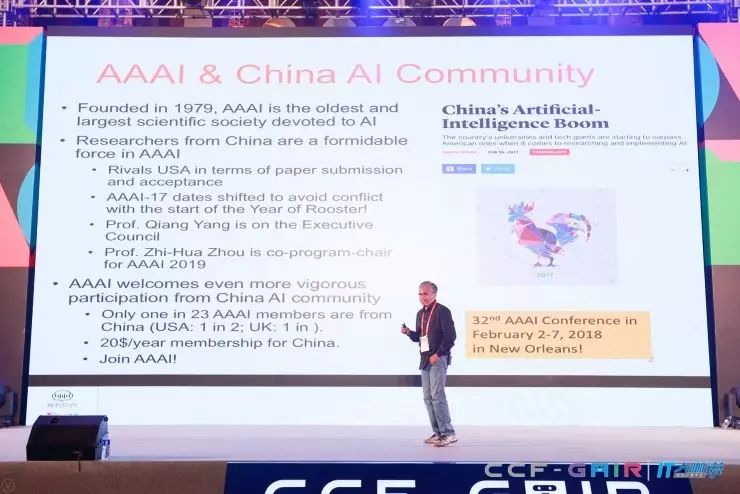

就像刚才大家提到的,我也是AAAI的主席,首先我向大家简单介绍一下AAAI,AAAI主要是关注于人工智能的研发机构,它同时也是人工智能界最为久远的一个科学研究机构,它是在1979年建立的,它现在拥有大量的成员机构,同时AAAI也举办了目前全顶尖的人工智能论坛和相关的活动。我特别要提到的是,中国已经成为了AAAI非常重要的一员,有来自中国的很多的学者,特别是在中国加入之后,目前在我们整体的AAAI论文的提交数量,以及包括我们的科研提交量上,我们的文章的接受量已经远远超过了美国,而在去年AAAI会议计划在中国昆明举办,因为是春节期间,我们看到很多中国的开发者没有参加。徐扬生教授也是AAAI2019年执委会主席。

AAAI人工智能年会现在已经得到了来自中国人工智能学界和研究界的大力支持。参与我们人工智能年会的人数以及中国成员的人数是比较少的,尽管他们的论文提交量比较高,所以我也希望在未来能有越来越多的人参与人工智能年会,把我们的年会变得越来越国际化,让我们倾听来自中国的人工智能专家的声音。同时我们也希望大家能够注册成为AAAI的会员。在中国的会员身份一年是交20美金的会费,学生是18美金,所以对各位来讲,如果加入这个人工智能年会是一件很简单的事情,花费也不高。

当大家加入到AAAI这个协会里边,我们是一个人工智能的组织,你们会看到各种各样、各个地方的人工智能的专家,你会看到一些印度的人工智能专家,他们也在中国,我也会互相的进行会员的介绍。

因为我担任AAAI的主席,所以我简单给各位介绍一下AAAI,最核心的信息就是欢迎大家成为AAAI的会员。

今天我主要要讲的就是人工智能。现在人工智能有一个非常有趣的话题,就是有意识的人工智能,有意识的人工智能除了它自己的特点之外,还有什么样的挑战呢?另外我还会再讲一讲有人工意识的人工智能,因为这个人工智能的细分方向在未来可能会得到学界的大量的关注,并且这个问题的研究也是充满了挑战。

人们现在一般都在讲AI做不了什么,但是当我在马里兰大学读书的时候,我读到了一本书,但是我读了这本书之后,我发现人工智能还有很多能做成的地方。所以后来我们看到了谷歌,每天我订阅谷歌的信息,他们把关于人工智能的所有信息都发给我,可以说在每一天收到的所有的文章里面都有至少一篇是关于人工智能的,而现在我们看到越来越多的文章和新闻,以及媒体都在关注人工智能,而且这些文章越来越离谱,今天早上我收到一篇文章说人工智能是不是被炒得太热了,大家能够看到在人工智能的领域,现在有很多有趣的情况,也有很多的公司正在使用着AI的技术来从事某种业务,比如进行股东大会,在2018年可能越来越多的人还会再讲到AI,而在之前没有人这样讲,在2017年的时候我们已经开始听到或者看到有股东大会在使用AI技术。当然,各国的政府也正在关注AI,在美国奥巴马执政期间,美国政府有一个面向未来的计划,这个计划也主要是关注人工智能,奥巴马说,他希望整个美国都能够被AI技术变革,当然我们也看到同样的国家执政者,在中国也是一样的,希望大力去发展AI技术,变革中国的生产力。

当然,AI热带来的一个信息是什么呢?就是像我这样的科学怪人能够有机会上镜,在电视上大讲AI技术,在之前像我们这些做研究的学界的人士是没有机会到电视上的,现在我们被邀请到电视上讲一讲人工智能,讲一讲机器人。

今天我想讲什么呢?就是考虑到我刚刚讲的这些大的背景,在座的各位观众可能有的是研究AI的专门,有的是初学者,我给大家简单地做了一个梳理,来帮助大家了解为什么现在AI变得这么热。我们先想一想人的智能,我们看看宝宝,人类的宝宝在出生的时候,他们开始有一些特征和行为,在早期的时候,孩子会有感知和模仿的能力,他们会观察世界,然后他们会去模仿我们的行为。这是我妻子的学生做的一个图,他用这个图来看他的孩子在吃饭的时候做一些简单的行为。另外,在孩子成长的过程中,他们会逐渐看这个世界上的事物,然后他们开始有了情感的智力,然后他们有了社会的智能,另外他们还会有感知的智能和推理的智能,比如说大家去上学,在上学的时候就培养我们自己的感知能力和推理能力。当然,在大学、中学和小学,我们都要进行各种各样的考试来培养和锻炼我们的感知能力,这就是人类如何去发展自己的智能的。

我们再看一下AI,在90年代的时候,我们有一个专家系统,这个专家系统是一种基于规则的系统,当时许多企业都开始采用这种基于规则的系统,当时所有主流的公司都会用这种规则系统,在90年代的时候有深蓝计算机,它和俄罗斯的国际象棋手进行了比拼,并且获胜,所以那时候计算机开始有了推理的技能,到2000年的时候我们看到有深蓝的升级版本。深蓝能够在一个蛋糕和一个棋子中间进行感知和选择。在那个时候深蓝计算机本身还没有感知的能力,而在2000年之后,我们会看到现在最新的一些AI技术,让我们的AI有了感知的能力。另外,他们开始进行语音的识别、图象的识别,而且我发现如果把语音和图象的识别跟感知结合在一起,将会是未来一个很火热的话题。从过去到现在,人类是从感知到智能,而机器是走了一条相反的路,所以机器的学习跟人类的学习是不一样的。

为什么机器或者是AI的学习跟人类的学习是相反的呢,它们为什么不是先去感知,然后再去观察呢?我们就必须要了解一下计算机解决问题的方案跟人类解决问题的方案是不一样的,计算机看到一个东西,它会有自己的思维,而如果人看到一个东西,它会去进行描述,另外它还会跟别人进行争论和探讨,所以对人类来讲,人类的学习模式是更适用于人脑的,而机器的学习模式是适用于机器的,所以对机器来讲,推理是非常难的。

我们再看一下今天的整个世界的格局。如果我们的机器的感知能力变得越来越好,现在的孩子花六七年的时间积累和了解、学习这个世界上的知识,如果机器在未来能够有感知能力,它们就能帮助我们的孩子进行基础知识的积累。另外,我也不是讲相比人类,人工智能显得并不是那么重要,在未来人工智能的推理技能将会得到极大的提高。而且不光是学习,机器对于视觉的信息和图象的提取都会变得越来越好。另外,在未来我们还会训练机器去进行说、理解和解释这样的连环的培训。

现在AI技术为什么变得大热呢?这是因为我们发现在现代的AI技术之下,我们能够通过人工智能的技术,让我们的手机看到我们所看到的世界,并且这个手机还能把它看到的信息跟我们进行反馈。如果我们能够实现这样的人机互动,每个人都能够去用人工智能,大家都能知道在最新的围棋比赛中,如果我们能够使用这种人机共识或者是共同工作的状态,在未来AI技术会得到更大的应用。同时,这个现象也有一些副作用,我们在生产生活的各个方面都看到AI技术的使用,在漫画里边大家能够看到,当深蓝计算机跟人类的棋手进行比赛的时候,它说“这是1970年,你不要跟我讲AI,这时候AI技术还没有这么智能”。现在又走到了另一个极端,任何一个行业都在讲AI,而深蓝以及AlphaoGo,这些机器每天都在跟人类的智能进行比较和衡量。所以现在大家看到任何东西都要言必讲AI,因为这是人们愿意听到的,这也是AI大火带来的一个负面作用。我觉得AI技术的大热可能会让我们蒙蔽了双眼,不能看到它未来的前景。

现在当然我们能够做图象的抓取,能够做语音的识别,但是这就够了吗?

这是阿基米德,他是希腊的哲学家,他说“如果你给我一个支点,我就能够撬动地球”。现在人们说,如果你给我一个足够大的GPU和足够大的数据,我就会给大家创造出超智能。这种超智能看起来可能比较滑稽,但实际上它给我们彰显了在未来人工智能的一个新的前景,那就是超智能。

现在我们必须要去吸取早期在80年代、90年代在深度学习和大数据方面所走过的弯路,并且看未来一步怎么走。这就给我们带来了一些关于AI的风口期,我们都知道到目前为止,AI的发展是非常快的,但是也有人认为AI走向了冷冻期。当然很有意思的一点,去年有一家公司说,我们可以使用面部识别的方法告诉你这个人到底是不是犯罪分子或者是恐怖分子,这样我们可以建立起一个机器学习的系统,最终能够帮助我们去预测哪些人可能会成为恐怖分子,这是一家以色列的公司,但是我并不确保这到底是不是所谓的人工智能的系统。在中国,人的智商也是非常高的,在去年我们可以看到有一个来自中国的数据。我们如何使用面部识别的方法,能够帮我们进行人的面部的感知,以及包括一个推理,如果大家去到警察局,可能会看到有大量的人的照片,然后在云端寻找这些数据,同时通过深度学习来进行推理,预测这些人是否会出现任何的犯罪行为。这些照片显示的都是中国人,不是说他们都是犯罪分子,我们只是拍了他们的照片而已。

通过机器学习,可以进行犯罪分子预测行为的准确性达到95%,可以甄别谁是犯罪分子,谁不是犯罪分子,它可以通过我们帮助社会上的人是不是犯罪分子,但是这样的系统也出现了很多争议,大家在探讨这到底是不是人工智能的一个好的应用,这样的方法是不是能够使用在智能的犯罪分子的预测上。这篇文章要让我们设想一下,为什么我们要在人工智能方面谈伦理学,我特别谈到这一点,对于任何复杂、强大的技术,我们都要思考一下,我们到底应该如何使用它,如何用一种谨慎的方法来使用他。当AI在发展的过程中,很多人报道关于AI的技术,我们谈到的只是技术本身,我们现在也要探讨在人工智能方面的一些伦理方法,以及包括在技术使用上的伦理道德的原则。

这就让我想起了另外一个组织,就是人工智能的合作伙伴关系,这个组织是由世界上非常知名的谷歌、微软,以及脸书、IBM等等几大公司发起的联盟,我也是作为一个AI部门的理事加入到这个联盟,我们这个组织最重要的目的,就是希望通过这个组织帮助我们了解,如何用有社会责任的方式来使用人工智能的技术。我们确实做出了很多的技术变革和技术发展,但是我们不希望用这个技术决定谁是犯罪分子,谁不是,因为这样的做法实在是太疯狂了。同时我们也可以探讨其它的AI技术的使用,可能会造成人的隐私的泄露,或者是影响到公民的权利,从这一点来讲,就是我们建立这个联盟的原因,而我本人也是这个联盟的理事。从我个人的角度来说,我们提到了关于安全重要的人工智能,以及包括一个公平、透明、可信的、问责制的AI,以及包括人和人工智能系统之间的合作。