本文讲述了图书李的个人经历与转行决策。他从苏州大学硕士毕业后加入大厂从事模型推理工作,期间经历了计算机视觉算法的研究和模型压缩与推理加速方向的转变。他基于个人经验和行业趋势分析,选择了模型压缩与推理加速作为新方向,并通过深蓝学院课程的学习,成功提高模型推理加速的倍数,并获得了实习和项目经验。他还推荐深蓝学院的深度学习模型推理加速课程,并介绍了课程亮点和目标。

图书李硕士毕业于苏州大学,曾在计算机视觉算法领域研究,因对深度学习/大模型的算法更新迭代的压力以及对模型落地部署技能点的看重,最终选择转向模型压缩与推理加速方向。

图书李的决策基于三点分析:模型部署岗位的广泛需求、大模型落地部署对压缩与推理加速技术的需求以及未来前景的看好。

图书李通过深蓝学院联合腾讯高级研究员杨伟光老师的课程,成功将模型推理加速倍数提高到8.3倍,并获得课程优秀学员的称号。这段经历为他带来了实习和项目经验,进一步提升了他在模型压缩与推理方向的价值。

图书李特别推荐了深蓝学院的深度学习模型推理加速项目实践课程,课程亮点包括实战学习、深度理解原理以及完善的答疑服务。

大家好,我是图书李,硕士毕业于苏州大学,今年6月毕业加入了大厂做模型推理的工作,毕业时拿到了华为南研所、腾讯北京等6家企业offer。研一研二期间,我是做计算机视觉算法的,每天为提升模型在各大数据集上的精确率而绞尽脑汁,同时刷知乎时看到“计算机视觉算法岗的求职如同地狱般的难度”,于是开始纠结是否要继续做算法。直到参加在无锡召开的VALSE 2023,听到南京大学吴建鑫老师在分享模型轻量化、模型压缩以及推理加速的方向,自己非常兴奋,于是果断转到“模型压缩与推理加速”这个方向。(南京大学吴建鑫老师的分享开拓了我的视野)

当时自己的判断主要基于以下几点:

1. 深度学习/大模型的算法层出不穷,如果想产生新的idea,每天就得跟进新的paper,非常痛苦;

2. 不管模型如何变化,它总要在端侧落地部署,而端侧落地部署所需要的技能点,迭代速度远远没有模型本身的迭代速度快,可以不用每天刷paper,并且这个方向经验越多个人越增值,不至于被后浪轻易拍在沙滩上;

3. 大模型大一统AI各大方向已成为趋势,大模型的落地部署更需要压缩与推理加速的技术,未来前景也比较好。

基于以上3条分析,自己也查了一下模型部署的岗位,需求确实不少,更加坚定了我转方向的决心。面对新方向,想要快速入门,跟着行业大佬学习就是最高效的途径,没有之一。于是,我就搜索到了深蓝学院联合腾讯高级研究员杨伟光老师开设的『深度学习模型推理加速项目实践 』课程(Stable Diffusion与文心一言两个方向任选其一),整门课程自己认真学习了3个月,课程中要求的推理加速倍数为7.15倍,我尝试了课程中讲解的新的加速策略,最终将加速倍数提高到8.3倍左右(当时自己拿到了课程优秀学员)。去年秋季,凭借着我在这门课程的项目经历,拿到了一家大模型独角兽的实习offer,进一步提升自己在模型压缩与推理方向的价值,有了更丰富的实习以及项目经历,今年春季找工作时,幸运地拿到了多家企业offer。

如果你也想脱离整天刷paper的痛苦,模型压缩与推理岗位值得你考虑。这里,我也特别推荐深蓝学院的『深度学习模型推理加速项目实践』课程(Stable Diffusion与文心一言两个方向任选其一),以实战的形式帮助大家学习diffusion类、Transformer类大模型的推理加速技巧。

(TRT SD模型 L4 sec3-4 FP16溢出调试实践)

毕业后一直在腾讯从事深度学习加速及部署工作。近10年CUDA开发经验,近6年TensorRT 开发经验,Github TensorRT_Tutorial作者。

1.以实战的形式指导学员学习diffusion类模型的推理上线;

2.不仅教会大家如何做,更着重教懂大家为什么这么做;

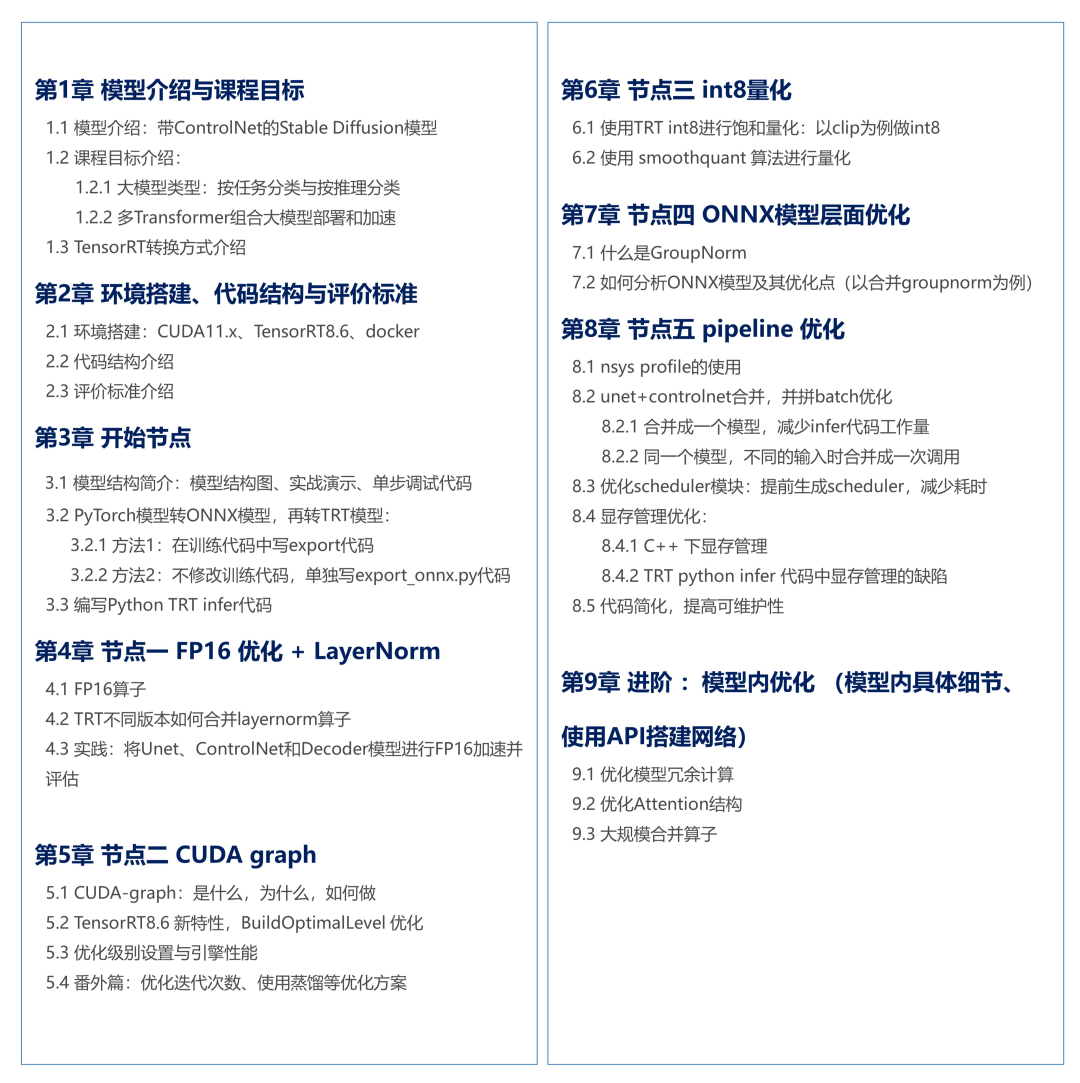

注:Transformer类模型的推理加速实战项目大纲,联系工作人员领取。

1.学习diffusion类模型的TensorRT加速策略

2.学习如何选择最优和性价比最高的加速策略

3.学习如何分析模型结构并进行合并加速