本文长度为

8765

字

,建议阅读

15分钟

本文探讨分享了用户行为数据的价值挖掘以及如何用用户行为数据做金融风控。

[导读]

如今,数据的概念已经被无限放大,人、事、物每天都在被数据化,从拥有数据、使用数据,到数据与人、场景、业务融合于一体,如何理解并利用好数据,将数据价值最大化,俨然已经成为商业蓝海中最璀璨的明珠。本期清华-青岛数据科学研究院主办的

大数据“技术·前沿”系列讲座

特别邀请【友盟+】首席数据官

李丹枫博士

,来到清华大学分享他从业十多年的宝贵经验和最新研究成果。李博士为我们揭开用户行为数据潜藏的巨大价值,解析如何攻克金融风控的突破口,让广告效果回归真实让用户在悄然间被触达、被服务。

以下为课程视频,建议在wifi条件下观看。暂时看不了视频的朋友,可观看下面的图文实录哦!

本期讲座将涉及很多概念,童鞋们要仔细阅读,高效利用搜索工具,数据之战的大幕即将开启……

后台回复关键词“清华大数据”可下载本课程PPT(限时七天)。

李丹枫:我非常荣幸作为一个讲师来到清华,从1995年清华毕业,再到两年前20年校庆回来,今天能够站在这里给大家分享一些体会,还是有点小激动的,毕竟是一个清华人。

我大致介绍一下在加入【友盟+】之前的经历。我博士毕业后先在美国FICO做了5年,当时参与的反欺诈模型是工业界用到的第一个能够实实在在应用的神经网络模型,虽然模型只有一层的隐含层,但当时全世界75%的信用卡交易都会经过这个模型的检验。离开FICO后,我去了雅虎,那几年正好赶上Hadoop开始流行的时候,因为Hadoop项目的创始人当时就在雅虎工作,我也有幸成为了Hadoop的第一批使用者。

后来,微软找到我说他们想建立一个团队,目的是想把微软必应这么多年积累的技术经验能够整合起来对微软其他部门进行输出,当时我们接到的一个比较重要的任务就是Xbox One,它的第一版的多媒体搜索是我的团队根据必应搜索的技术架构给他们设计的,现在我家里还保留着一台白色的Xbox One,是外面买不到的。

2014年,我回国加入了阿里巴巴。2016年初,阿里把CNZZ和另外两家阿里收购的公司友盟和缔元信这三家公司合并成【友盟+】,我成为了CDO。【友盟+】的数据是非常可观,这里有一些数字。

-

中国APP应用市场累积的APP数约为300万个APP,我们服务

125

万

个, 在top10000 APP中,我们的占有率约

70%

;

-

我们服务

680万

个网站,

上百亿

的URL;

-

每天监测到移动设备

14亿

,在国内是

11亿

,而中国有7亿多网民,差不多每个人有一到两台设备被监测到;

-

我们每天处理的事件数是

280亿

。

目前,【友盟+】有三大业务线基于一个数据智能底层平台—U-DIP,Data Intelligent Platform,业务大致包括U-Dplus(智能的统计分析服务产品),U-ADplus(数据为广告营销服务)和U-Oplus(新零售概念,将货、人、场景组合个性化匹配,把线下人的信息提供给商家,让他更好地服务客户)。(对【友盟+】业务感兴趣的同学可以网上查询作进一步了解,此处略过)

我们今天将围绕

第三方互联网与移动互联网用户行为数据的来源和应用

,这里先明确一个第三方数据的特点,第一它的深度不是特别深,假如你是一个银行的应用,你可能不会把你银行里的大家存款、交易的数据给我,只是打开APP登录了这个页面而已。但另一方面,第三方大数据范围会比较广,覆盖面比较大,今天我们讲的都是在这上面做得数据挖掘。

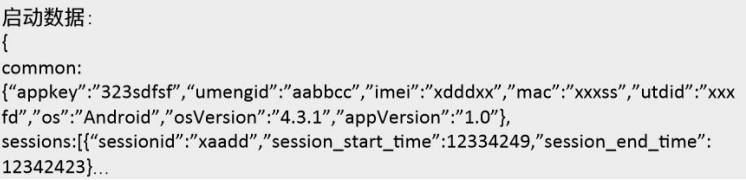

这是我们在APP SDK返回的原始数据的示意,这个SDK Android有一个版本,IOS有一个版本。在事件被触发的时候被返回的。传统的统计实际上只有启动跟退出才可以收集数据,现在用户可以自定义事件,定义的事件就被触发后,相关的数据传回来了。

这里面的数据样本显示出的信息有很多,我细讲下。每个APP会有一个

ID

,是帮我们决定是哪个APP的,后面【友盟+】会有ID,这是【友盟+】自己来判断这个设备是哪个设备的,后面有

imei

,这个是Android上一个标准的设备标识符,是国际标准设备标识符,后面是

mac

地址。然后

utdid

,这个是阿里的一个ID,因为我们属于阿里集团,后面包括这是什么版本,比如这个是Android4.3的版本,这个APP本身是什么版本。再后面是一些

sessions

信息,就是说你这一段行为能够拿到什么数据,如果你定义比较复杂的事件这些事件的信息也会出来,这个是APP端。

WEB端,我们是JS的SDK,通过http或者https协议传数,这个

Referer

告诉你这个访问是从百度来的,到了友盟+这个网站,包括你的屏幕的维度,你用的语言,包括我们自己ID。

useragent

是告诉你这个浏览器是什么样的。在无线端我们是通过设备ID做唯一判断的。

在网站端我们最开始判断的不是一个设备,而是一个浏览器,

比如说你在PC上开了IE、Chrome、360,这对于我们来说可能是三个ID,但会有一些算法把这几个ID连起来,告诉你这可能是同一个电脑的,或者同一个人的,我们会有一些算法把它们打通。

原始数据需要深层的加工处理,做一些基础的分析

,第一步是用户行为数据,第二步是通过行为数据做特征提取,第三步会有一些知识体系、数据库,通过机器学习算法给消费者或者设备打上标签,这个标签是往后所有应用的基础数据,以后再使用就用第四步数据就好了,前面的这些做一次性处理就差不多了,第三步机器学习的模型我们会不断更新,来做更好的标签的生产。

标签会从各个维度判断这个设备背后的人

,第一类属于基础属性,我们要判断性别、年龄、消费水平,而这些判断都是基于模型,我们需要收集一些训练数据,有了这些训练数据以后,比如说性别,我们就会看男的跟女的在用APP行为上,在浏览网站行为上有什么不同,这实际上是一个二分类模型判断性别。像年龄段,这是一个多分类模型判断属于哪个年龄段。

下面要重点谈下训练模型这件事。

性别比较好说,要么是男要么是女,预测年龄虽然是一个多分类模型,但是在工业界里面很多场景里面大家用得更多是二分类,每一个年龄段做一个模型。但是二分类有一个问题,人不可能同时处于两个年龄段,所以就涉及到一个二分类模型结果的比较问题。现在很少有模型输出的是正确的概率,这意味着我做了两个模型,这两个模型的分数是不可比的。

比如说我做一个模型说我判断这个是一个桌子,另外一个模型判断说这是一个柜子,桌子模型说这个是桌子的可能性是0.6,柜子的模型说可能性是0.9,那么你说这就是个柜子吗?你不能这么说,因为0.9折换到概率以后可能比0.6的概率还要低,概率为什么会不同?第一,我们训练模型往往用得不是原始数据的比例,尤其是对于小的类目,对于小的类目来说,如果做一个随机采样做一个模型的话,有可能它的正样本特别少,我可能从它本身拿样本里的全量,剩下的可能拿出10%,这个的话模型看见的事实是,这个小类可能在我整体里面占了20%,不是它的可能占了80%,实际上真实世界这类可能只占2%,剩下的是98%,所以你这个模型做得再准也不可能得到正确的probability,没有正确的probability两个二分类模型是没法比的。

那么

这个怎么解决呢

?有比较粗暴的办法,就像一些兴趣标签,比如说兴趣偏好,一个人有多个兴趣没关系,一般出来一个模型只要这个分大于0.5就认为他对于这个有兴趣,那就好了,但是对于年龄段来说就没法这么做。这个你要怎么做呢?我们叫分数的校准,我拿出一些独立的数据,我用我的模型打一下分,我可以算出每一个分数段它实际的概率是多少,比如我算出0.9的时候,所有低于0.9的样本里面可能有10%真是这个样本,0.9就对应了概率是0.1,所以我们做了这个映射以后这个两个模型才有可比性。

这是我们树状的用户认知体系

,这里面分了几个大类,基本属性、社会属性、兴趣偏好、行为习惯、财富、汽车行业、金融行业、其他,这是一种方法,

是固定的标签体系

。但是现在很多时候我们用的叫场景标签,Google把人的一天24小时定义了60个场景,比如说,你刚刚起床的场景是怎样的,你一打开电视的场景是怎样的,需要判断的是你在这个场景情况下最容易被什么样的广告打动。现在的标签体系有很多自定义的或者说基于场景或需求的,所以我们现在做得一个

很重要的工作是把标签的生产自动化

,如果客户提给我们一个需求,我们可以根据你的需求迅速自动产生一个模型,这个模型能够输出标签。

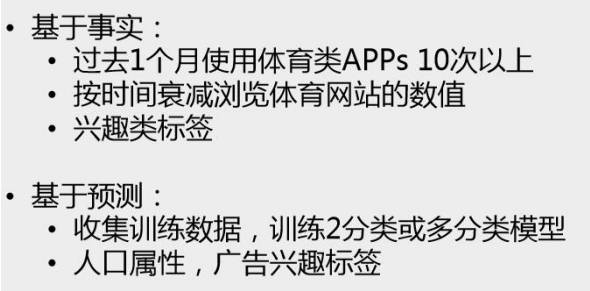

关于标签的生成方法,第一种标签的生成方法叫基于事实的

,我们在实际应用中经常用到。我给你一批客户,你告诉我里面哪些人过去一个月开启的这类APP十次,他只要知道这个,基于事实的好处是,它有事实在所以特别容易解释清楚。不好的一点是,它的reach比较小,所谓reach就是说我有多少人能够有这样的标签,按体育APP来说,同样200人,可能有50人最近两天开启了10次以上的体育APP,如果广告主要这个,给我一万块钱,我说这一万块钱只能投给这50人,你要想再投100人我没法投了,因为没有了。

但是如果是模型预测就没有问题了

,模型预测每个人都有对于体育兴趣的分,那就是根据你要的精准性,你说我要很精准,200人给你排名,排在第一的我认为是对体育最有兴趣的,排在最后的一个我认为是这200个人里最没兴趣的,但是他可能还是有一些兴趣的,

对于广告主来说他愿意触达多少人就能触达多少人

,只不过他要理解我的广度跟我的精准性的关系就好了。因为我们在兴趣后面会加一个分数,就是置信度,置信度广告主可以选,需要什么样的置信度。

下面

我要重点讲下“打通”的问题,首先让我们了解下数据打通的方法。

比如说体育类APP,我怎么知道这是个体育类APP?开发者当时整合SDK的时候,我们并没有方法验证你填得APP类别是不是你真正的APP类别,所以我们需要有一个模型通过APP的描述对APP做另外一个层次的判断,这个基本上就是一个自然语言处理的方式。

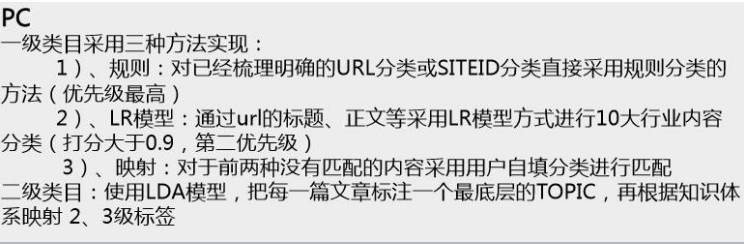

PC的相对来说复杂一点,第一个我们的数据量比较多,PC一旦知道你的URL的话我可以去爬,可以把你的网站都爬下来,可以用比较复杂的模型来做,但是

实现的时候也会用一些基于事实类的方法

。比如说第一个是规则,

我只要看它的URL规则就知道它是哪类的

,这一类把规则梳理一遍,就可以去判断。

第二个是用模型去判断,通过标题、正文等建一个模型做判断

,这个要求比较高,打分大于0.9的我们才认为它是这一类的。

第三个是映射

,我们会对前面没有匹配的按照用户自填的做一个映射。当然我们还有

LDA模型

会把每一篇的文章做成Topic去做下一个子目录的类别,这些小类可能是有一个LDA打标签,再去引申到后面使用者身上的兴趣标签。

其次,

我怎么知道多个设备属于同一个人

?这里有两种方式,第一种方式是用第一方强帐号的体系连接起来,如果你登录支付宝、淘宝、天猫,在不同的设备上登录了同一个帐号的话,我们是可以通过这个帐号把这些设备连起来,简单直接也有效。如果不具备这种强账号关系,我们也通过一个算法打通。如果两个设备经常在同一个IP地址出现的话很可能属于同一个人,我们可能用IP的信息再加上其他的信息把不同的设备连起来。这个效果还是不错的,我们做了一个最简单的只用IP的模型,我们这个模型的Precision跟Recall可以达到70%、70%,这个实际上已经是一个挺好的效果了。

以上是数据打通的算法的方式,下面我将介绍“跨屏打通人”。

现在数据体量这么大,维度这么高,实际上原来传统的所谓的PII,比如说你的手机号、身份证号码这些是识别这个人重要的ID,这些重要的ID已经变得不是那么重要了,即便我把这些ID剔除出去,我还是能够识别你,现在数据维度这么高,数据量这么大,比如说你有一个非常稀疏的矩阵,这个稀疏矩阵维度很高,如果你有两个矩阵里面在某几个维度上面有重合的话,你基本上有很高的自信心说这两个是同一个人的,这个是被人家做过的,当年Netflix有一个100万美元的悬赏帮忙他们增强推荐引擎的效果,有些科学家就拿了另外一个数据源跟Netflix的数据进行比较,把很多用户直接就给认出来了。

这个是通过跨屏以后,可以把所有的数据整合在一起重新打一个标签,这个标签就更准确,内容更丰富。这也是在行为数据里面非常关键的一点

,因为你数据连通越多,你能够提供的服务就越多,你的场景就越丰富,你对这个人了解的就越多。

这里我举一个实际案例。

中国普惠金融场景,它面向的很多的受众群体是没有足够多的数据来做风控的,大家知道对于一个金融公司风控是它的生命线,做不好风控这个公司没法做下去,但是做风控没有数据是很难做好风控的。中国实际上没有一个能够完整收集数据的公司,央行有3.5亿人的信用相关数据,但是不幸的是这3.5亿人跟普惠金融面向的群体重合度不高。比如学生也是普惠金融的使用者,你们一般还没有买房买车,没有这些借贷还款的记录,可能也没有信用卡的记录,所以这些人的数据是非常缺失的。

跟信用相关的数据最高层是征信的数据,就是你借款、还款的数据,这个是最直接相关的。如果说这个人有借还款的数据,我用它判断信用相对来说比较容易比较直接,也会比较准确。后面是消费数据,包括信用卡记录,包括你在淘宝上买东西的数据,再往后是运营商的数据,你的每月话费的信息,再往后是社交数据,再往下是行为数据。除了行为数据可能

还有一些其他杂七杂八的数据我就统一放在“其他”了。