作者:弗格森 文强 张易 刘小芹

【新智元导读】

18日凌晨,谷歌一年一度的开发者大会I/O拉开帷幕,其CEO Sundar Pichai发表主旨演讲。重磅发布了谷歌第二代TPU和

Cloud

TPU,被认为对英伟达构成较大威胁。新智元第一时间带来深度解读。本文还对凌晨谷歌新发布的9大产品进行了简要介绍,其中包括图像处理、机器学习平台、虚拟助理和智能家居的重大新功能、VR/AR等等。带你一文看懂昨晚的I/O大会首秀。

2017年5月18日凌晨,素有科技界四大春晚之一的谷歌开发者大会(I/O) 在加利福尼亚州的山景城开幕。

谷歌CEO Sundar Pichai 发表主旨演讲。以下是本场主旨演讲的一些亮点:

1.谷歌针对Siri的竞品——Google Assissaant 可直接在iPhone上使用;

2.谷歌在芯片上再放大招推云TPU;CNBC报道称,英伟达可能会为此感到害怕(Scare);

3.谷歌智能音箱Google Home新推四大功能,可直接用于语音通话,也可免费拨打手机;

4.谷歌照片(Google Photos)现在已经有超过5亿用户,新增加的人脸识别等技术可以让用户更智能地分享照片;

5.谷歌新推独立VR硬件(不需要手机),与联想和HTC合作;

6.手机上的TensorFlow:TensorFlow Lite很快开源。

Sundar 在演讲一开始便提到,谷歌在很多年前就开始布局的数据和机器学习,这让他们的产品现在有了超过10亿的用户量,另外,安卓的活跃用户已经超过20亿。

今年Sundar反复提及的主题依然是:从“手机为先”到“AI为先”。他说:“手机使我们重新想象我们正在进行的一切。我们必须从根本上重新想象我们正在做的一切,有了‘AI为先’,我们也是在做一样的事情。”

Pichai 的演讲不长,但信息量却很大——本届谷歌 I/O 大会现场有 7000 多人参加,在 400 多个国家直播。Pichai 还专门查询了去年谷歌 I/O 大会的评价和反馈——由于大会是在露天举办的——表示今年会免费提供防晒霜给各位参会者,赢得台下一篇掌声和笑声。

Pichia 说,跟所有的计算平台范式转换一样,从键盘鼠标到手指触控再到现在的语音交互,计算机在自然语言理解和处理方面的能力不断提高,即使在噪音环境中也能比较准确地识别说话人的命令,很自然地带出了 Google Home 的广告。

除了语音,视觉也是另一大重点。Pichai 现场展示了两个例子,一是图像去模糊,二是隔着铁丝网拍摄小女打垒球时,去除前景,也即铁丝网。Pichai 表示,计算机也正在逐步开始理解图像和视频的含义。

Sundar Pichai 2017年I/O大会上展示的第一款产品是谷歌 Lens,可以认为是一款智能相机,只要对着拍照对象,相机就能读懂画面上的事物,比如识别花的种类、翻译商店和菜品名称,或连Wifi。

震慑英伟达:第二代TPU和

Cloud

TPU 发布

Sundar 称,搜索无疑是从 Moblie-Frist 到 AI-First 的一大重点。去年,谷歌在 I/O 大会上宣布了其内部自己研发的 TPU——专为加速机器学习的第二阶段“推理”而专门设计的芯片。今年,Pichai 又用十分轻松的语气宣布了 TPU 的升级版——

Cloud

TPU 这一重磅消息。

尽管此前已经有各种讨论,谷歌会研发 TPU 第二代,但是谁也没有想到,升级版的 TPU 会以结合谷歌云的形式出现。这个名为 Cloud TPU 的产品将加速机器学习一系列广泛的工作量,最初是通过 Google Compute Engine 提供。

就在上周,GPU 巨头英伟达才揭幕了专门针对张量处理而升级的新款 GPU。现在,谷歌拿出了更大的一张底牌。过去几年,神经网络应用巨幅加快了谷歌的一系列 AI 产品,在谷歌搜索、谷歌翻译、谷歌相册,还有著名的“世纪大战”——AlphaGo 对弈李世石当中,表现优异,而初代 TPU 也成为其中不可或缺的英雄之一。

现在,仅仅加速推理的初代 TPU 已经不能满足谷歌的需求。神经网络的“训练”部分——也是对计算量需求最大最多最重要的部分,谷歌此前还是依赖市售的 CPU/GPU。而显然,这些也已经无法满足谷歌的需求。

现在,Pichai 在 2017 谷歌 I/O 大会宣布的第二代 TPU,既能够加速推理,也能够加速训练。

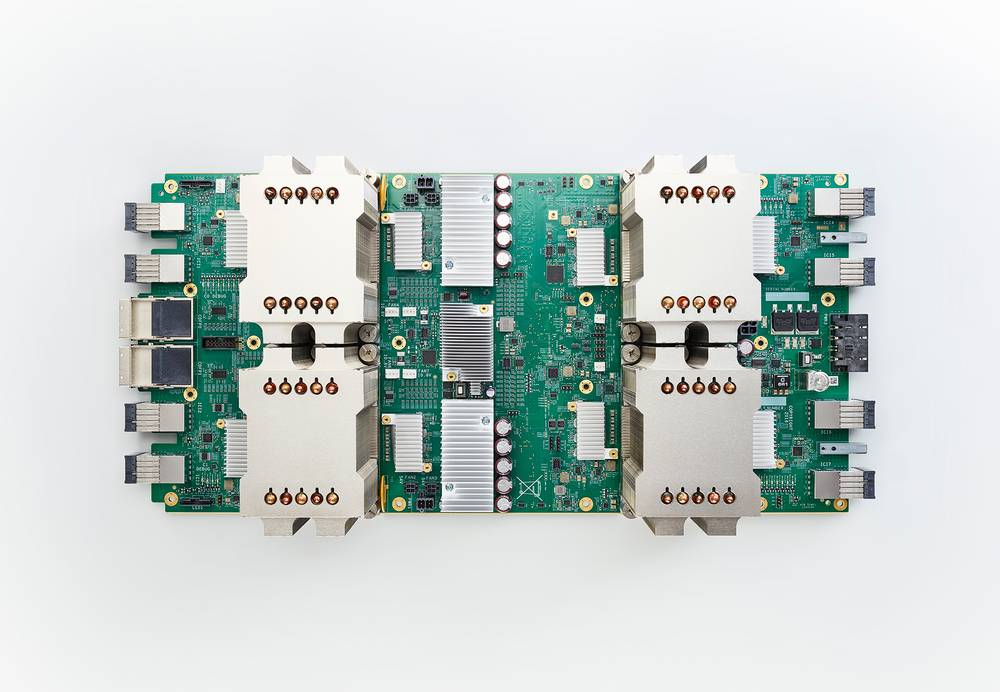

第二代 TPU 设备单个的性能就能提供高达 180 teraflops 的浮点计算量。不仅如此,谷歌还将这些升级版的 TPU 集成在一起成为

Cloud

TPU。每个 TPU 都包含了一个定制的高速网络,构成了一个谷歌称之为“TPU pod”的机器学习超级计算机。一个TPU pod 包含 64 个第二代TPU,最高可提供多达 11.5 petaflops,加速对单个大型机器学习模型的培训。

Pichai 还在演讲中表示,使用 TPU pods,谷歌已经大幅提升了训练神经网络的时间。谷歌的一个新的大型翻译模型,以前要 32 颗商业上最好的 GPU 花费一整天的时间来训练——现在,只需一个下午,8 个第二代 TPU 就能达到同样的训练精度。

依然奉行保密主义,升级版的 TPU 具体设计架构也用散热片挡住。

现在,第二代升级版 TPU 已经在谷歌数据中心部署使用——这不禁让人想起去年,谷歌也是在使用初代 TPU 一年多以后才公开宣布 TPU 的存在——每个“TPU pod”都包含了 64 个第二代 TPU,最高速度能达到 11.5 petaflops 的加速度。

谷歌将新的 TPU 引入云端,作为 Google Compute Engine 的一部分,将其称之为 Cloud TPU。你可以把这个 Cloud TPU 想象成一台超级计算机,能够连接其他类型的硬件(包括英特尔 Skylake CPU 和英伟达的 GPU)。显然,谷歌在这里仍然向英特尔和英伟达示好,表示不会抛开市售 CPU/GPU。

而 Cloud TPU 带来的最大好处,则是谷歌的开源机器学习框架 TensorFlow。TensorFlow 现在已经是 Github 最受欢迎的深度学习开源项目,可以想象,Cloud TPU 出现以后,开发人员和研究者使用高级 API 编程这些 TPU,这样就可以更轻松地在CPU、GPU 或 Cloud TPU 上训练机器学习模型,而且只需很少的代码更改。

此前,计算机体系结构宗师 David Patterson 宣布加入谷歌 TPU 团队,并且表示谷歌没有解散团队,看来就是在为研发第二代 TPU。

Sundar Pichai 在演讲中提到,谷歌将免费开放 1000 台 Cloud TPU 供开发者和研究人员使用,并且推出了 TensorFlow Research Cloud。地址:

https://www.tensorflow.org/tfrc/

相信,TensorFlow 作为开源机器学习/深度学习框架,其受欢迎程度又会有一个明显的提升。

作为谷歌云的主管之一,李飞飞在随后的开发者Keynote上也介绍了谷歌的新TPU。她说,打造 AI 专业技能,是一项重要的投资。我加入谷歌正是出于这一原因,希望能保证每一个人都能利用AI,来保持自己的竞争力, 来解决对自己来说重要的问题。

TPU只是其中的一部分。更多的是如何让计算整件事民主化。对于大多数人来说,谷歌云让这些难以获得的硬件资源变得可用了。

除了TPU,李飞飞还介绍了TensorFlow 研究云平台。下图有试用地址:

Sundar Pichai 在演讲中提到,谷歌将会把自己所有的AI相关事务集合到一个网站Google.AI 上。

他说,这一平台主要关注三件事:研究、工具和应用。

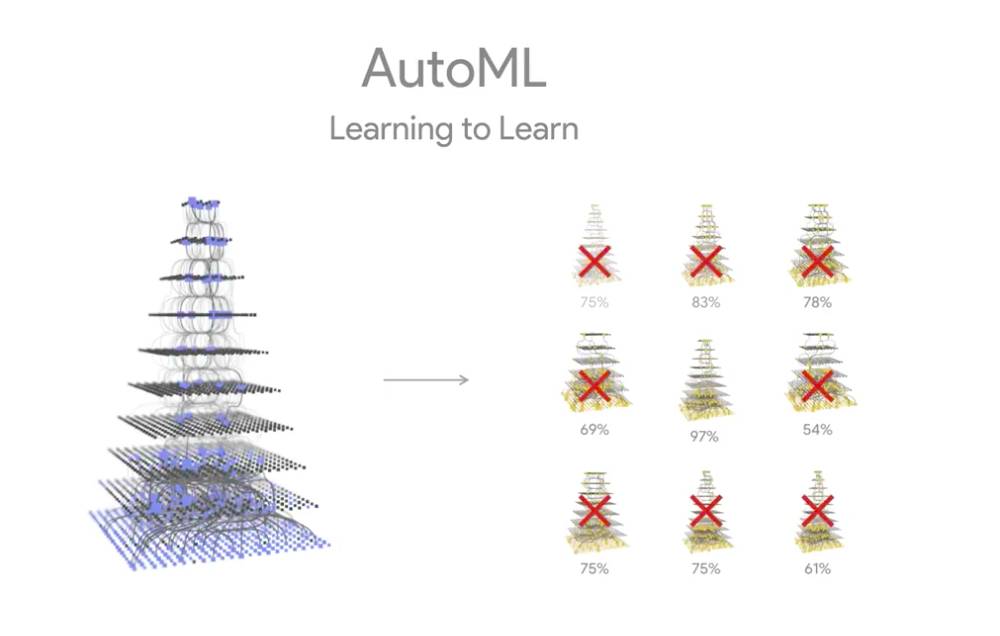

为了简化构建机器学习算法的概念,他们开发了 AutoML——一种能够帮助开发者构建自己的机器学习神经网络的模型,一种帮助机器“学习如何学习”的工具。

Google Assistant 可用于 iPhone

Google Assistant 很快可以在 iPhone 和 iPad 运行。Google Assistant 是谷歌在去年 I/O 大会首次公布的智能助理,此前仅能在 Google Home,Google Pixel 以及其他一些 Android 手机上使用。除了在苹果设备上可用外,谷歌还表示 Assistant 将加入多种不同语言,今年晚些时候起,可以使用法语,德语,巴西语,葡萄牙语以及日语。

Google Assistant 除了已有的回答你的问题,为你在网络上查找信息,以及帮助你完成例如任务等功能之外,本次 I/O 大会上,谷歌宣布了 Assistant 的更多功能:

对 Google Home 来说,Assistant 带来的最直接的变化是不需要用手控制,只需对它说一句“Ok Google”。以下是在 Home 使用 Google Assistant 的一些新功能:

此外,从今天开始,开发者能够为手机上的 Google Assistant 开发对话式 app。这意味着很快你就不仅能够在Google的产品上得到使用 Assistant,也可置入到其他的第三方服务。

Google Home 四大功能更新:可免费呼叫,推送视频信号

谷歌在 2016年 I / O 大会上首次推出了其智能家居设备 Google Home。 今年它更新了软件功能。 从美国开始,之后是英国(具体时间未定),

这一智能家居设备将能够发送得到许可的 App 的推送通知。

同时,Google Home 也加入了免提电话的功能,可以用语音直接拨叫。

拨叫将根据拨打电话人的语音个性化。

谷歌宣布 Google Home 将在美国和加拿大提供对手机或座机的免费呼叫服务。

这个功能有点儿像是亚马逊刚添加给 Echo 的——就是那个可以在 Alexa 设备中进行呼叫的功能——但这个确确实实是可以免费拨叫电话的。

谷歌说拨叫时将默认使用隐私号码,但如果你愿意,也可以将它改为你自己的号码。这一功能将在下月正式放出。