5月23日,人机大战第一局在浙江桐乡打响,几乎无悬念的是,柯洁输了。赛后柯洁表示,AlphaGo是太厉害了,我输得没什么脾气。

这场人机大战,令人工智能再次被世人所关注。鉴于读者们对人工智能或多或少都有些误解,今天笔者就和大家聊聊有关人工智能的话题。涉及的范围包括:人工智能发展现状、人脑与人工智能的“算法”、以及未来会对我们造成哪些影响。

什么是人工智能?99%人会认为,人工智能就是让机器拥有人的思想,这不是一个准确的定义。虽然近几年人工智能的定义被不断转变,但主流的观点认为,人工智能的定义是一种新的能以人类智能相似的方式做出反应的智能机器。有人说这和让机器拥有人类思想不是一个意思吗?请注意,以人类智能相似的方式做出反应不代表机器会有感情,这点我们下文会详细讲到。

业界通常把人工智能分为三个发展阶段:弱人工智能,强人工智能,超人工智能。

弱人工智能:专注于且只能解决特定领域问题的人工智能,今天我们看到的所有人工智能算法和应用都属于这个范畴,比如Siri和微软小娜,人们更愿意将弱人工智能看成是人类的工具,而不会将它视为威胁。

强人工智能:能够胜任人类大部分的工作,在大多数领域甚至达到取代人类50%以上的工作。

超人工智能:比世界上最聪明、最有天赋的人类还聪明的人工智能系统。

现阶段的人工智能,无论是会写诗、能一分钟写出一篇财经新闻稿的机器“文人”,还是棋艺纵横天下、能独立开车的特斯拉“老司机”,都还只属于弱人工智能范围,它们只能在某些方面超过人类。

AlphaGo也属于弱人工智能,因为它不会思考。AlphaGo的本质就是一个深度学习的神经网络,通过前沿算法和大量数据样本分析对手落子(策略网络)、计算胜率(评价网络)以及根据有限选项中计算最佳解的蒙地卡罗搜索树,也就是说,他是根据这三个函数来找出最佳动作,而不是真的理解了什么是围棋,什么是胜和败。

当然,AlphaGo虽然是一个下围棋的机器人,但是它也是目前最为前沿的人工智能技术。因为AlphaGo2.0版本已经不像此前一样需要人类棋谱,也就是说人类棋谱已经无法让AlphaGo2.0棋艺再次提高,现在的AlphaGo2.0的学习方式和一些网友调侃的一样:AlphaGo现在通过AlphaGo VS AlphaGo自我对抗的方式进行学习。通过自我对弈,将不同情况下的错误选择排除掉,让别人找不到自己的弱点。不过目前AlphaGo仍然无法自主学习,也就是说它需要人类教他们如何学习(通过算法)。

看到这儿,各位读者想必也明白人工智能现在的发展程度:无限接近100%也接近于0%。

上文中笔者曾多次提到“算法”,这个算法并不等同于我们的数学公式,但却有异曲同工之处。在《未来简史》中,尤瓦尔·赫拉利将人类和生物的行为描述为算法。

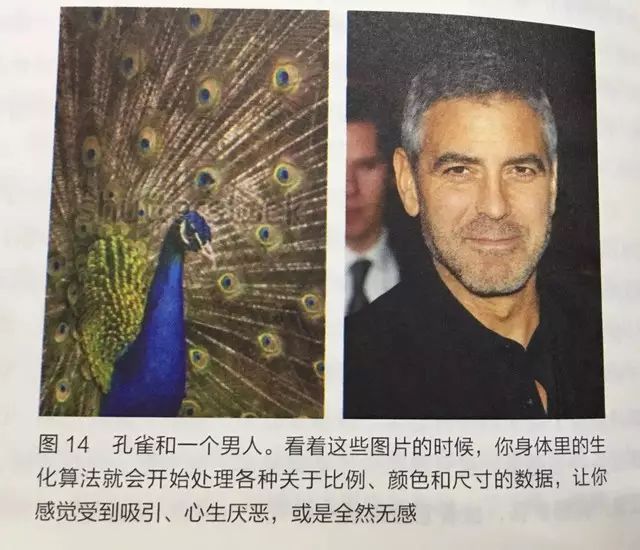

赫拉利认为的算法指的是进行计算、解决问题、做出决定的一套有条理的步骤。比如做饭炒菜的一系列步骤,比如茶道的一系列规矩。人脑中的悲伤、快乐、欲望其实都是生物演化的算法。当你看着下图时,你的身体里会迅速开始计算,身体比例、颜色、体内激素开始工作,这会让你感到愉悦或者是全然无感。这样的算法,是绝大多数生物都具备的,包括冷血动物,又或者是爬虫。

图片来自《未来简史》

通过人类的“例子”,想必大家已经了解了算法的必要性。无论是人脸识别、无人驾驶、还是语音识别等技术,它们都是通过算法实现的。

图片来自互联网

这里我们以人脸识别为例。一般来说,人脸识别系统包括图像摄取、人脸定位、图像预处理、以及人脸识别(身份确认或者身份查找)。系统输入一般是一张或者一系列含有未确定身份的人脸图像,以及人脸数据库中的若干已知身份的人脸图象或者相应的编码,而其输出则是一系列相似度得分,表明待识别的人脸的身份。听上去似乎很简单,但这却是一个极其复杂的算法。

需要注意的是,这一过程应是增量式且终生性的,即识别性能可随观察的增多而不断地提升,且像人类一样,在人工智能生命期内一直持续,只需将一个事先编译好的人脸识别算法装载在“机器人的大脑”中便可实现持续工作。但这种方式却只能应用在单一领域上。

问题就在于,人脸识别系统必须需要人类教它如何去学习更多样本,而不是自主学习样本。具备“通用智能(General Intelligence)”的人工智能,必须拥有自主学习的能力。人类只需要告诉机器,我想让你识别人脸,人工智能便可以迅速的开始学习如何识别人脸,如何进行图像摄取、人脸定位、图像预处理。

只有当这些行为是在自主学习的框架下获得的,并且具备前述增量学习和终生学习的特点,才算是强人工智能的一种体现。这也是为什么上文中笔者说人工智能就是让机器拥有人的思想是错误观念的原因,因为人工智能只需要算法,不需要思想。

关于人工智能是自主学习的逻辑,我们可以参考著名心理学家皮亚杰(J. Piaget)关于儿童认知发展的理论。

第一,完全自主性。我们完全做不到像对待机器人那样,对婴儿各关节赋以角度序列,使其完成某些动作;

第二,家长示教。尽管不能直接干预婴儿的运动行为,家长仍可通过间接辅教,协助婴儿完成特定的运动行为;

第三,主观模仿。无论是家长刻意重复特定运动行为过程,还是婴儿自己的主观观察,都更有助于婴儿获得该运动的行为能力;

第四,环境交互学习。婴儿获得的每一项特定运动行为能力,都是在与实际环境不断交互后才逐渐真正掌握的;

第五,试错模式。在与环境的不断交互过程中,婴儿总能根据环境的反馈对自身行为能力不断加以调节。

以上五点,也是现今人工智能算法的最大难题。当然,这是一个长久的目标,在人工智能领域,突破了0%,便是100%。

永生

拥有了超人工智能以后,我们可以立即解决人类现存的所以问题,比如能源紧缺、全球变暖、疾病、食物短缺等问题。甚至于我们关于世界经济和贸易的争论将不再必要,甚至我们对于哲学和道德的苦苦思考也会被轻易的解决。

最终,人类有可能达到永生。

以往自然演化没有理由让我们活得比现在更长。对于演化来说,只要我们能够活到能够生育后代,并且养育后代到能够自己保护自己的年纪,那就够了。衰老是存在我们基因中的物质,当我们的细胞不断的分裂不断的出错,我们的器官会变得越来越老。

而有了超人工智能,我们会开始重新设计身体,比如可以用自我驱动的纳米机器人代替血红细胞,甚至人工智能会帮我们改造自己的大脑,使得我们的思考速度比现在快亿万倍,并且使得大脑能和云存储的信息进行交流。

总之,无所不能。

灭亡

事实上,当超人工智能问世后,人类灭绝的机率更大。

早在2015年,霍金就提出了人工智能可能会成长到非常强大的程度,甚至可能在完全无意的情况下毁灭人类。“人工智能的真正威胁并不在于它们的恶意,而是它们所具有的能力,”霍金说,“一个超级聪明的人工智能在完成目标时具有极强的能力,而一旦这些目标与我们人类不一致,那我们就有麻烦了。”

你可能并不讨厌蚂蚁,但也会无意中踩死蚂蚁,而如果你负责一个水力发电的绿色能源项目,项目所在的区域内也可能会有许多蚂蚁巢穴被水淹没,对蚂蚁来说就非常不幸。我们要避免人类处于这些蚂蚁的境地。

我们可以举个例子,如果一个超人工智能的使命是保护环境,最终通过算法得知,必须毁灭人类才可以完成自己的任务。那时我们将没有任何可以阻挡它的力量。

有人说不是有阿西莫夫机器人三大定律吗?机器人不可以伤害人类吗?先不说本身机器人三大定律有一定漏洞,单是术语描述就无法实现,因为三大定律的描述太过我模糊,根本无法执行。

如果超人工智能能够达成,或许我们可以见证给予未来所有人类以生命,甚至是永生,我们也可能终结人类这个特殊的物种,连同人类所有的梦想、艺术、痕迹、以及无尽的发现和发明,一起走向灭绝。

“上帝早已在宇宙中划上了一道墙,光锥之内是命运。”