正文

来源:IJCAI-17

【新智元导读】

IJCAI 2021主席团队公布,南京大学教授周志华当选程序主席,成为IJCAI史上第一位华人大会程序主席。本届IJCAI,周志华教授率领的南大LAMDA共发表了 20篇论文,分布在机器学习、主动学习、NLP和数据挖掘等多个领域。其中,LAMDA成员、南大副教授俞扬博士参与

了6篇,都与优化方法有关。

俞扬博士也是本届IJCAI的宣传主席,同时主持了大会“机器学习姐妹会议”会场。俞扬博士解读了他们的工作,简单谈了本次IJCAI 参会的感受,他认为新型强化学习方法、学习系统与逻辑推理和领域知识的结合,也许能够带来一些意想不到的进展。

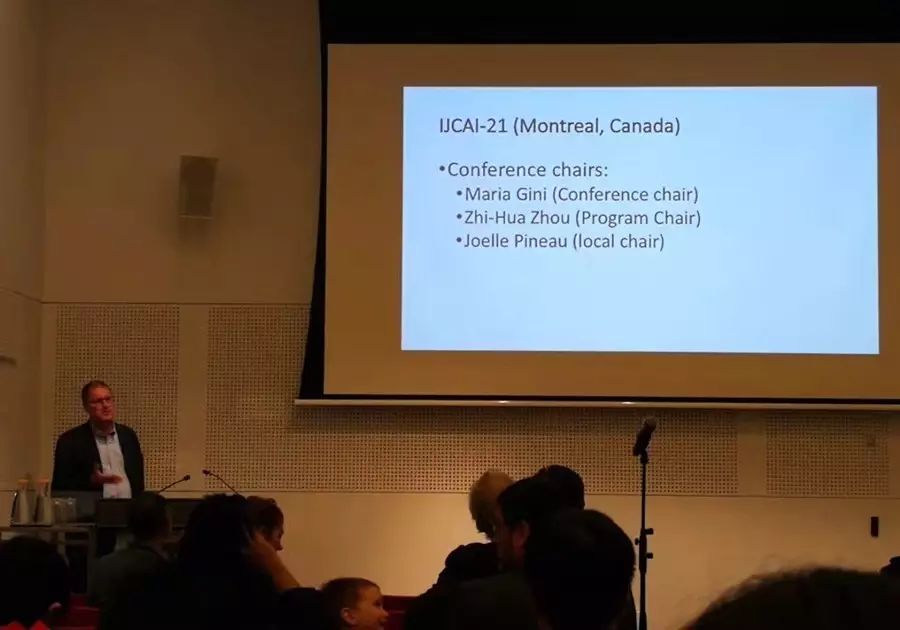

IJCAI(国际人工智能联合会议)是人工智能领域中最主要的学术会议之一。由于领域热度上涨,从2016年起,IJCAI从原来的每两年举办一次改为一年举办一次。同时,IJCAI大会的主席团队也提前4年公布。在刚刚结束的IJCAI 2017 Business Meeting上,IJCAI 2017理事会主席、牛津大学的Michael Wooldridge教授宣布了2021年的大会主席。

中国南京大学的周志华教授将担任IJCAI-21的程序主席。IJCAI-21的大会主席是美国明尼苏达大学的Maria Gini教授。

IJCAI-21将在加拿大的蒙特利尔举行,麦吉尔大学的Joelle Pineau教授将出任会议的当地主席(local chair)。

IJCAI 2021 主席团队公布,周志华当选程序主席

IJCAI现任理事会主席、牛津大学的Michael Wooldridge教授,宣布2021年的会议主席团队,南京大学周志华教授担任程序主席。

未来几届IJCAI的会议地址和主席如下:

2018年 IJCAI与ECAI的联合会议IJCAI-ECAI 2018,将于2018年8月在瑞典的斯德哥尔摩举行。以色列耶路撒冷希伯来大学的 Jeffrey Rosenschein教授将担任IJCAI-ECAI-18 大会主席。巴黎第九大学的Jerome Lang 教授将担任IJCAI-ECAI-18 程序主席。

2019年 IJCAI-19将在中国的澳门举行。

奥地利维也纳科技大学的 Thomas Eiter 教授将担任 IJCAI-19的大会主席。以色列巴伊兰大学的 Sarit Kraus 教授将担任 IJCAI-19的程序主席。

2020年 IJCAI-20将在日本的名古屋举行。美国马里兰大学的 Marie desJardins 教授,将担任IJCAI-PRICAI-20大会主席。法国蒙彼利埃大学的 Christian Bessiere 教授,将担任 IJCAI-PRICAI-20程序主席。

此外,IJCAI还迎来了一位新的理事会主席(President, Board of Trustees)——香港科技大学的杨强教授。杨强教授是IJCAI首位华人理事,也是IJCAI 2015的程序主席。

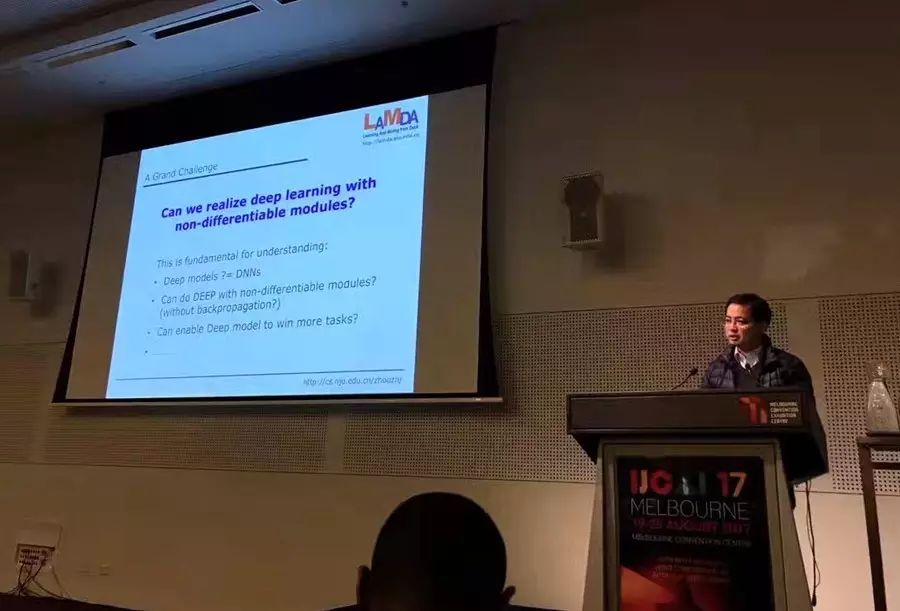

南大LAMDA发表20篇论文:周志华教授亲自做“深度森林”报告

IJCAI 2017,周志华教授率领的南京大学机器学习与数据挖掘研究所(LAMDA)共发表了20篇论文,分布在机器学习、主动学习、NLP和数据挖掘等多个领域。在机器学习领域中,又包括集成方法、特征选择和构建、多示例和多标签学习等多个方向。

之前引发热议的

“深度森林”论文

,周志华教授亲自做了报告,会场几乎坐满。杨强教授和德州扑克AI Libratus主要作者、CMU教授Tuomas Sandholm也到现场听了报告。

现在,深度学习几乎等于深度神经网络,但是,使用神经网络存在很多问题,比如调参困难、需要大量训练数据,还有“黑箱”存在带来的理论解析难点。为此,周志华教授和学生冯霁对深度神经网络以外的深度方法进行了探索,他们提出了“深度森林”——gcForest(multi-Grained Cascade forest,多粒度级联森林),展示了深度学习也完全可以有神经网络以外的方法。

深度森林在今年6月1日的时候开源,鼓励大家对这个方向进行更多的探索。

以下是本届IJCAI南大LAMDA发表的论文列表:

集成方法

特征选择和构建

-

H.-J. Ye, D.-C. Zhan, X.-M. Si, Y. Jiang. 学习马氏距离度量:将示例干扰纳入考量有好处(

Learning Mahalanobis Distance Metric: Considering Instance Disturbance Helps

)

-

Y. Zhang, Y. Jiang. 通过结构稀疏性进行多模态线性判别分析(

Multimodal Linear Discriminant Analysis via Structural Sparsity

)

多示例和多标签学习

-

W.-J. Zhou, Y. Yu, M.-L. Zhang. 用于多标签分类的二进制线性压缩(

Binary Linear Compression for Multi-label Classification

)

-

M. Xu and Z.-H. Zhou. 不完备的标签分布学习(

Incomplete label distribution learning

)

-

Y.-L. Zhang and Z.-H. Zhou. 关键示例漂移的多示例学习(

Multi-instance learning with key instance shift

)

-

W. Wang, X.-Y. Guo, S.-Y. Li, Y. Jiang, and Z.-H. Zhou. 通过区分众包中容易和难处理的个体,获得高质量的标签(

Obtaining high-quality label by distinguishing between easy and hard items in crowdsourcing

)

分类

-

Y. Yu, W.-Y. Qu, N. Li, Z. Guo. 基于生成对抗样本进行开放类别分类(

Open Category Classification by Adversarial Sample Generation

)

启发式搜索

-

C. Qian, J.-C. Shi, Y. Yu, K. Tang. 一般代价约束的子集选择优化(

On Subset Selection with General Cost Constraints

)

-

C. Qian, J.-C. Shi, Y. Yu, K. Tang, and Z.-H. Zhou. 单调函数比率优化(

Optimizing ratio of monotone set functions

)

半监督学习

-

X. Yan, L. Zhang, W.-J. Li. 半监督深度哈希与二部图(

Semi-Supervised Deep Hashing with a Bipartite Graph

)

-

B.-J. Hou, L. Zhang, and Z.-H. Zhou. 适应存储空间的未标记数据学习(

Storage fit learning with unlabeled data

)

无监督学习

-

X.-S. Wei, C.-L. Zhang, Y. Li, C.-W. Xie, J. Wu, C. Shen, and Z.-H. Zhou. 用于图像共定位的深度描述子转换(

Deep descriptor transforming for image co-localization

)

迁移、适应、多任务学习

-

Y. Yang, D.-C. Zhan, X.-Y. Guo, Y. Jiang. 基于模态一致性的预训练多模型重用(

Modal Consistency based Pre-trained Multi-Model Reuse

)

优化方法和工具(Solvers and Tools)

-

Y. Xiao, Z. Li, T. Yang, L. Zhang. 用于核标准正则化的不含SVD的凸凹方法(

SVD-free Convex-Concave Approaches for Nuclear Norm Regularization

)

主动学习

-

S.-J. Huang, J.-L. Chen, X. Mu, and Z.-H. Zhou. 基于多样化标记者的低成本主动学习(

Cost-effective active learning from diverse labelers

)

NLP应用与工具

-

J. Zhang, Y. Sun, S.-J. Huang, N. Cam-Tu, X. Wang, X.-Y. Dai, J. Chen, Y. Yu. AGRA:用于自动论文标题缩写的生成-分析-排名框架(

AGRA: An Analysis-Generation-Ranking Framework for Automatic Abbreviation from Paper Titles

)

数据挖掘和信息个人化

基于知识的软件工程

-

X. Huo, M. Li. 利用源码序列性质提升统一特征,定位缺陷文件(

Enhancing the Unified Features to Locate Buggy Files by Exploiting the Sequential Nature of Source Code

)

-

H.-H. Wei, M. Li. 利用源码词法和句法信息的监督深度特征,进行软件功能性克隆检测(

Supervised Deep Features for Software Functional Clone Detection Exploiting Lexical and Syntactical Information in Source Code

)

LAMDA成员、南京大学副教授俞扬博士参与了下面6篇论文的工作:

在现实世界的分类任务中,很难从环境中的所有可能类别收集到训练样本。当一个从未见过的类别出现在预测过程时,一个强大的分类器应该有能力说它没见过这个类,而不是将它分到任一已知的类当中。在这篇论文中,作者采用对抗学习(adversarial learning)的想法,提出开放类别分类(open-category classification)的对抗样本生成(ASG)框架。

在多标签分类任务中,标签通常是相互关联的,利用好标签间的关系对于多标签学习非常重要。在这篇论文中,作者揭示了映射到低维多标签回归问题可能比映射到分类问题更差,因为回归问题需要比分类问题有更复杂的模型。这篇论文提出了二进制线性压缩(BILC)方法,被证明优于一些state-of-the-art的方法。

一个人生命的不同阶段会造成行为模式的显著变化,在诸如在线购物等应用中,已经观察到用户的行为在很大程度上受到其所处阶段的影响。这篇论文试图对生命阶段进行建模并利用它,作者将这个系统应用到在线购物推荐,实验表明考虑客户的多元化可以提高推荐系统的效果。

这篇论文考虑最小化两个集合函数(set functions)的比例的问题,研究表明,使用合理时间的PORM具有与Greed Ratio相同的一般近似保证,但可以在案例和应用中实现更好的解决方案。

这篇论文探讨单调目标函数和单调成本约束的子集选择问题,放宽了前人研究的子模型属性。我们的研究表明,POMC可以获得与广义的贪心算法相同的一般近似保证,但可以在案例和应用中实现更好的解决方案。

这篇论文提出将命名任务视为一个人工智能问题,并在学术命名的范围创建一个数据集。作者提出一个三步的框架,包括描述分析,候选生成和缩写排名,每个框架都是参数化和可优化的。与在线或基线系统相比,该框架可以取得最佳结果。

作为IJCAI 2017的宣传主席,我们对俞扬博士进行了简单的采访。

新智元:您能简单谈一下这些工作吗?

俞扬:

这次我参与的论文看起来分散在不同的领域会场中,其实是与我们在优化方法上的长期研究有关系。

演化算法受一些自然现象的启发而来,但在不少复杂优化问题上有良好的表现,因此其中一定有一些有效的机制。过去十多年,我们对这些算法背后的机制开展了理论分析,近年在组合优化和连续空间优化问题上分别得到了一些结果。

在组合优化方面,我们证明了Pareto优化方法可以在多种问题上严格优于以往常用的贪婪方法,这次在启发式搜索会场上报告的两篇文章是关于这一方面的理论结果,以及在F-measure最大化、传感器放置、影响力最大化等问题上的实验结果。

在连续空间优化方面,我们对“采样-分类”优化框架的分析,发现了其在一定条件下对非凸、非连续、有多个局部极值的复杂连续函数能高效(多项式复杂度)逼近全局最优解,这样的优化工具为设计新颖的机器学习方法提供了更多的自由度;

在开放类别分类的工作中,我们基于该方法直接优化边界样本,得到了具有一定通用性的开放类别分类算法;

在多标记学习的工作中,该方法帮助我们把多标记投影到低维离散空间,从而使得低维空间可以使用分类模型而不是回归模型,模型的复杂度得以降低;

与南大计算机系NLP组合作,在缩写词生成的工作中,用该方法优化复杂的生成系统,大幅提高了生成缩写词的准确率。

目前我们还在基于该方法设计新型的强化学习算法,期望新的工作尽快能与大家见面。

基于这两类优化方法,我们最近做了Python的非梯度优化工具包(https://github.com/eyounx/ZOOpt),希望能够方便在更多的应用中使用。我的这些工作只是 LAMDA很多新工作中的一点,我很幸运在LAMDA研究组工作,能与周志华教授和多个机器学习方向的老师和同学交流。

新智元:作为本届大会宣传主席,您会负责哪些工作?

俞扬:

主要是负责宣传会议,让更多的人知道会议、投稿和参会。我非常幸运赶上人工智能上升潮,今年的投稿数、参会人数都比往几年多,也就轻松完成了任务😄

新智元:这次参加IJCAI 2017的感受如何,印象最深的是什么?有什么意外的亮点吗?

俞扬:

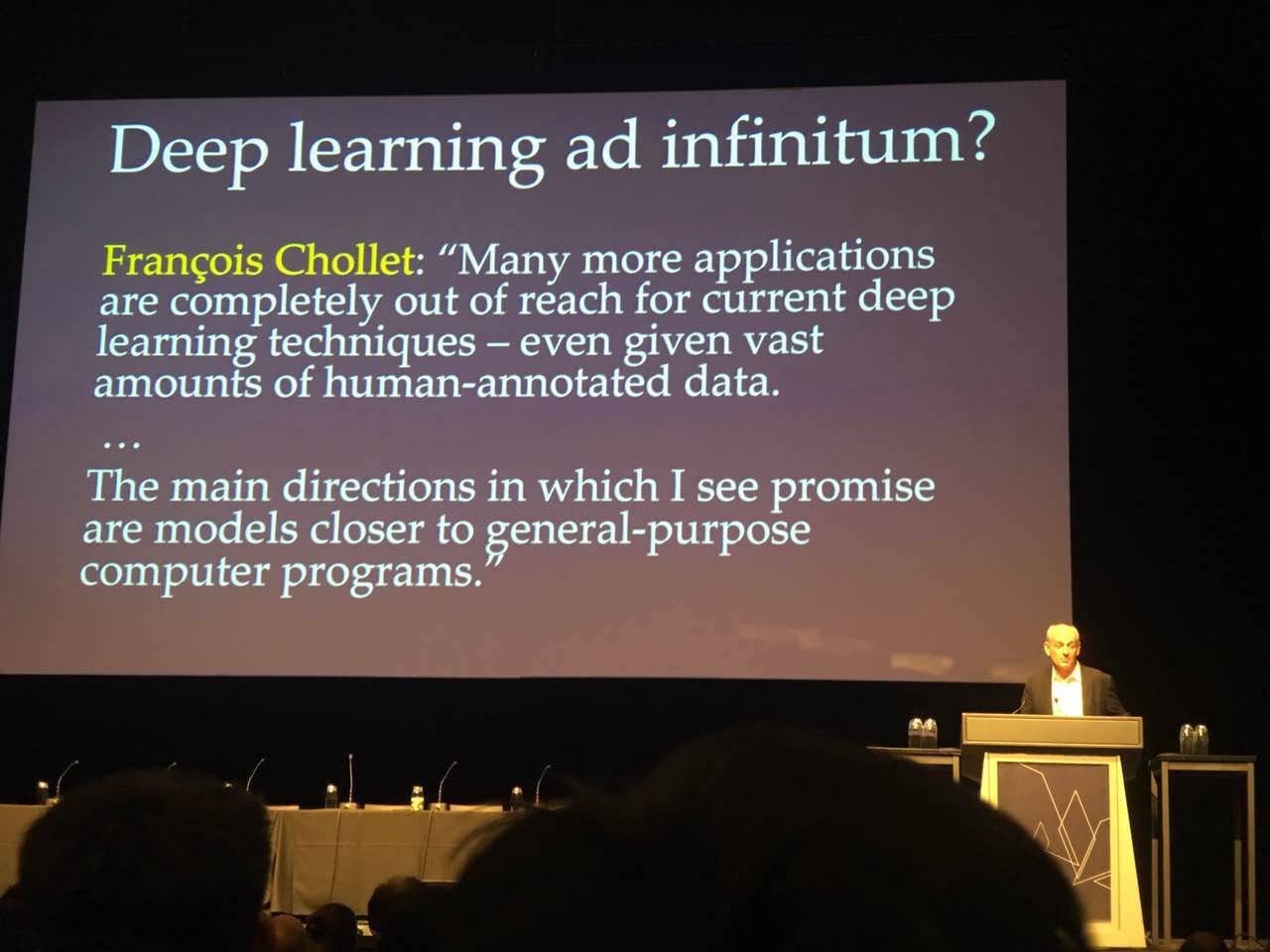

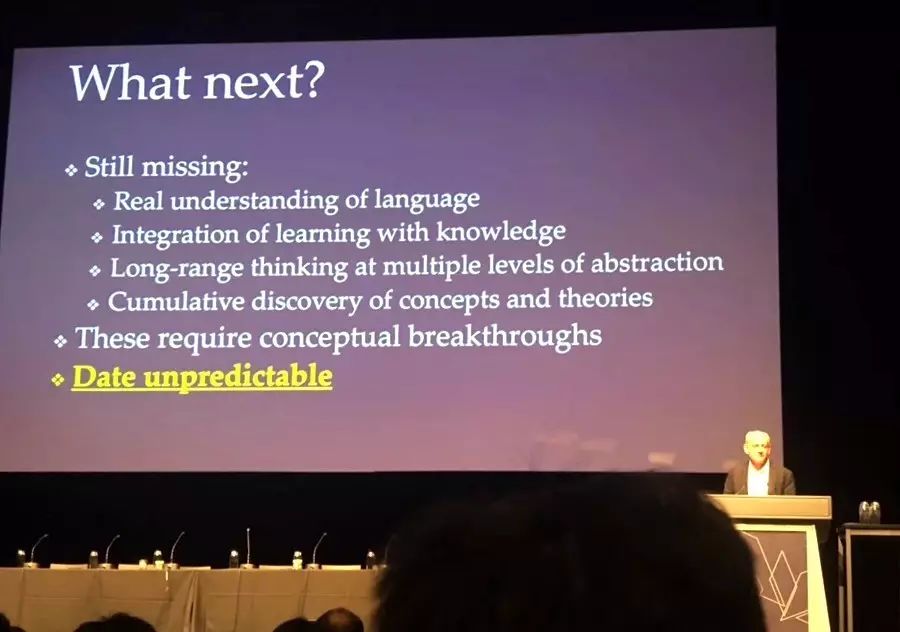

印象最深刻的一件事,是著名学者Stuart Russell的大会报告。

提到关于深度学习的现状时他评论道,算法的能力还有很多不足,“更多的CPU只能让你更快地得到错误答案”;他对“AI系统会愿意让人干预”给出了一个证明,很简单很有意思;另外他也指出关于AI未来的发展,强化学习是其中一项很重要的研究领域。

我主持的“机器学习姐妹会议”会场,是IJCAI的一个“福利”,报告的工作都是来自UAI、ICDM等会议的最佳论文和最佳学生论文,第一个报告介绍了Thompson采样应用到强化学习带来的渐进最优性,我听得入神都忘记计时了。

其他报告介绍了处理概念漂移的记忆方法、基于实例的推理新进展、开放世界推理数据库、深度学习参数服务器进展、异步Gibbs采样,涉及机器学习多个不同领域,非常精彩。

另外一个深刻印象是中国公司高度参与,不仅赞助会议,还组织了活动。我也有幸参加了腾讯、阿里巴巴和滴滴出行公司的活动。

新智元:这届会议有哪些研究和应用的热点,体现出了怎样的技术趋势(有新的趋势吗)?您认为这些热点和趋势将如何影响机器学习和数据挖掘研究社区?

俞扬:

IJCAI上我主要关注了AI大领域的进展,例如知识表达、逻辑推理、启发式搜索、博弈等目前似乎不是非常火的AI子领域,一方面是这些领域中最优秀的成果许多都会来IJCAI,另一方面这些领域的发展很有可能带来AI的下一个突破。目前我个人觉得新型强化学习方法、学习系统与逻辑推理和领域知识的结合,也许能够带来一些意想不到的进展。

【号外】

新智元正在进行新一轮招聘,

飞往智能宇宙的最美飞船,还有N个座位

点击阅读原文可查看职位详情,期待你的加入~