编者按:本周TensorFlow 1.0 正式发布;南大教授周志华当选AAAI 2019 程序主席,华人学者第一人; 雷锋网与MXNet作者李沐畅谈两小时;LipNet与ICLR评委互怼始末,谷歌工程师怼上Yann LeCun,AI科技评论帮你梳理最近学术界工业界“互怼”那些事儿。

TensorFlow 1.0 正式发布

本周,谷歌在山景城举办了第一届 TensorFlow 开发者峰会。作为大会的一部分,TensorFlow 1.0 的正式版本被发布出来。一起来看看它都有哪些新特性:

更快

它运算更快——TensorFlow 1.0 有十分惊人的速度。它快到什么程度呢?据谷歌表示,在使用八个 GPU 的情况下,TensorFlow 1.0 在 Inception v3 的测试中有 7.3 倍的速度提升。在 64 个分布式 GPU 集群上运行,Inception v3 的跑分增加了 58 倍。

不仅如此,XLA(Accelerated Linear Algebra,即加速线性代数) 还为未来进一步的性能提升打下了基础。TensorFlow 的官方网站 tensorflow.org,也上线了官方使用指南和秘诀,以帮助开发者对模型进行调参,达到最大的训练速度。另外,雷锋网获知,谷歌将发布针对几大主流模型的实践指导(更新版本),为如何最大化利用 TensorFlow 1.0 提供指导,相信不久之后就可以看到。

更灵活

它更加灵活—— TensorFlow 1.0 加入了新的高级别 API,还有 tf.layers, tf.metrics, and tf.losses 模块。非常关键的是,谷歌宣布 TensorFlow 1.0 内置了新的 tf.keras 模块——后者使得 TensorFlow 为 Keras 提供“完全”兼容支持。这在之前就传出过风声。作为一个在 ML 开发者当中广为流传的神经网络库,Keras 的加入无疑让 Tensorflow 的使用变得更加便利。

更稳定

更适合商业化使用——TensorFlow 加强了 Python API 的稳定性。这使得为它加入新特征变得更加容易,而不需要推翻已有的代码。

MXNet作者李沐:工业界追求“how”,学术界重在“why”

在旧金山参加 AAAI 期间,经余凯老师的引荐,雷锋网AI科技评论来到了位于 Palo Alto 的亚马逊AWS 办公室与李沐见了一面。

在 AAAI 的演讲中,Smola 拿 MXNet 的运行速度与其它开源平台做对比,而在谈话中李沐表示,自己并不愿意这样简单粗暴地做对比,他也告诉员工们,如果其它公司邀请你们做分享,一般不要做对比,只谈技术就好。

“我很理解大家爱看对比类的文章,但这是一个有偏见(biased)的做法。我们比别人快一两倍,不是我们想表达的东西,而为什么快,做了哪些优化,离我们的理想状态还有哪些差距,这样的总结可能对我来说更有价值一些。”

作为在工业界与学术界都待过的大牛,李沐虽然现在对于两个领域的研究侧重颇有心得,但在四年前,他在投递论文时也吃过不少亏,NIPS、IJCAI、JMLR、UAI、KDD连续被拒绝的他,心情非常郁闷。2013 年 8 月,他在微博上无奈地写道:

“今年往nips投了篇分布式优化的文章,自觉性能和通用性都可以beat掉度厂和谷歌的当家机器学习系统。结果收了满满6页的review 真是rebuttal不能啊,不报希望去nips普及大数据了。转身投system会议去了....”

后来回顾这段历程时,李沐感慨道:

“做产品和做学术研究是完全不同的东西。产品的导向是解决问题的 how,效果好、简单好用、通用性强、资源消耗低、便于实践,也就是东西要 work(应用)。不同公司的侧重点可能有些差异,比如百度对广告的精准性要求高一些,腾讯可能需要产品简单一些。而做学术研究时要写清楚的是 why,最重要的是想法(idea),第二点是洞察(insight), 也就是你能把这个事情做出深层的解释,再接下来才是结果好不好。”

他认为亚马逊看重的是“有与无”的问题,而不是“谁”的问题。

“亚马逊靠的是机器时间(machine hour)赚钱,而不是靠软件与平台。因此,做社区的目的主要是为了把用户量积累起来,而上面用的是什么开源平台,其实并不重要。”

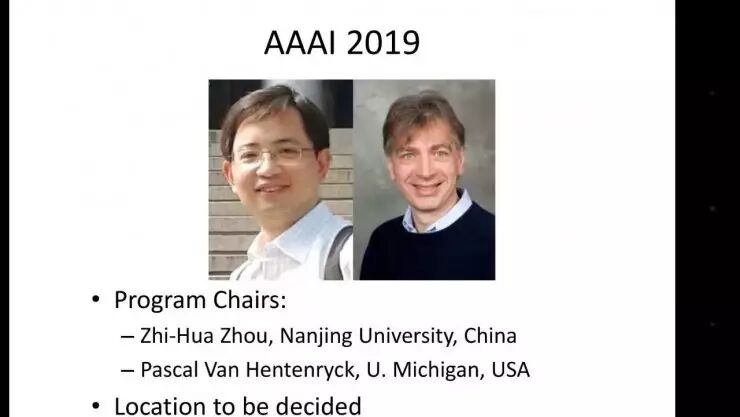

南大教授周志华当选AAAI 2019 程序主席,华人学者第一人

雷锋网从AAAI现任主席Subbarao Kambhampati处获悉了AAAI 2019的程序主席人选,一位是密歇根大学教授Pascal Van Hentenryck,另一位是我们很熟悉的、来自中国南京大学计算机系的教授周志华,其作为华人学者担任AAAI大会程序主席(Program Chair),这是AAAI创始以来第一次。周志华教授也成为了1980年AAAI大会创办以来欧美之外国家的学者担任AAAI大会程序主席的第一人。

周志华分别于1996年6月、1998年6月和2000年12月于南京大学计算机科学与技术系获学士、硕士和博士学位,学成后一直在南大执教。他曾在中国大陆取得所有学位,在海外最多只连续呆过两个月,是彻头彻尾的‘本土学者’。周志华教授是AAAI Fellow、 IEEE Fellow、 IAPR Fellow,2016年又新当选ACM Fellow、AAAS Fellow,涵盖了人工智能所有重要的学会,堪称人工智能会士“大满贯”得主。

最近几年,AAAI把国际化当成一个重要议题,越来越多来自美国之外的学者进入常务组织机构,而影响力日渐壮大的中国学者也会在AAAI里扮演更重要的角色。2016年,香港科技大学的杨强教授曾当选AAAI Councilor,是华人学者第一次进入AAAI执行委员会。

不可否认地,华人学者在大会中担任越来越重要的角色,除了AAAI本身国际化的需求,也是华人学者在AI领域的影响力日渐提升的结果。Subbarao Kambhampati最后向雷锋网透露,AAAI正在考虑2021年让AAAI会议走出北美,虽然尚未有定论,但组委会正在讨论深圳作为AAAI 2021主办地点的可能性。

LipNet与ICLR评委互怼始末

ICLR 2017 4 月份马上就要召开,OpenReview 的结果也陆续出来。既然是一项学术会议,自然就涉及到论文的录取与评审。其中,一篇早在去年就火遍各大媒体的论文遭到了拒绝,并引发了一场公开辩驳。

去年 11 月的一篇论文——《LipNet: End-to-End Sentence-level Lipreading》,由牛津大学人工智能实验室、谷歌 DeepMind 和加拿大高等研究院 (CIFAR) 联合发布,此文一出,很快便引来了众多的关注,第一及第二作者 Yannis Assael 和 Breandan Shilingford 也是采访不断。

论文火到什么程度呢?Nvidia CEO 黄仁勋在 CES 2017 上提及了他们与牛津大学的 LipNet 团队有合作,研发读唇深度学习网络模型的应用,并表示这一成果将应用于 Nvidia 的协同驾驶技术上。

然而这篇论文,在今年就遭遇了 ICLR 的无情拒绝。其中与评委争论得最为激烈的就是导师 Nando de Freitas,作为牛津大学机器学习教授,DeepMind 研究科学家,还是 CIFAR 的 Fellow,他直言评审的意见更新毫无价值,吐槽评审给出的修改意见简直是居高临下,站着说话不腰疼,完全是一派胡言!

而评审也是一点不手软,最后给出的结论依然是拒绝。主要有2点评审意见:

1. 评审们非常重视论文的创新度及研究意义。

2. 经过审阅,论文确实还没有达到入选 ICLR 的标准。“论文是一篇应用性论文,作者提出了第一个用机器学习实现端到端的语句层面唇读技术。”

最后又总结了一番:

此文的缺点在于,在研究深度学习的相关应用时,它并没有做出巨大的技术贡献,也没有提出任何超出目前应用领域的新见解。

论文里提及能将唇语的判别能力提升 10%,对于工业界也是一个很大的突破。不过,好的结果对工业界有用,但从研究的结果来说,不一定就与突破划上等号。就像李沐此前所提及的一样,工业界追求的是「how」,而学术界看重的是「why」,产品与研究的方向完全不同,前者追求效果,能做出东西来就是胜利,而后者更看重创新。

谷歌工程师怼上Yann LeCun:你对Google Brain的评价完全是错的

最近,Google Brain的研究工程师Eric Jang在Quora上回答了“IBM、谷歌、Facebook、苹果和微软等几家公司里,谁在领导着AI研究的发展?”(Who is leading in AI research among big players like IBM, Google, Facebook, Apple and Microsoft?)这一问题,短短时间便获得了超过4000的阅读量。之所以获得这么广泛的关注,一方面是因为Eric Jang犀利的行文风格,也因为他直接对原本Yann LeCun的回答做出了反驳。

Eric Jang把Deepmind排到第一位,Google Brain 、Facebook FAIR和OpenAI三者并列第二,百度和微软研究院并列第三、苹果第四、IBM位列第10位。他认为Deepmind很大程度上是如今的第一名,因为他们发表的工作成果受到研究圈的高度重视,而且都涉及到了非常顶级的议题,比如深度增强学习、贝叶斯神经网络、机器人学、迁移学习等;也因他们从牛津大学和剑桥大学吸收了大量人才。

对于之前Yann LeCun对Google Brain在研究领域的评价“但是谷歌主要关注与应用和产品开发,而不是长期的AI研究工作。”是错误的。他说道,Google Brain刚起步时的项目确实比较偏向工程,但是今天,Google Brain有很多员工都是专注于长期的AI研究 ,而且是涉及所有可能的AI次级领域,这跟Facebook FAIR和Deepmind是类似的。

Facebook FAIR有16篇论文被ICLR 2017大会接收,其中有3篇被选为做现场论文展示。而实际上,Google Brain被ICLR 2017大会接收的论文数量还略略超过Facebook FAIR,总共有20篇,其中4篇被选为做现场论文展示。而这并没有算上Deepmind和其它谷歌内部团队的工作(比如搜索、VR、图片)。论文接收数量并非一个很好的衡量尺度,但是他以此想反驳那些暗示Google Brain不善深度学习研究的暗示。