来源:全球人工智能

概要:

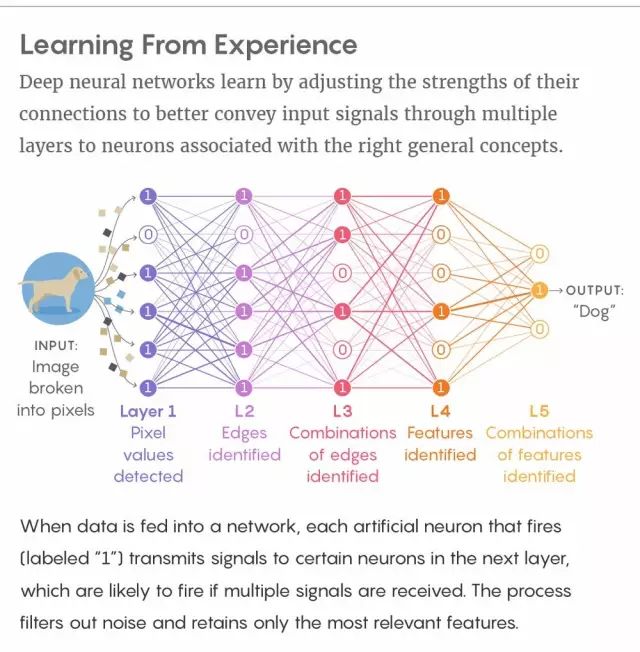

像大脑一样,深度神经网络也有很多层神经元。当神经元被激活时,它会发出信号,连接上面一层的神经元。

如今「深度神经网络」已经学会对话、驾驶汽车、打视频游戏、玩围棋、绘画并辅助科研,这使其人类构建者很是困惑,并为深度学习算法的成果深感意外。这些学习系统的设计并没有一条明确的原则,除了来自大脑神经元的灵感(其实并没有人知道大脑是如何工作的),并且 DNN 早就和大脑神经元的原理相去甚远。

像大脑一样,深度神经网络也有很多层神经元。当神经元被激活时,它会发出信号,连接上面一层的神经元。在深度学习的过程中,网络中的连接会根据需要被加强或减弱,从而让网络更好地根据输入(例如一张狗的照片的像素)发送信号,信号层层向上,经过所有相关的神经元,这些神经元都与“狗”这个概念的高层抽象有关。一个深度神经网络在“学习”过数以千计的狗的照片后,能像人一样准确地识别出从未见过的照片中的狗。

从具体个例到通用概念的飞跃,让深度神经网络拥有了如同人类在推理、创作时所展现出的“智能”。专业人员想知道,是什么赋予了神经网络泛化的能力,也想知道人类的大脑在多大程度上也在进行类似的活动。

近年来少有的干货演讲,Hinton说他要看上10000遍才懂

上月,在柏林举行的一场演讲为这一疑问提供了一个可能的回答,这场演讲的视频在人工智能研究人员间广为分享。

演讲中,希伯来大学的计算机科学家和神经学家Naftali Tishby,提出了一种解释深度学习工作原理的新理论,并给出了证据支撑。Tishby认为,深度神经网络根据一种被称为“信息瓶颈”(information bottleneck)的过程在学习,他和两位合作者最早在1999年对这一过程进行了纯理论方面的描述。

Naftali Tishby在柏林的演讲《深度学习:理论、算法和应用》,时长约58分钟。Hinton评价说,这是近年来少有的干货演讲

信息瓶颈理论认为,网络像把信息从一个瓶颈中挤压出去一般,去除掉那些含有无关细节的噪音输入数据,只保留与通用概念(general concept)最相关的特征。Tishby和他的学生Ravid Shwartz-Ziv的最新实验,展示了深度学习过程中这种“挤压”是如何发生的(至少在他们所研究的案例里)。

Tishby的发现在AI研究圈激起了强烈的反向。Google Researc的Alex Alemi说:“我认为信息瓶颈的想法可能在未来深度神经网络的研究中非常重要。”Alemi已经开发了新的近似方法,在大规模深度神经网络中应用信息瓶颈分析。Alemi说,信息瓶颈可能“不仅能够用于理解为什么神经网络有用,也是用于构建新目标和新网络架构的理论工具”。

另外一些研究人员则持怀疑态度,认为信息瓶颈理论不能完全解释深学习的成功。但是,纽约大学的粒子物理学家Kyle Cranmer——他使用机器学习来分析大型强子对撞机的粒子碰撞——表示,一种通用的学习原理(a general principle of learning),“听上去有些道理”。

深度学习先驱Geoffrey Hinton在看完Tishby的柏林演讲后发电子邮件给Tishby。“这简直太有趣了,”Hinton写道:“我还得听上10,000次才能真正理解它,但如今听一个演讲,里面有真正原创的想法,而且可能解决重大的问题,真是非常罕见了。”

Tishby认为,信息瓶颈是学习的一个基本原则,无论是算法也好,苍蝇也罢,任何有意识的存在或突发行为的物理学计算,大家最期待的答案——“学习最重要的部分实际上是忘记”。

利用信息论,我们能够精确定义“相关性”

Tishby很早便开始考虑信息瓶颈的问题,那时候其他研究人员也才刚刚开始酝酿深度神经网络,尽管当时无论是信息瓶颈还是深度神经网络都还没有得名。那是20世纪80年代,Tishby在思考人类是如何做语音识别的——语音识别是当时AI的一个重大挑战。Tishby意识到,问题的关键是相关性:说出来的一个词最相关的特征是什么,我们又该如何从重音、语调、模糊音等变量中将这个特征计算出来?在通常情况下,当我们面对现实生活中汪洋大海般的数据时,哪些信号是我们会保留下来的?

“相关信息(relevant information)的概念在历史上提到了许多次,但从来没有被正确地形式化,”Tishby在上个月接受采访时说:“多年来,人们认为信息论不是考虑相关性的正确方式,这个误解可以一直追溯到香农本人。”

克劳德·香农,信息论的创始人,从某种程度上说,是香农解放了人类对信息的研究,让信息能够以抽象的0、1形式和纯粹的数学意义被研究。正如Tishby所说的那样,香农认为“信息并非关乎语义”。但是,Tishby认为,这是不正确的。

Tishby意识到,利用信息论,“你能精确定义‘相关’(relevant)”。

希伯来大学计算机科学家和神经学家Naftali Tishby

假设X是一个复杂的数据集,就像一张狗的照片的像素,而Y是这些数据代表的一个更为简单的变量,比如单词“狗”。你可以任意压缩X而不丢失预测Y的能力,将X中所有与Y“相关”的信息捕获下来。在他们1999年的论文中,Tishby和他的共同作者,Fernando Pereira(现在在谷歌)和William Bialek(现在在普林斯顿大学),将这一过程转换成一个数学优化问题并且提出了数学公式。这是一个没有杀手级应用的核心基础概念。

“我沿着这条路在各种不同的情景中思考了30年,”Tishby说:“我唯一的运气就是深度神经网络变得如此重要。”

深度学习与物理重整化是完全相同的过程

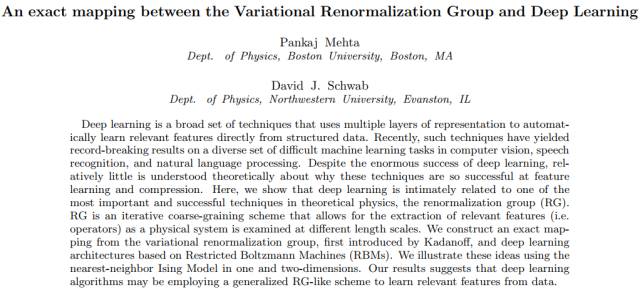

深度神经网络背后的概念已经存在了几十年,但它们在语音和图像识别任务中的表现在最近几年才开始起飞,得益于改进了训练方案和更强大的计算机处理器。Tishby在读了物理学家David Schwab和Pankaj Mehta在2014年发表的一篇论文后,开始注意到深度学习与信息瓶颈理论的关联。

David Schwab和Pankaj Mehta两人发现,Hinton发明的“深度信念网络”(DBN),在一种特定的情况下,酷似物理学中的重整化(renormalization),也就是以粗粒度的方式获取物理系统的细节,从而计算其整体状态。当Schwab和Mehta将深度信念网络应用于一个处于“临界点”的磁力模型时(这时该系统是分形,在任意尺度都自相似),他们发现,网络会自动使用重整化般的过程来发现模型的状态。

这一发现令人震惊,正如生物物理学家Ilya Nemenman当时评论所说的那样,它表明了“在统计物理的背景下提取相关特征和在深度学习的背景下提取相关特征并不只是类似,而是完完全全的同一个。”

物理学家David Schwab和Pankaj Mehta在2014年的论文,证明在特定情况下深度学习等同于物理中的重整化技术,这让Tishby注意到信息瓶颈理论与深度学习之间的关联

唯一的问题是,在一般情况下,现实世界并不是分形。Cranmer说:“我不会说[重整化步骤]就是深度学习在处理自然图像时效果这么好的原因。”

但Tishby——他当时正在接受胰腺癌化疗——意识到,无论是粗粒度过程还是深度学习,都可以被一个更广泛通用的想法所涵盖。“对科学和对我以前想法的思考是我的治疗和康复的重要组成部分,”Tishby说。