如果你仔细观察,就不难发现,懂爬虫、学习爬虫的人越来越多,一方面,互联网可以获取的数据越来越多,另一方面,像 Python这样的编程语言提供越来越多的优秀工具,让爬虫变得简单、容易上手。

利用爬虫我们可以获取大量的价值数据,从而获得感性认识中不能得到的信息,比如:

1.爬取数据,进行市场调研和商业分析

知乎:

爬取优质答案,为你筛选出各话题下最优质的内容。

淘宝、京东:

抓取商品、评论及销量数据,对各种商品及用户的消费场景进行分析。

安居客、链家

:

抓取房产买卖及租售信息,分析房价变化趋势、做不同区域的房价分析。

拉勾网、智联:

爬取各类职位信息,分析各行业人才需求情况及薪资水平。

雪球网:

抓取雪球高回报用户的行为,对股票进行分析和预测。

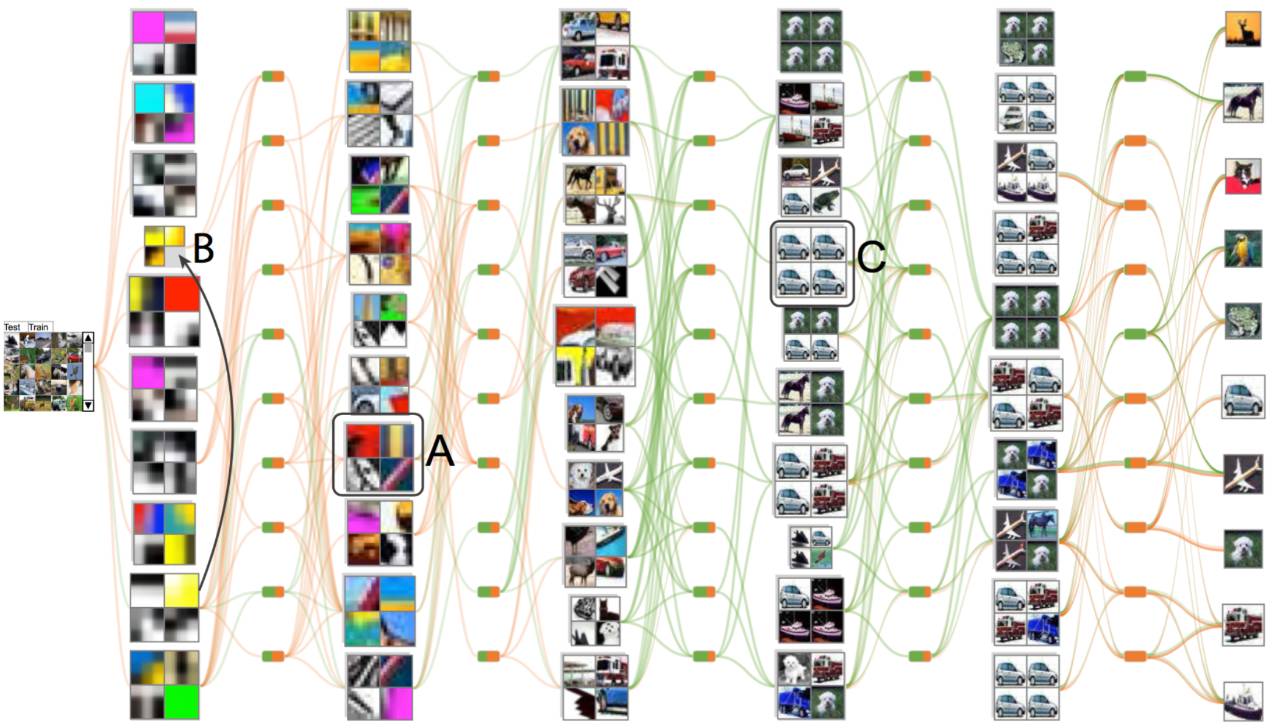

2.作为机器学习、数据挖掘的原始数据

比如你要做一个推荐系统,那么你可以去爬取更多维度的数据,做出更好的模型。

比如你要做图像识别,你可以先去爬取大量的图片作为训练集进行训练。

3.爬取优质的资源:图片、文本、视频

爬取知乎钓鱼贴\图片网站,获得福利图片。

爬取微信公众号文章,分析新媒体内容运营策略。

这些事情,原本我们也是可以手动完成的,但如果是单纯地复制粘贴,非常耗费时间,比如你想获取100万行的数据,大约需忘寝废食重复工作两年。

而爬虫可以在一天之内帮你完成,而且完全不需要任何干预。

对于小白来说,爬虫可能是一件非常复杂、技术门槛很高的事情。比如有的人认为学爬虫必须精通 Python,然后

哼哧哼哧系统学习 Python 的每个知识点,很久之后发现仍然爬不了数据

;有的人则认为先要掌握网页的知识,遂

开始 HTML\CSS,结果入了前端的坑

,瘁……

但掌握正确的方法,在短时间内做到能够爬取主流网站的数据,其实非常容易实现。但建议你从

一开始就要有一个具体的目标

,你要爬取哪个网站的哪些数据,达到什么量级。

在目标的驱动下,你的学习才会更加精准和高效。

那些所有你认为必须的前置知识,都是可以在完成目标的过程中学到的。

这里给你一条平滑的、零基础快速入门的学习路径。

1.了解爬虫的基本原理及过程

2.Requests+Xpath 实现通用爬虫套路

3.了解非结构化数据的存储

4.学习scrapy,搭建工程化爬虫

5.学习数据库知识,应对大规模数据存储与提取

6.掌握各种技巧,应对特殊网站的反爬措施

7.分布式爬虫,实现大规模并发采集,提升效率

- ❶ -

了解爬虫的基本原理及过程

大部分爬虫都是按

“发送请求——获得页面——解析页面——抽取并储存内容”

这样的流程来进行,这其实也是模拟了我们使用浏览器获取网页信息的过程。

简单来说,我们向服务器发送请求后,会得到返回的页面,通过解析页面之后,我们可以抽取我们想要的那部分信息,并存储在指定的文档或数据库中。

在这部分你可以简单了解

HTTP 协议及网页基础知识,比如 POST\GET、HTML、CSS、JS

,简单了解即可,不需要系统学习。

- ❷ -

学习 Python 包并实现基本的爬虫过程

Python中爬虫相关的包很多:urllib、requests、bs4、scrapy、pyspider 等,

建议你从requests+Xpath 开始

,requests 负责连接网站,返回网页,Xpath 用于解析网页,便于抽取数据。

如果你用过 BeautifulSoup,会发现 Xpath 要省事不少,一层一层检查元素代码的工作,全都省略了。掌握之后,你会发现爬虫的基本套路都差不多,

一般的静态网站根本不在话下,小猪、豆瓣、糗事百科、腾讯新闻等基本上都可以上手了

。

当然如果你需要爬取异步加载的网站,可以学习浏览器

抓包分析真实请求或者学习Selenium来实现自动化,这样,知乎、时光网、猫途鹰这些动态的网站也基本没问题了

。

这个过程中你还需要了解一些Python的基础知识:

文件读写操作:

用来读取参数、保存爬下来的内容

list(列表)、dict(字典):

用来序列化爬取的数据

条件判断(if/else):

解决爬虫中的判断是否执行

循环和迭代(for ……while):

用来循环爬虫步骤

- ❸ -

了解非结构化数据的存储

爬回来的数据可以直接用文档形式存在本地,也可以存入数据库中。

开始数据量不大的时候,你可以直接

通过 Python 的语法或 pandas 的方法将数据存为csv这样的文件

。

当然你可能发现爬回来的数据并不是干净的,可能会有缺失、错误等等,你还需要对数据进行清洗,可以

学习 pandas 包的基本用法来做数据的预处理

,得到更干净的数据。

- ❹ -

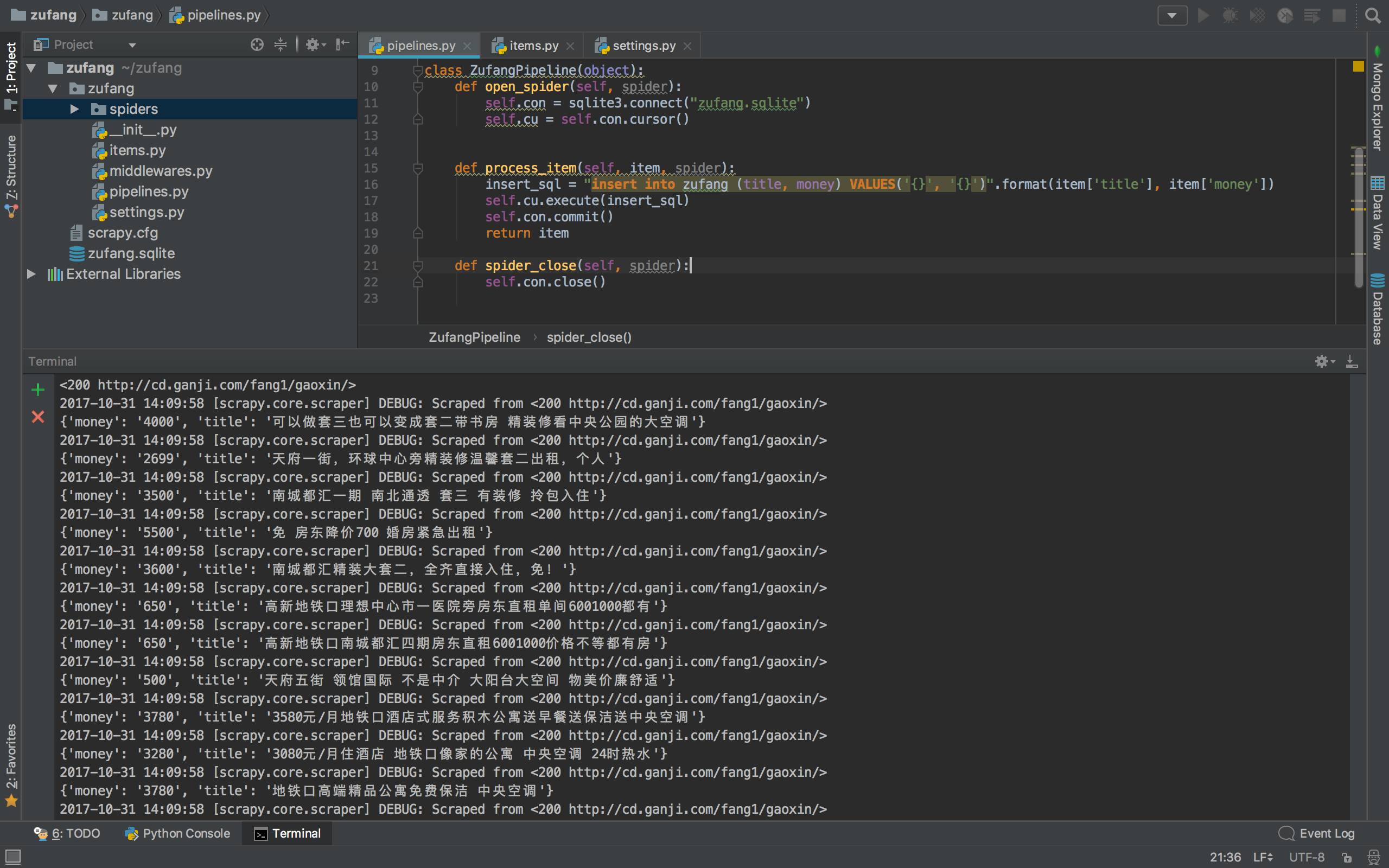

学习 scrapy,搭建工程化的爬虫

掌握前面的技术一般量级的数据和代码基本没有问题了,但是在遇到非常复杂的情况,可能仍然会力不从心,这个时候,强大的 scrapy 框架就非常有用了。

scrapy 是一个功能非常强大的爬虫框架,它不仅能便捷地构建request,还有强大的 selector 能够方便地解析 response,然而它最让人惊喜的还是它超高的性能,让你可以将爬虫工程化、模块化。

学会 scrapy,你可以自己去搭建一些爬虫框架,你就基本具备爬虫工程师的思维了。

- ❺ -

学习数据库基础,应对大规模数据存储

爬回来的数据量小的时候,你可以用文档的形式来存储,一旦数据量大了,这就有点行不通了。所以掌握一种数据库是必须的,学习目前比较主流的 MongoDB 就OK。

MongoDB 可以方便你去存储一些非结构化的数据

,比如各种评论的文本,图片的链接等等。

你也可以利用PyMongo,更方便地在Python中操作MongoDB。

因为这里要用到的数据库知识其实非常简单,主要是

数据如何入库、如何进行提取

,在需要的时候再学习就行。

- ❻ -

掌握各种技巧,应对特殊网站的反爬措施

当然,爬虫过程中也会经历一些绝望啊,比如被网站封IP、比如各种奇怪的验证码、userAgent访问限制、各种动态加载等等。

遇到这些反爬虫的手段,当然还需要一些高级的技巧来应对,常规的比如

访问频率控制、使用代理IP池、抓包、验证码的OCR处理等等

。

往往网站在高效开发和反爬虫之间会偏向前者,这也为爬虫提供了空间,

掌握这些应对反爬虫的技巧,绝大部分的网站已经难不到你了

。

- ❼ -

分布式爬虫,实现大规模并发采集

爬取基本数据已经不是问题了,你的瓶颈会集中到爬取海量数据的效率。这个时候,相信你会很自然地接触到一个很厉害的名字:

分布式爬虫

。

分布式这个东西,听起来很恐怖,

但其实就是利用多线程的原理让多个爬虫同时工作

,需要你掌握 Scrapy + MongoDB + Redis 这三种工具

。

Scrapy 前面我们说过了,用于做基本的页面爬取,MongoDB 用于存储爬取的数据,Redis 则用来存储要爬取的网页队列,也就是任务队列。

所以有些东西看起来很吓人,但其实分解开来,也不过如此。当你能够写分布式的爬虫的时候,那么你可以去尝试打造一些基本的爬虫架构了,实现一些更加自动化的数据获取。

你看,这一条学习路径下来,你已然可以成为老司机了,非常的顺畅。所以在一开始的时候,

尽量不要系统地去啃一些东西,找一个实际的项目(开始可以从豆瓣、小猪这种简单的入手),直接开始就好

。

因为爬虫这种技术,既不需要你系统地精通一门语言,也不需要多么高深的数据库技术,

高效的姿势就是从实际的项目中去学习这些零散的知识点,你能保证每次学到的都是最需要的那部分。

当然唯一麻烦的是,在具体的问题中,如何找到具体需要的那部分学习资源、如何筛选和甄别,是很多初学者面临的一个大问题。

不过不用担心,我们准备了一门非常系统的爬虫课程,除了为你提供一条清晰、无痛的学习路径,我们甄选了

最实用的学习资源

以及

庞大的主流爬虫案例库

。短时间的学习,你就能够很好地掌握爬虫这个技能,获取你想得到的数据。

-

数据玩家 · 粉丝专享福利

-

¥299(原价¥399),限额300名

- 课程大纲 -

Python爬虫:入门+进阶

第一章:Python 爬虫入门

1

、什么是爬虫

网址构成和翻页机制

网页源码结构及网页请求过程

爬虫的应用及基本原理

2、初识Python爬虫

Python

爬虫环境搭建

创建第一个爬虫:爬取百度首页

爬虫三步骤:获取数据、解析数据、保存数据

3、使用Requests爬取豆瓣短评

Requests

的安装和基本用法

用

Requests

爬取豆瓣短评信息

一定要知道的爬虫协议

4、使用Xpath解析豆瓣短评

解析神器

Xpath

的安装及介绍

Xpath

的使用:浏览器复制和手写

实战:用

Xpath

解析豆瓣短评信息

5、使用pandas保存豆瓣短评数据

pandas

的基本用法介绍

pandas

文件保存、数据处理

实战:使用

pandas

保存豆瓣短评数据

6、浏览器抓包及headers设置(案例一:爬取知乎)

爬虫的一般思路:抓取、解析、存储

浏览器抓包获取

Ajax

加载的数据

设置

headers

突破反爬虫限制

实战:爬取知乎用户数据

7、数据入库之MongoDB(案例二:爬取拉勾)

MongoDB

及

RoboMongo

的安装和使用

设置等待时间和修改信息头

实战:爬取拉勾职位数据

将数据存储在

MongoDB

中

补充实战:爬取微博移动端数据

8、Selenium爬取动态网页(案例三:爬取淘宝)

动态网页爬取神器

Selenium

搭建与使用

分析淘宝商品页面动态信息

实战:用

Selenium

爬取淘宝网页信息

第二章:

Python

爬虫之

Scrapy

框架

1、

爬虫工程化及

Scrapy

框架初窥

html

、

css

、

js

、数据库、

http

协议、前后台联动

爬虫进阶的工作流程

Scrapy

组件:引擎、调度器、下载中间件、项目管道等

常用的爬虫工具:各种数据库、抓包工具等

2、Scrapy安装及基本使用

Scrapy

安装

Scrapy

的基本方法和属性

开始第一个

Scrapy

项目

3、Scrapy选择器的用法

常用选择器:

css

、

xpath

、

re

、

pyquery

css

的使用方法

xpath

的使用方法

re

的使用方法

pyquery

的使用方法

4、Scrapy的项目管道

Item Pipeline

的介绍和作用

Item Pipeline

的主要函数

实战举例:将数据写入文件

实战举例:在管道里过滤数据

5、Scrapy的中间件

下载中间件和蜘蛛中间件

下载中间件的三大函数

系统默认提供的中间件

6、Scrapy的Request和Response详解

Request

对象基础参数和高级参数

Request

对象方法

Response

对象参数和方法

Response

对象方法的综合利用详解

第三章:

Python

爬虫进阶操作

1、

网络进阶之谷歌浏览器抓包分析

http

请求详细分析

网络面板结构

过滤请求的关键字方法

复制、保存和清除网络信息

查看资源发起者和依赖关系

2、数据入库之去重与数据库

数据去重

数据入库

MongoDB

第四章:分布式爬虫及实训项目

1、大规模并发采集——分布式爬虫的编写

分布式爬虫介绍

Scrapy

分布式爬取原理

Scrapy-Redis

的使用

Scrapy

分布式部署详解

2、实训项目(一)——58同城二手房监控

3、实训项目(二)——去哪儿网模拟登陆

4、实训项目(三)——京东商品数据抓取

- 高效的学习路径 -

一上来就讲理论、语法、编程语言是非常不合理的,我们会

直接从具体的案例入手,通过实际的操作,学习具体的知识点

。我们为你规划了一条系统的学习路径,让你不再面对零散的知识点。

说点具体的,比如我们会直接用 lxml+Xpath取代 BeautifulSoup 来进行网页解析,减少你不必要的检查网页元素的操作,比如 Requests 能够解决的事情,我们就不用 urllib了,

多种工具都能完成的,我们会给你最简单的方法

,这些看似细节,但可能是很多人都会踩的坑。

- 每课都有学习资料 -

你可能收集了以G计的的学习资源,但保存后从来没打开过?

我们已经帮你找到了最有用的那部分,并且用最简单的形式描述出来

,帮助你学习,你可以把更多的时间用于练习和实践。

考虑到各种各样的问题,我们在每一节都准备了课后资料,包含四个部分:

1.课程重点笔记,详细阐述重点知识,帮助你理解和后续快速复习;

2.默认你是小白,补充所有基础知识,哪怕是软件的安装与基本操作;

3.课内外案例提供参考代码学习,让你轻松应对主流网站爬虫;

4.超多延伸知识点和更多问题的解决思路,让你有能力去解决实际中遇到的一些特殊问题。

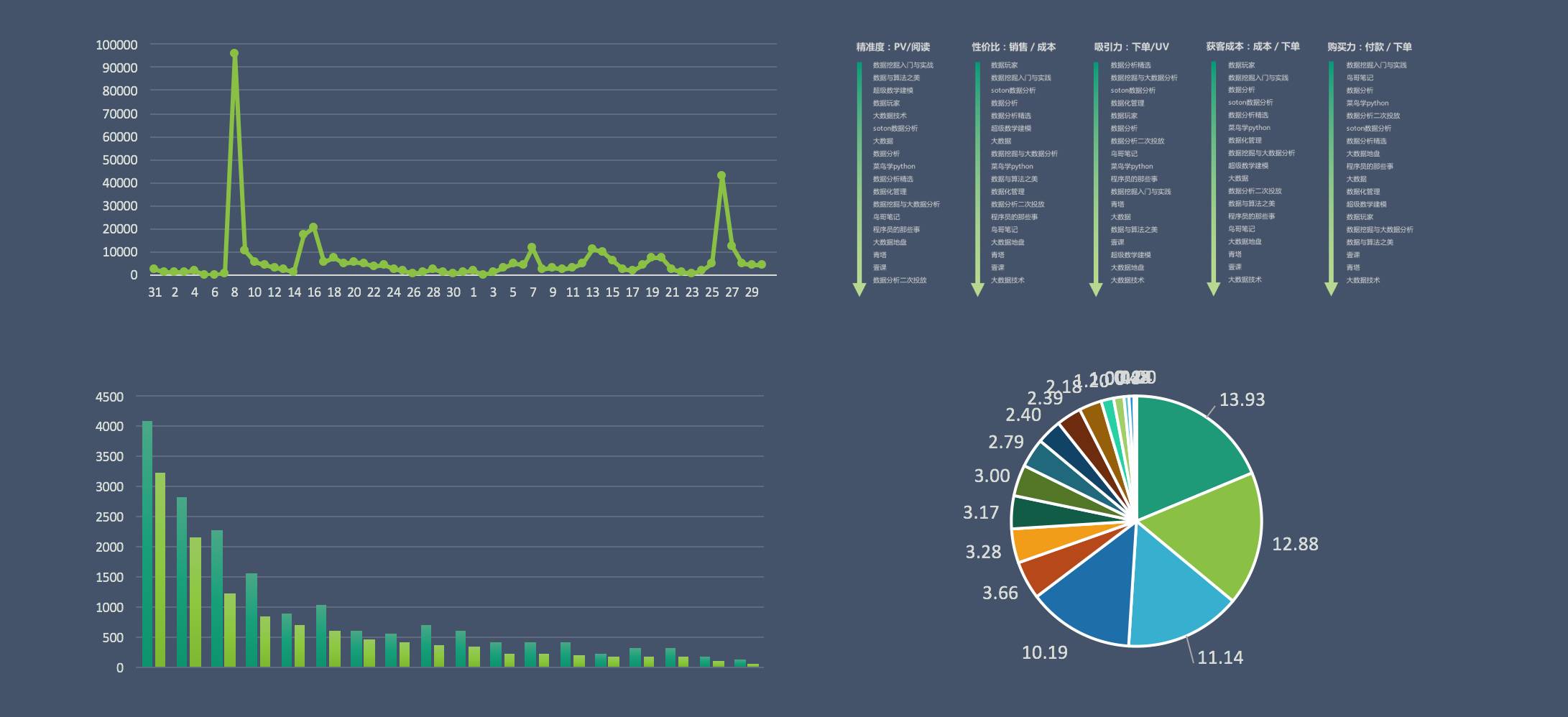

某节部分课后资料

- 超多

案例,覆盖主流网站 -

课程中提供了目前最常见的网站爬虫案例:豆瓣、百度、知乎、淘宝、京东、微博……

每个案例在课程视频中都有详细分析,老师带你完成每一步操作

。

另外,我们还会补充比如小猪、链家、58同城、网易云音乐、微信好友等案例,提供思路与代码。

多次的模仿和练习之后,你可以很轻松地写出自己的爬虫代码,并能够轻松爬取这些主流网站的数据。

- 技能拓展:反爬虫及数据存储、处理 -

懂得基本的爬虫是远远不够的,所以我们会用实际的案例,带你了解一些网站的反爬虫措施,并且用具体的技术绕过限制。

比如异步加载、IP限制、headers限制、验证码等等

,这些比较常见的反爬虫手段,你都可以很好地规避。

工程化的爬虫、及分布式爬虫技术,让你有获取大规模数据的可能。

除了爬虫的内容,你还将了解数据库(Mongodb)、pandas 的基本知识,帮你存储爬取的数据,同时可以对数据进行管理和清洗

,你可以获得更干净的数据,以便后续的分析和处理。