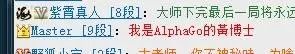

从1月2日起,一个叫“Master”的神秘ID在数个知名围棋平台上大杀四方。昨晚连续50胜之后(点击查看),今天它继续刷新着自己的战绩。柯洁、古力、聂卫平纷纷折戟,仅仅在第52局中断了一下连胜纪录——对手陈耀烨九段意外掉线,这一局被系统判定为平局。

没有身份、没有背景、没有历史、没有目的,不与人沟通只一次次刷新着记录,ID始终无人认领。这样神秘的出场方式与前所未见的诡异棋风,不单令围棋界震惊,也引发了网友的围观。无数人登陆Master所在的围棋线上平台、进入棋室观战,也不停有人追问它究竟是谁。

在今晚21点,“Master”终于做出了回应:

之后,新浪直播员马上宣布了这一消息:

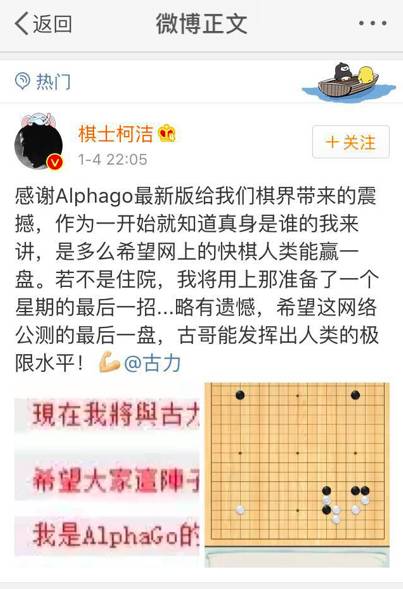

而与此同时,昨晚抱病上阵与“Master”对弈的@棋士柯洁 也发布微博,称“作为一开始就知道真身是谁的我来讲,是多么希望网上的快棋人类能赢一盘”:

这条微博再次证实了Master的身份:

神秘ID“Master”

就是阔别归来的围棋AI——

Alpha Go

AlphaGo并不是一个陌生的名字。2016年3月,举世瞩目的围棋“人机世界大战”在韩国首尔上演,比赛一方是围棋世界冠军、韩国名将李世乭九段,另一方,就是谷歌公司研制的人工智能程序AlphaGo。最终,人工智能以4:1大比分赢取了最终的胜利。

李世乭曾经表示自己很荣幸与电脑公平对弈:“无论结果如何,这都会是围棋史上极其意义的事件。”

李世乭曾经表示自己很荣幸与电脑公平对弈:“无论结果如何,这都会是围棋史上极其意义的事件。”

如今,网民对他的称号变成了“最后一个战胜AlphaGo的人类棋手”。

那时,有不少针对AlphaGo棋艺的褒贬:有些落子目的不明,有些是大昏招(甚至白白送子给对方吃),似乎在刻意避免打劫……并且,毕竟还是输掉了一局。(见:AI战胜人类职业棋手,围棋界怎么看?)

然而短短9个月后,化身“Master”卷土重来的阿尔法狗,几乎已经无人能胜。

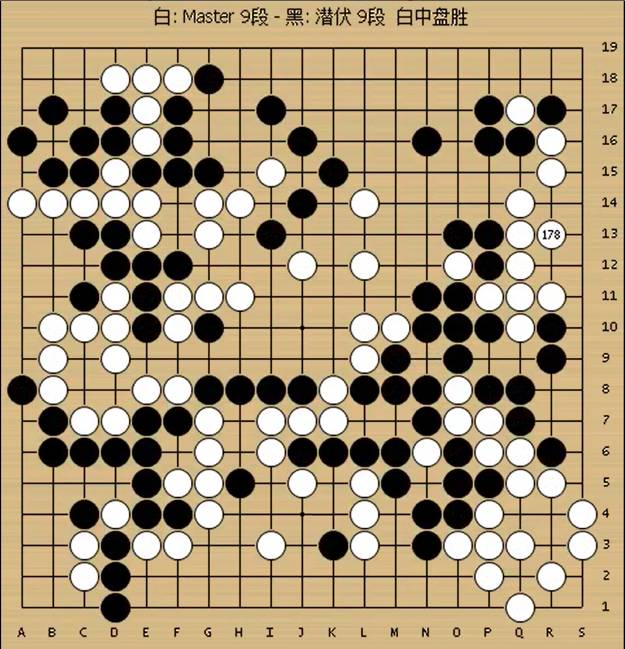

Master对战柯洁的棋局记录。

人类不是第一次在AI面前一败涂地。

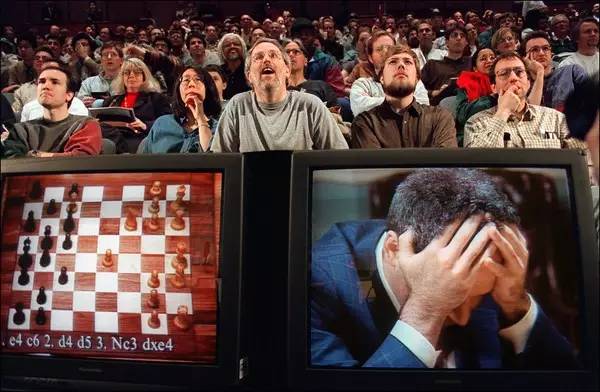

1997年,国际象棋AI第一次打败顶尖的人类;2006年,人类最后一次打败顶尖的国际象棋AI。欧美传统里的顶级人类智力试金石,在人工智能“深蓝”面前轰然崩塌,应验了40多年前计算机科学家的预言。

1997年纽约,与IBM深蓝电脑终局对弈开始时,一台电视监视器上的加里·卡斯帕罗夫。 Credit Stan Honda/Agence France-Presse — Getty Images

今夜,我们同样没有人再能赢过“Master”。如果这一记录无人打破,那就意味着国际象棋AI用了不到10年时间完成的战绩,围棋AI只用了不到10个月。

当然,这不见得就是坏事儿。人类画师的仿真能力早就输给了摄影,但绘画也没有因此失去意义;国际象棋的顶尖AI已经连续十年没输给人类了,国际赛事依然如火如荼。围棋也没什么特别,世界第一不过是名分。

但是如果有一天,AI反叛了呢?它们有死穴吗?

2014年底,三位人工智能研究者在arxiv上贴出了一篇论文预印本。论文标题很有趣:《深度神经网络很好骗》。

深度神经网络,是目前最热门的人工智能路线之一,AlphaGo就以它为核心。它在包括围棋在内的许多领域实现了卓越成就,其中就有“视觉分类”任务——神经网络可以相当准确地判断出一张图片是猫还是企鹅。

但研究者却发现,人为设计的图像很容易骗过它们。这本身没什么了不起,人脑也很容易被骗——但是,令神经网络摔倒的那些图,在人看来却是完全正常的。

左图被神经网络判定为熊猫。给它人为叠加上中图所示微小的扰动(实际叠加权重只有0.7%),就获得了右图。在人类看来,左图和右图没有区别;可是AI却会以99.3%的置信度,一口咬定右图是一只长臂猿。

这不是意外的小失误,也不是偶然的bug——我们发现,只要对图片做出一些人类无法察觉的修改,就能让ai把它当成完全不同的东西;还很容易设计出一些图片,人类什么都看不出来,ai却能以99.99%的把握确信它是某个东西。

更有甚者,这些奇特的错误并不限于某个特定的神经网络,能骗过一个AI的图片,也能骗过另一个;它们也不限于图片识别,甚至不限于神经网络本身——研究者所尝试过的所有机器学习模型,都出现了这样的问题。

AI认为左图是一只狗,右图是一只鸵鸟。图片来源:nautilus

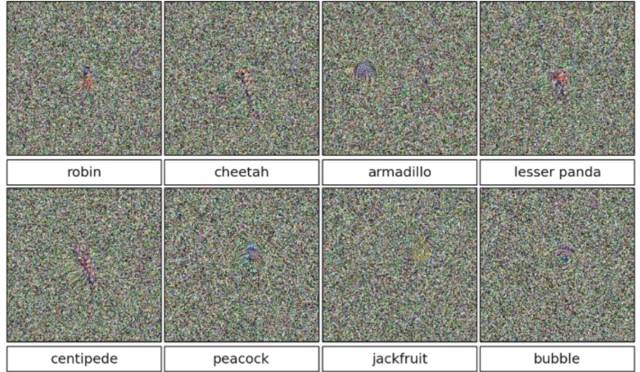

八张图在AI眼中分别是知更鸟、猎豹、犰狳、小熊猫、蜈蚣、孔雀、菠萝蜜和气泡。置信度全部在99.6%以上。

而最大的问题是,当神经网络犯下这样的错误时,研究者并没有特别有效的修正办法。

这样的图片,就是“对抗样本”。

对抗样本自然出现的概率确实非常之低。但是它取这个名字并不是没有理由的:如果真的有人在故意采取对抗手段,那么这就有可能成为该系统的死穴(就像那些靠谐音或错别字骗过过滤器的小黄文一样)。

而从绝对数量来看,对抗样本是非常之多的:如果在空间中任取一点,大部分都会被错误归类。

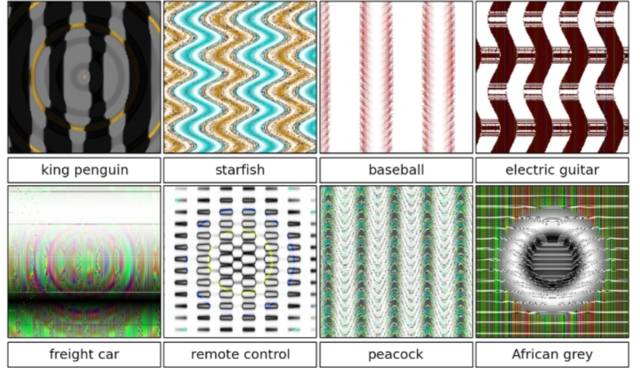

另一种方式构造的八张图,在AI眼中分别是王企鹅、海星、棒球、电吉他、货车、遥控器、孔雀和非洲灰鹦鹉。靠随机生成的图片骗AI并不难。

现在,对抗样本是个坏消息,是系统漏洞。但如果有一天我们真的要和AI正面对决,那么对抗样本也许会成为我们的救命稻草,因为它有这三个特点:

第一,对抗样本并不限于一个具体的神经网络,因此制造对抗样本也不需要获得该模型的源代码之类的东西。只要模型是被训练来执行相同的任务的,它们就会被同样的对抗样本欺骗。

第二,对抗样本很难用常规的办法解决。固费罗的研究组尝试了各种各样传统手段,都不能解决对抗样本问题。有针对性的专门训练可以让模型的抵抗力更强,但也无法真正消灭盲区。

第三,人类不会被这些样本欺骗。当然,人类也会在意想不到的地方跌倒——心理学已经提供了浩如烟海的视错觉和其他错觉例子。还好,AI现在还不知道,嘘……

著名的丁香视错觉图。——人也有bug。

研究者正在努力堵上对抗样本的漏洞,但是完全有可能出现无论如何也堵不上的情况。在这样的背景下,人类和AI的战争如果爆发,也许将进入全新的战场。

其实根本上讲,我们不能说机器被对抗样本“骗”了——也许被骗的其实是我们呢?也许AI真的在那些噪点中发现了某种真正的本质的规律,而我们只是肉眼凡胎不识真面目呢?

但是我们让AI做图像识别,它要分类的图像就是人眼中的场景,它要遵守的规则就是人类大脑的规则。因此某种意义上,我们是主场。

围棋作为一种人类设计的游戏,也许也会是另一个主场。

AlphaGo的源代码尚未公开,但研究者明确指出了它对深度学习的依赖,那么它大概也会被对抗样本困住。

或许某一天,围棋将成为一种双重游戏。对战双方不但要在物理的棋盘上攻城略地,还要设法引导对方步入心智陷阱。应该会有某些棋局能让AI错判,从而让它们下出大错棋,就像现在的研究者能让AI把大熊猫认成长臂猿一样。

同样的机关算尽,人机对战的思路将不同以往。

但是对方的盲区棋局是什么样的?如何下出这样一盘棋局?实现这一局面需要在棋盘上做出多少牺牲?引导对方失误带来的收益能否补偿?是否有可能制造出这样的盘面,令对方陷入更大的心智陷阱,乃至直接死机?

AI反过来也可能也会利用人类的缺陷。我们不知道人类的围棋盲点在哪里,但原则上这也是可能存在的。这一看不见的战场,或许将比看得见的棋盘更加血腥。

截止今夜,化名“Master”的AlphaGo打完了它的最后一局棋,带着60局全胜的战绩下线。我们不知道明天的围棋界将会怎样,但万幸,围棋是人类创造的游戏,这也许能带给我们一些优势。如果哪一天我们必须去玩AI所创造的游戏,那也许才是真正的末日。

ID:Guokr42

整天不知道在科普些啥玩意儿的果壳

我觉得你应该关注一下