7月15日,由GDG上海谷歌开发者社区与UXPA中国行业观察站共同联合举办主题为“人工智能如何改变用户体验”的线下分享沙龙,邀请了人工智能不同领域专家分享交流、当天实际到场观众接近200人,嘉宾与观众进行了活跃互动。本篇为Face++产品负责人乔梁的分享实录。

什么是机器视觉?

我们先讨论一下什么机器视觉。关于AI其实有很多种行业的划分方法,比如根据行业来看,是面向哪个行业的AI,或者说基于在一个企业的运转流程中,帮助企业解决哪部分的问题比如解决财务问题、解决法务问题等。

在这我介绍一种划分方法,这种划分认为机器视觉是一种感知能力。

简单来说机器视觉就是机器的眼睛,我们希望能帮机器看懂这世界上的所有万物。我列举了一些机器视觉案例,有最主要的手机摄像头、车载后视镜、肉眼不可见的结构光等,这些都是机器视觉的方向。

对于我们人类而言,眼睛、耳朵、鼻子是输入设备。我们用嘴巴说话、眉毛表达情绪,这是输出设备。对机器而言,摄像头是机器的输入设备。输入设备是交互的一些方向,最早可追溯到可穿戴设备、智能手机、键鼠、手写。相较于其他设备,摄像头是不需要人工参与的无感知输入。

人机交互 以人为本

经由摄像头做交互,依然是以人为本。我们根据摄像头在接触对象时的交互划分为人脸、人体、人群三个方向。

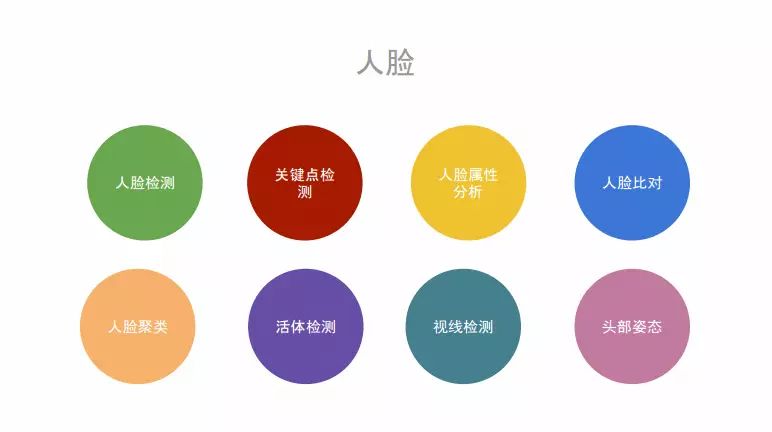

首先是人脸,以下基本是人脸的核心技术,也是目前各大公司所在使用的技术。这些技术包括:

人脸检测:检测并跟踪视频或画面中的人脸,并返回人脸框。如果要分析一张脸,前提是先检测到有脸,所以人脸检测是其他人脸计算的基础。而人脸检测的好坏,有两个角度判断评判,检出物和误检物。检出物,只要这里就张脸,不论大小、角度机器就应该检测出来。误检物,如果那里没有脸,不能把它认为一张脸。

关键点检测:检测面部的 106 个关键点,并精准定位。它的用处比如美图应用里大眼、瘦脸功能,短视频里的贴纸等,需要关键点去定位,对人脸进行上层渲染。好的关键点算法应该在稳定性、贴合度上表现优异。