纠错功能表明,量子计算机的规模越大,其准确性就越高。

芯东西12月10日报道,今日凌晨,谷歌公布重大突破——其最新量子芯片Willow在基准测试取得惊人成绩,不到

5分钟

完成一项标准计算。

而如今最快的超级计算机完成同样的任务,足足要花费超过

10^25年

的时间,比宇宙的年龄还长!

Willow的突破可在使用更多量子比特的情况下成倍减少错误,

破解了近30年来一直在研究的量子纠错挑战

。

Alphabet及谷歌CEO皮查伊发文官宣这项重磅进展后,马斯克立即评论“Wow”。俩人还在评论区热聊起来,皮查伊建议有朝一日用SpaceX的星舰在太空里建个量子集群,马斯克则回应“这很可能会发生”。

连刚发布Sora视频大模型新品的OpenAI联合创始人兼CEO萨姆·阿尔特曼都抽空道喜:“大大的祝贺!!”皮查伊回礼道:“多元宇宙未来的量子+AI即将到来,也恭喜o1发布!”

皮查伊说,Willow是构建有用的量子计算机的重要一步,它在药物发现、聚变能、电池设计等领域都有实际应用。

“我认为大多数人并没有完全理解这一突破的重要性。”大卫·马库斯发文强调说,“这一突破意味着后量子密码学和加密技术需要进一步发展。”

在谷歌量子计算部门首席运营官Charina Chou看来,这一成就意味着到21世纪末,

量子计算机能够实现甚至最强大的超级计算机都无法实现的科学发现

。

谷歌量子AI团队负责人哈特穆特·内文谈道,量子算法有基本的scaling law,许多对AI至关重要的基础计算任务也有类似

scaling

优势,因此量子计算对于收集传统机器无法访问的训练数据、训练和优化某些学习架构以及对量子效应很重要的系统进行建模将是必不可少的。这包括帮助发现新药、为电动汽车设计更高效的电池,以及加速核聚变和新能源替代品的进展。

许多未来改变游戏规则的应用程序中在传统计算机上是行不通的,它们正等待量子计算来解锁。

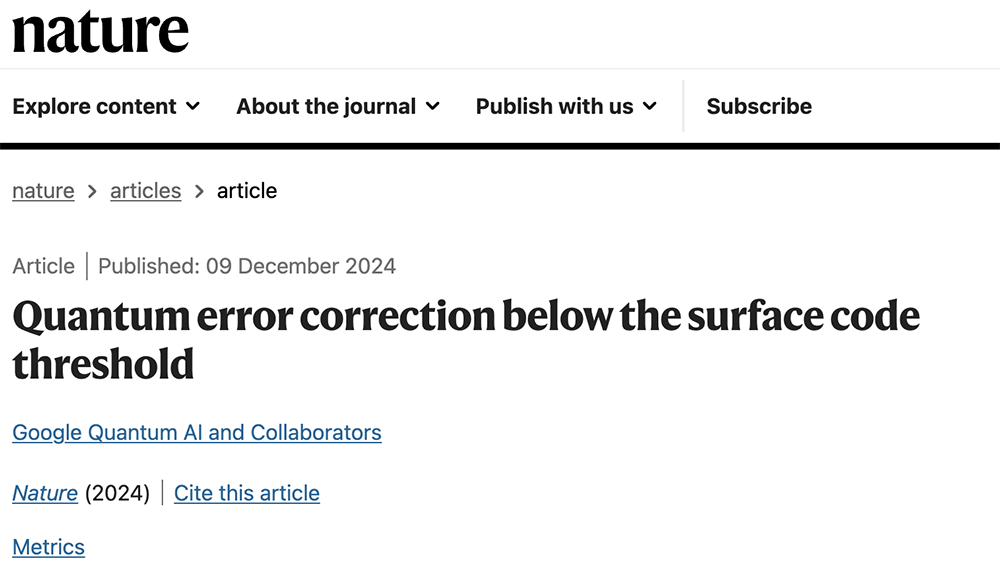

论文地址:

https://www.nature.com/articles/s41586-024-08449-y

错误是量子计算面临的最大挑战之一,因为量子比特往往会与周围环境快速交换信息,因此很难保护完成计算所需的信息。通常,使用的量子比特越多,错误就会越多,系统就会变得像经典系统一样。

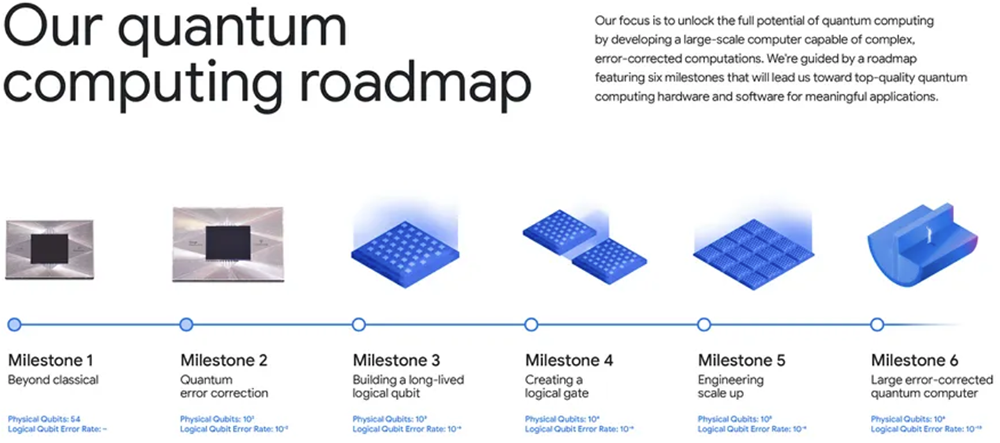

目前的量子计算机对于大多数商业或科学应用来说太小且容易出错。而谷歌的实验表明,采用正确的纠错技术,量子计算机在规模扩大后能以越来越高的准确度执行计算,而且这种改进的速度超过了一个关键临界值。

“这是我们30年来的目标。”谷歌总部研究科学家迈克尔·纽曼在宣布这一成就的新闻发布会上说。

据谷歌量子硬件部门负责人、物理学家朱利安·凯利解释,量子计算机将信息编码为可以表示0或1的状态,但也可以采用多个0和1的无限可能组合。

但这些量子信息状态非常脆弱,要让量子计算机执行有用的计算,你需要量子信息,并且需要保护它免受环境和操作的影响。

为了实现这种保护(没有这种保护,量子计算就无法实现),理论家们从1995年开始开发巧妙的方案,将一个量子比特的信息分散到多个“物理”量子比特上。由此产生的“逻辑量子比特”至少在理论上能够抵御噪声。要使这种称为量子误差校正的技术在实践中发挥作用,就必须证明这种将信息分散到多个量子比特上的方法能够有效降低错误率。

过去几年,IBM、AWS等多家公司和学术团体已经证明,纠错可以略微提高准确性 。谷歌在2023年初发布了一项成果,该成果使用了其Sycamore量子处理器中的49个量子比特,该处理器在超导电路中对每个物理量子比特进行编码。

谷歌新芯片名为

Willow

,是其更大、改进的版本,有

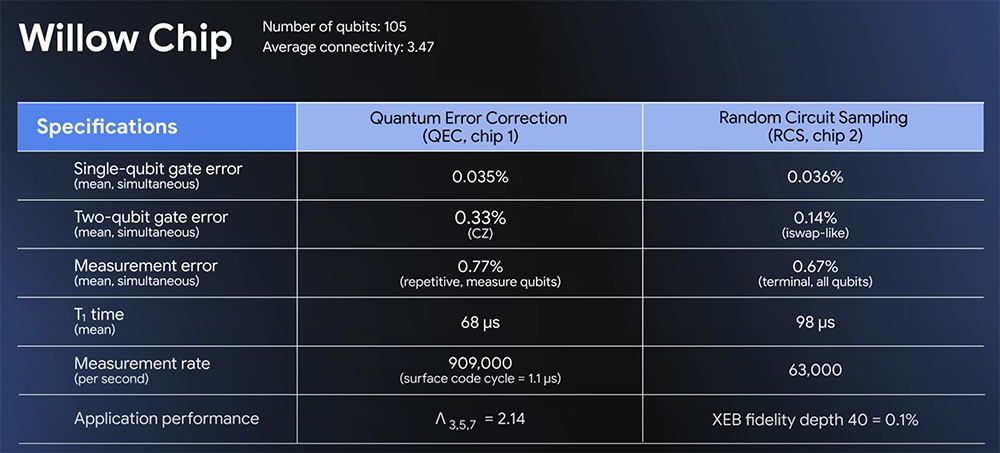

105个

物理量子比特。它是在谷歌于2021年在加州圣巴巴拉的量子计算园区建造的制造实验室中开发的。

系统工程是设计和制造量子芯片的关键:芯片的所有组件都必须同时经过精心设计和集成。如果任何组件滞后或两个组件不能很好地协同工作,就会拖累系统性能。因此,最大化系统性能贯穿于全流程,从芯片架构和制造到门开发和校准。其报告的成就是整体评估量子计算系统,而不是一次只评估一个因素。

谷歌注重质量,而不仅仅是数量。Willow在量子纠错和随机电路采样两个系统基准测试中均拥有一流的性能。此类算法基准测试是衡量芯片整体性能的最佳方式。

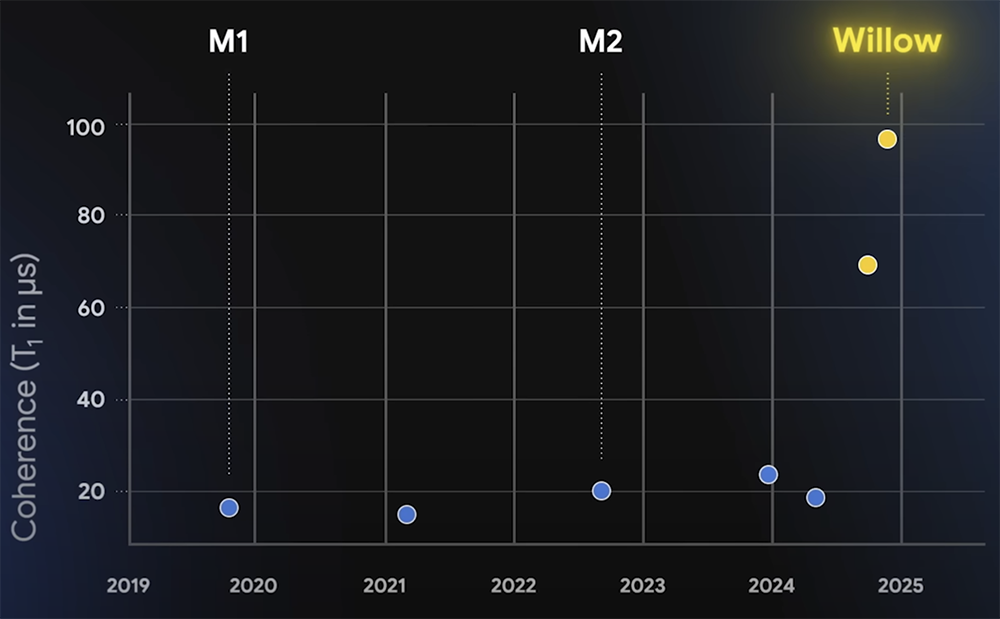

其他更具体的性能指标也很重要;例如,T1时间(测量量子比特可以保留激发的时间长短——关键的量子计算资源)现在接近

100µs

,相比谷歌上一代芯片相比,实现约

5倍

的改进。

谷歌量子计算部门负责人哈特穆特·内文说,这是量子计算机相对于传统计算机的优势的最新体现。