▲点击上方 雷锋网 关注

文 | 李诗

来自雷锋网(leiphone-sz)的报道

想象一下,你用手机拍摄一张照片,然后你不仅可以得到你拍摄时的一个角度,你还可以拖动照片来看到不同角度的视野变化。

这听起来是在描述高大上的光场视频,而不是通常的2D拍照技术,是吧?

今年5月,Facebook介绍了3D照片技术,今天Facebook正式将其3D照片功能带到了iPhone手机上。

当你用iPhone拍摄一张照片时,点击状态更新编辑器中的新3D照片选项,选择肖像模式照片,然后Facebook会用AI计算出场景深度,使得2D照片也可以动起来,呈现出多个角度的景象。

这些3D照片可以在桌面或者手机App中的Facebook实时信息流中体验到。当你滑动信息流时,这些照片和普通照片看起来没有区别,而当你点击进入照片时,他们立刻突破平面2D的束缚,就像一个小窗口一样,一下子把你拉进3D照片的世界。就像上图gif一样,拖动照片你可以你看到狗的侧面和背后的岩石。

雷锋网了解到,这个以AI创造出深度图像的技术来自于Facebook计算摄影部门,讲述这项技术的论文由伦敦大学学院的Peter Hedman和Facebook西雅图办公室的研究科学家Johannes Kopf合著完成,论文曾在今年8月于温哥华举办的Siggraph上展出。

其实,不少巨头都在研发计算图像深度的技术,不过目前他们都只是应用在人像模式中,用以虚化背景。

然而,Facebook的技术路径却是从VR开始的。Facebook以30亿美元收购Oculus后就大力倾注VR,致力于创造一个连接虚拟与现实的全新社交帝国,把现实世界放进VR是一项关键任务,此前的实现方式主要是360度全景视频或者是加上3D效果的360度全景视频,然而,这些全景图片拼接成的内容只是2D图片的大型化,并不具备现实世界的深度感和真实感。

6Dof视频以及更完善的光场视频是大家期望的解决方案,Facebook也一直在这些领域探索。在2017年5月的F8大会上,Facebook发布了两款能记录深度信息的 3D VR全景相机,Facebook 360 Surround x24和x6。今年9月,Facebook发布专业级全景相机 Manifold。

然而,6Dof视频和光场视频的制作成本极高,目前VR的发展也难以吸引大量的内容制作者,Facebook选择了更便捷更民主化的路线——3D照片。

虽然Facebook推出的这项深度图像技术被称为3D视频,但是却和大家熟悉的3D电影的3D效果不是一码事。普通的3D只是通过双目时差实现的伪3D效果,在电影院里,不管你怎么转头,你看到的立体影像都只有一个角度,而Facebook的3D照片的特点是可以拖动查看不同的角度信息。

说了这么多,回到重点,Facebook是如何实现这项技术的呢?

据雷锋网了解,一开始,Facebook采用的方式是让用户以单摄像头的相机拍摄,通过移动来捕捉整个场景,然后通过分析视差和手机运动,即不同距离的物体在相机移动时移动的数据,可以精确地在重建出3D场景。

但是,从单个摄像机的快速图像中推断出深度数据是对CPU的计算要求很高,这种方法在大多数手机都有双摄像头时显得有些过时。通过同时使用两个相机捕获图像,即使对于运动中的物体也可以观察到视差差异。并且因为两个镜头的设备处于完全相同的位置,所以深度数据的噪音要小得多,对运算的要求也低很多。

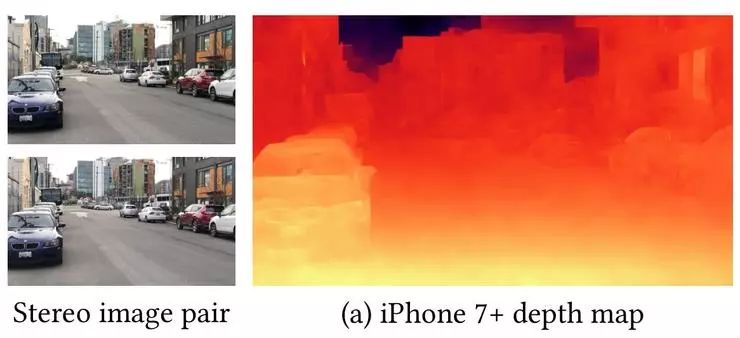

Facebook目前就是采用iPhone的双摄像头,手机的两个摄像头拍摄了一对图像,设备立即自行完成计算“深度图”,图像编码帧中所有内容的计算距离。结果看起来像这样:

苹果、三星、华为、谷歌都在研究深度图像技术,但是目前主要用在照片的背景模糊上面。深度图的技术难点在于,创建的深度图没有某种绝对比例。例如,当深红色意味着100英尺时,浅黄色并不意味着10英尺。每张照片的比例都不相同,这意味着你需要拍摄多张照片来获得物体实际距离,但是要将这些照片拼接在一起是一种痛苦。

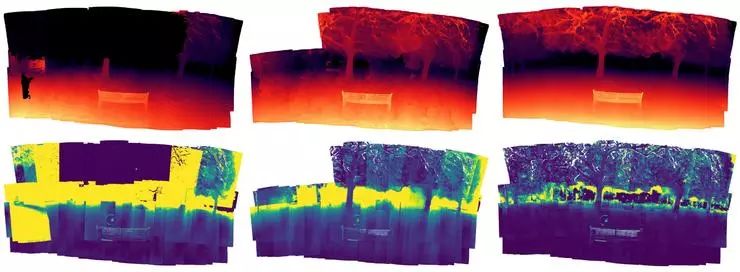

这就是Kopf和Hedman及其同事所面临的问题。在他们的系统中,用户通过移动他们的手机拍摄他们周围环境的多个图像;它每秒捕获一个图像(技术上是两个图像和一个结果深度图)并开始将其添加到其集合中。 在后台,算法会查看手机运动检测系统捕获的相机的深度图和微小运动。然后,深度图基本上被按摩成正确的形状以与其他照片对齐。

创建出深度图之后,深度图会被转换为3D网格(这个比较抽象,可以将其想象为一个纸质版本的景观图)。然后,检查网格的明显边缘,将这些边缘撕裂开,例如前景中栏杆遮挡背景中的景观,就将两者分离开。这会将各种物体隔开,使它们看起来处于不同的深度,并随着透视的变化移动。虽然这些方法创造了3D效果,但是你可能已经猜到前景看起来只不过是一个纸质镂空,因为,如果是直接拍摄的人脸,就没有关于他们的头部或背部。

那么,最后一步就很重要。通过卷积神经网络去猜测和填充图像的其余部分。例如,如果图像区域有头发,那么头发可能会继续存在。因此,它可以令人信服地重新构建这些纹理,并估计对象的形状,缩小间隙。这样当你稍微改变视角时,你似乎真的“围绕”对象看了一圈。

Facebook目前能在一秒钟的时间内完成深度图的创建,因此他们将此称为“即时3D摄影”。当然,3D照片功能目前只能在有两个摄像机上使用,首发这项功能的是iPhone 7+, 8+, X or XS,此后会有更多手机加入。

在论文中,Facebook也讨论了如何用通过另一个卷积神经网络来使得单摄像头的相机也拥有同样功能。但是,单摄像头不如双摄像头系统好。这还需要算法和软件公司的继续努力,正如前些天,雷锋网曾报道,Google就用单摄像头实现了超越苹果双摄像头的多项计算摄影效果。

雷锋网大招募开始了!如果你对人工智能、大数据、云计算、自动驾驶等前沿科技感兴趣,对采编、运营、品牌等职位感兴趣,请猛戳 招聘启事

关于峰会购票信息,点击“阅读原文”了解详情~