在聚类分析的时候确定最佳聚类数目是一个很重要的问题,比如kmeans函数就要你提供聚类数目这个参数,总不能两眼一抹黑乱填一个吧。之前也被这个问题困扰过,看了很多博客,大多泛泛带过。今天把看到的这么多方法进行汇总以及代码实现并尽量弄清每个方法的原理。

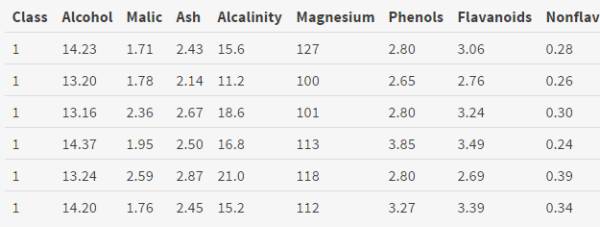

数据集选用比较出名的wine数据集进行分析

library(gclus)

data(wine)

head(wine)

Loading required package: cluster

因为我们要找一个数据集进行聚类分析,所以不需要第一列的种类标签信息,因此去掉第一列。

因为我们要找一个数据集进行聚类分析,所以不需要第一列的种类标签信息,因此去掉第一列。

同时注意到每一列的值差别很大,从1到100多都有,这样会造成误差,所以需要归一化,用scale函数

dataset

去掉标签之后就可以开始对数据集进行聚类分析了,下面就一一介绍各种确定最佳聚类数目的方法

判定方法

1.mclust包

mclust包是聚类分析非常强大的一个包,也是上课时老师给我们介绍的一个包,每次导入时有一种科技感 :) 帮助文档非常详尽,可以进行聚类、分类、密度分析

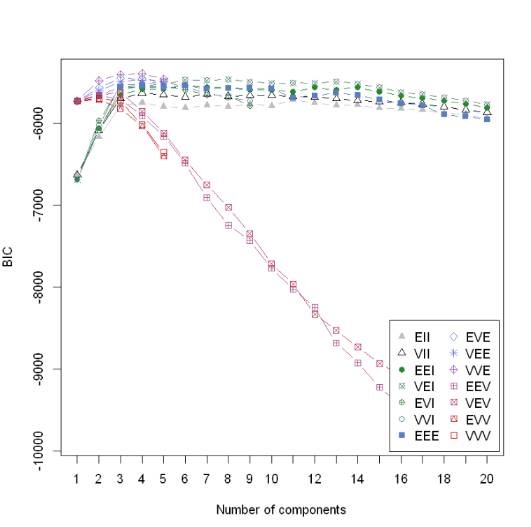

Mclust包方法有点“暴力”,聚类数目自定义,比如我选取的从1到20,然后一共14种模型,每一种模型都计算聚类数目从1到20的BIC值,最终确定最佳聚类数目,这种方法的思想很直接了当,但是弊端也就显然易见了——时间复杂度太高,效率低。

library(mclust)

m_clust

Gaussian finite mixture model fitted by EM algorithm

Mclust EVE (ellipsoidal, equal volume and orientation) model with 3 components:

log.likelihood n df BIC ICL

-3032.45 178 156 -6873.257 -6873.549

Clustering table:

1 2 3

63 51 64

可见该函数已经把数据集聚类为3种类型了。数目分别为63、51、64。再画出14个指标随着聚类数目变化的走势图

plot(m_clust, "BIC")

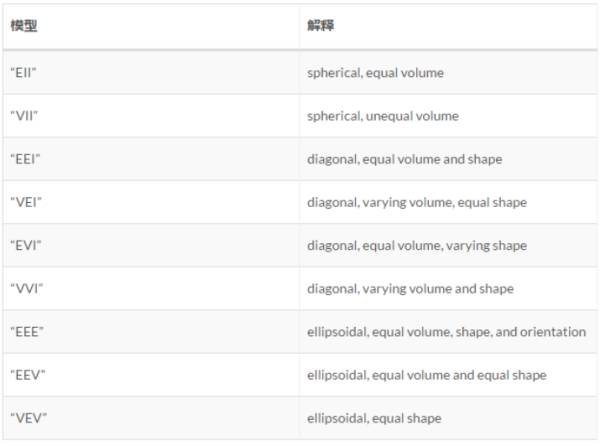

下表是这些模型的意义

它们应该分别代表着相关性(完全正负相关——对角线、稍强正负相关——椭圆、无关——圆)等参数的改变对应的模型,研究清楚这些又是非常复杂的问题了,先按下不表,知道

BIC值越大则说明所选取的变量集合拟合效果越好

上图中除了两个模型一直递增,其他的12模型数基本上都是在聚类数目为3的时候达到峰值,所以该算法由此得出最佳聚类数目为3的结论。

mclust包还可以用于分类、密度估计等,这个包值得好好把玩。

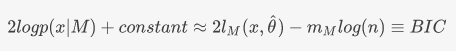

注意:此BIC并不是贝叶斯信息准则!!!

最近上课老师讲金融模型时提到了BIC值,说BIC值越小模型效果越好,顿时想起这里是在图中BIC极大值为最佳聚类数目,然后和老师探讨了这个问题,之前这里误导大家了,Mclust包里面的BIC并不是贝叶斯信息准则。

1.维基

上的贝叶斯信息准则定义

![]()

与log(likelihood)成反比,极大似然估计是值越大越好,那么BIC值确实是越小模型效果越好

2.Mclust包中的BIC定义[3]

这是Mclust包里面作者定义的“BIC值”,此BIC非彼BIC,这里是作者自己定义的BIC,可以看到,这里的BIC与极大似然估计是成正比的,所以这里是BIC值越大越好,与贝叶斯信息准则值越小模型越好的结论并不冲突

这是Mclust包里面作者定义的“BIC值”,此BIC非彼BIC,这里是作者自己定义的BIC,可以看到,这里的BIC与极大似然估计是成正比的,所以这里是BIC值越大越好,与贝叶斯信息准则值越小模型越好的结论并不冲突

2.Nbclust包

Nbclust包是我在《R语言实战》上看到的一个包,思想和mclust包比较相近,也是定义了几十个评估指标,然后聚类数目从2遍历到15(自己设定),然后通过这些指标看分别在聚类数为多少时达到最优,最后选择指标支持数最多的聚类数目就是最佳聚类数目。