在此次研究取得突破之前,出现了许多促使人工智能破译人类所见、回忆、想象和梦境内容的研究。早在2008年,日本的另一个科学家团队直接在电脑屏幕上成功地重现了从人类大脑活动中获取的图像。

然而,以往的研究存在着诸多障碍。

由于个体的大脑内容具有独特性,故而很难创建思维模式的目录。而且这些模式都要和少数预编程图像相结合,而要完成这一阶段就必须对实验参与者接收的长期的、高成本的图像测试进行大量的处理,难度颇大。

不过,随着人工智能技术的不断进步,该领域的研究进入了一个新的阶段。

日本京都大学教授神谷之康及其团队日前在《自然·通讯》中发表研究报告称,根据其团队的研究成果,发现可以利用人工神经网络破译人类的大脑活动,将其转为可理解的信号。

在这一研究中,人工神经网络其实就是一种在实验室造神经元基础之上建立起的计算机模型。通过传统的算法技术,人工神经网络能够制造出具有理解能力和解决难题能力的计算机软件,它的运行方式类似于人类大脑神经元,能够解读人类思维。

成就不止来源于日本科学团队,在太平洋彼岸的美国,谷歌AI也同样能够像人类那样思考,甚至能创作出“艺术作品”了。

《大西洋月刊》是美国最受尊敬的杂志之一。最近《大西洋月刊》撰文称,人类最早在岩石上画图的时候,就意味着认知跃进已经实现。如今,计算机也在学习做同样的事情。最主要的表现,是谷歌AI能够通过人类那样的思维方式去完成绘画。

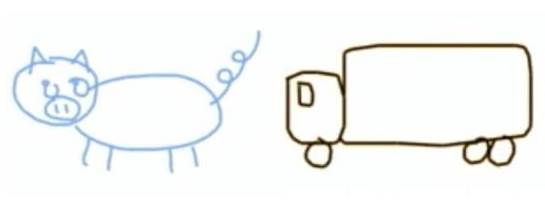

例如,让我们去画一辆车和一头猪,我们会这样画:

这非常简单。然后,我们被要求画个“猪卡车”。按照人类的思维模式,会想办法将二者结合起来,于是就变成了这样:

车轮变成了小猪蹄,驾驶室应该是小眼睛,猪鼻子是车头。单就这幅画来看,的确是对“猪卡车”很有创意的解读。不过,这并不是人类的作品,而是来自于人工智能系统SketchRNN。这一系统是谷歌AI项目Project Magenta中的一部分,旨在探究AI能否创作艺术。

该项目负责人Doug Eck表示,SketchRNN的意义远不止学习如何绘画,而是在于“用类似于人类的方式概括归纳抽象的概念”。

换言之,该团队并非只是为了打造一台能够画猪的机器,而是使机器能够识别出“猪的特征”。比如,即便是机器只得到诸如“卡车”这类的提示性语言,也能够不受任何影响地做出准确判断。

这其中隐含的意思是,人类在绘画过程中,会对外部世界产生抽象概念。我们画出的是“猪”的广义概念,而非某头特定的猪。换言之,人类如何画猪,和大脑中如何储存“猪的特征”这一信息相关联。学习如何画猪,就能学会人脑合成“猪的特征”的能力。