本文转载自药明康德“康健新视野”微信公众号

随着人工智能在近期的兴起,人们难免将人脑与人工智能进行起了比较。一些对人类充满自信的人认为,即便人工智能在疾病诊断等领域的表现已经超过了人类,人类大脑还有着一项无可比拟的优势——

机器永远不知道人脑在想些什么。

但最近在线发表的一项研究则给这份自信泼上了一盆冷水。

来自中科院何晖光研究员的团队开发出了一款能“读心”的算法

,通过对脑部的功能性磁共振成像(fMRI),它能精准地读出人脑中的图像。这也离

“机器识别人类思考”

这一命题更近了一步。

▲

该研究的主要负责人,中科院何晖光研究员(图片来源:中科院)

长久以来,通过脑部扫描重塑视觉影像就是神经科学中的一个发展热点。过去,许多研究人员已经取得了初步的进展,并能通过监控大脑视觉皮层的活动,还原出一个人的所见。然而,目前采用的主要手段fMRI容易带来很大的信号噪音,这也极大地降低了还原出的图像的质量。如果能有一种更好的工具去剔除fMRI带来的噪音,我们或许就可以在这一领域取得突破。

这正是何晖光研究员团队所作出的贡献。

他们开发了一种深度学习的技术,能更好地处理从fMRI中得到的数据,并对信号噪音进行抑制。

在研究的开始,他们获取了一批现成的人类视觉皮层fMRI扫描数据。在这些视觉皮层接受扫描时,这些当事人正在观看一副简单的图片,如一个数字,或是一个字母。随后,研究人员将大脑扫描图像与简单图片一一对应起来,交给“读心”算法去自我学习。

经过了超过1500张fMRI图像的训练后,“读心”算法迅速地掌握了如何将大脑扫描图像与实际图片一一对应的能力。

随后,研究人员给这款算法另外一些它从未见过的fMRI图像,并要求这款算法猜测进行扫描时,当事人正在观看什么样的图片。

效果令人惊叹!

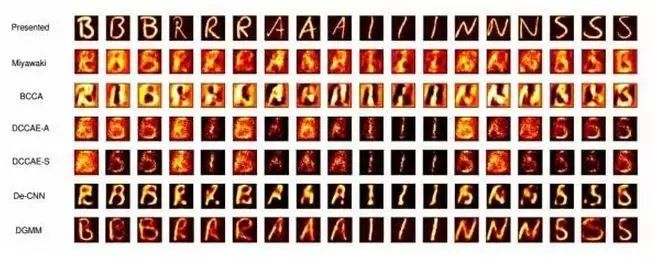

▲

这款“读心”算法(最下一行)的效果令人惊叹(图片来源:arxiv.org)

首先,这款算法只需要通过fMRI中的部分数据,就可以还原出原始的图片

,无需处理整张图像上的数据。

其次,这款算法也学会了将不同的数据进行联系

,这相当重要——如果不懂得将数据进行联系,算法的眼中就只有两种东西,用来处理的信息,以及用来丢弃的噪音。在懂得联系数据后,这些算法能保留更多的真实信息,这也能进一步增强“读心”的准确度。

更夸张的是,通过比较,研究人员发现,

这些“读心”的结果和原始的图片及其接近,要胜过目前所有的方法。

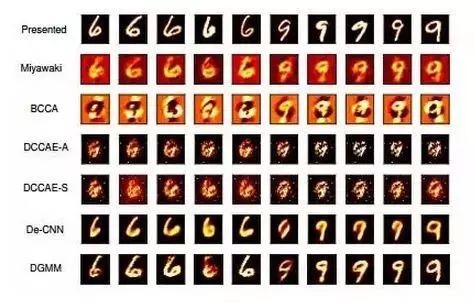

▲

在还原数字方面,这款“读心”算法的结果几乎可以乱真(图片来源:arxiv.org)

这或许给目前火热的

“脑机接口”

提供了新的途径。

对于许多瘫痪患者来说,他们无法正常使用自己的双手,因此他们与社会交流的成本也极高。最近,斯坦福大学以及Facebook的研究人员开发出了一种

新的技术

,能让瘫痪患者们通过意念打字。然而,这种打字的速度仍然很低。如果能辅以全新的技术,比如直接通过扫描患者头部来得知所见所想,或许就能为“脑机接口”提供新的解决思路。

下一步,研究人员计划用“读心”算法,处理更为复杂的图像

,比如正在运动的图片。最终,中科院的研究人员还计划读取大脑中的音频和身体动作。

在之后的故事,谁知道呢。也许,这些

“读心”算法会带来对人类大脑认识的飞跃,让机器读懂人类的想法。

这样的未来会出现吗?我们拭目以待。

参考资料:

[1] Sharing deep generative representation for perceived image reconstruction from human brain activity

[2] Mind-Reading Algorithms Reconstruct What You’re Seeing Using Brain-Scan Data