自解说,6分钟左右。

如有wifi请务必听着自解说观看~(流量较多,务必WiFi~)

最近试了一个小实验,发现当神经网络参数全部初始化为全0的时候

(这样最省力嘛)

,效果并不好,后来和请教了ybb并且网上查阅了一些资料,记录一下自己的笔记和总结,欢迎大家指错交流~

还是原来的写作风格,通过一个具体例子,在讲例子的过程中,通俗解释要讲的知识点。见下!

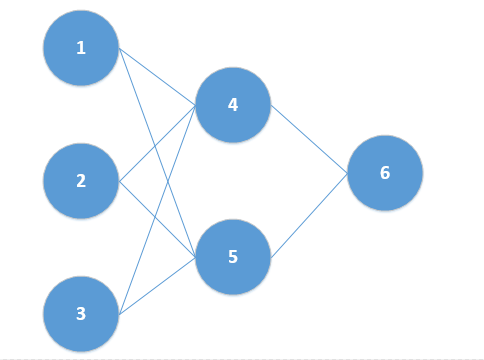

假设我们现在需要初始化的神经网络如下所示:

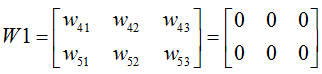

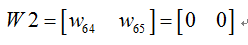

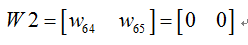

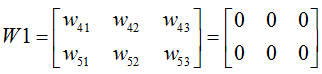

我们初始化权值为

其中W1代表

输入层到隐藏层

的权值矩阵,W2代表

隐藏层到输出层

的权值矩阵。

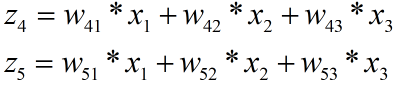

假设网络的输入为[x1,x2,x3],然后通过网络的正向传播,可以得出:

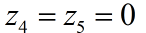

由于

我们可以知道:

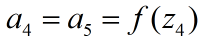

从上面可以知道,此时隐藏层的值是相同的,然后经过激活函数f后,

得到的a4,a5仍然是相同的

,如下:

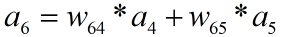

最终网络的输出为:

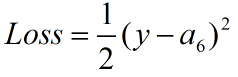

此时,假设我们的真实输出为y,则均方误差损失函数可以表示为

:

到了这里,此时又应该到我们伟大的BP反向传播算法出场了!

我们需要反向更新权值,它使得预测的输出值与真实值越来越靠近。

这里假设我们的读者已经知道了BP反向传播的过程,可以参看

通俗理解神经网络BP反向传播算法

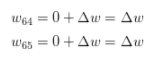

可以知道,通过反向传播后,结点4,5的梯度改变是一样的,假设都是,那么此时结点4与结点6之间的参数,与结点5与结点6之间的参数变为了,如下:

由上式可以看出,新的参数相同了!!!!

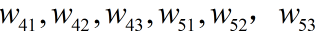

同理可以得出输入层与隐藏层之间的参数更新都是一样的,得出更新之后的参数

都是相同的!然后不管进行多少轮正向传播以及反向传播,每俩层之间的参数都是一样的。

转自:自然语言处理与机器学习