在 AlphaGo 胜利光芒的照耀下,各个国家、企业都开始围绕人工智能(AI)展开激烈的竞争,生怕慢一步,就会错过即将到来的全新科技曙光。

但 Yann LeCun 却说,“这条路我们无法预测有多远要走,可能要越过崇山峻岭,翻过第一个山头后,还有无数的山头等待着被征服。”

Yann LeCun是谁?

这个名字对于不太关注人工智能的人来说或许会稍显陌生。但事实上,业内对于这位 Facebook 人工智能研究院(FAIR)的掌门人评价极高,一致认为他是人工智能领域内的大师。

但就是这样一位大师的人物也无法准确的告知世人AI的未来究竟是怎样的!他唯一指出的是:

科研人员的通病就是太高估短期的进展,却低估了长期的发展效益,对于 AI 发展,现在能做的就是奔向那些

等待被世人征服的高山。

图丨Facebook人工智能研究院(FAIR)院长Yann LeCun

人工智能的发展并非从现今才开始,学术界从上世纪60年代就已展开了研究,例如 Frank Rosenblatt 提出的感知器(The Perception)。

“当时的神经科学带动了后续的机器学习及AI的发展”,

LeCun说。

但历经了一波狂热之后,整体科学界对 AI 研究却走向沉寂,大家所投入的兴趣、资金均大幅减少,于是就来到了业界人士口中所谓的“AI寒冬

”

(AI Winter)时期。直到近年来,计算机软件系统及 GPU 的效能提升及价格降低,云端服务开始普及,大数据的概念深入人心,以及 Google、Amazon、Facebook等各大巨头积极投入,在天时地利人合下,AI成了显学,AI First是顺理成章的成了人人必喊的口号。

今年适逢苹果 iPhone 推出十周年,人们对于苹果创办人乔布斯历经失败、重返荣耀的故事耳熟能详。然而,现在身为人工智能大师的LeCun,一路走来也并非顺风顺水,他也曾被边缘化,他认为让机器建立有知觉的神经网络(Neural Network)以及开发的卷积神经网络(Convolutional Nets)理论在当时都不受到青睐。

LeCun自己就举了一个有趣的例子。过去他在AT&T贝尔实验室(AT&T Bell Labs)做研发,在1988~1992年间,Bell Labs的Adaptive Systems Research Department开发了卷积神经网络和支持向量机(SVM)。人工智能祖师级人物、英伟达的机器学习顾问Larry Jackel当时是部门的主管,研究小组成员包括Yann LeCun和统计学习理论之父Vladmir Vapnik等人。

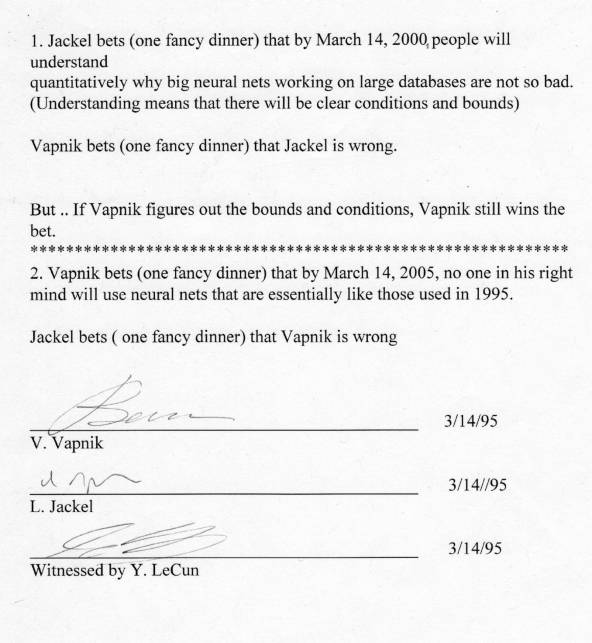

图丨

Larry Jackel、Vladmir Vapnik和Yann LeCun

1995年,Jackel 和 Vapnik 打了两个赌,谁输了就要请谁吃一顿高级丰盛的晚餐,LeCun则是这场赌注的见证人。

第一个打赌是什么呢?Jackel 认为,到了 2000 年人们会了解,大型神经网络可以很好地应用在庞大的资料库中。

但,他输了。

第二个打赌则是,Vapnik 认为,直到 2000 年以前没有人会使用他们在 1995 年就已经拥有的神经网络架构。但他认为,每个人都会使用支持向量机。

Vapnik 不仅在 2000 年输了,而且 2012 年 Google 和微软都部署了神经网络的案例更加证明他的失算。

LeCun 回忆并笑着说,2000 年他们在纽约的 Siam Garden 餐厅享用了这顿晚餐,Jackel 和 Vapnik 平分帐单。但这个有名的打赌说明了现今 AI 主流技术是历经了多年才被众人所接受及应用。

图丨

三位大师对人工智能相关技术的打赌,来自Yann LeCun的Google+帐号

LeCun 近期在大陆和台湾展开了一系列的学术演讲。在演讲上,他先是带大家回顾了AI技术发展的历程,例如监督式学习 (Supervised Learning)、深度学习(Deep Learning)、多层神经网络(Multi-Layer Neural Nets)、卷积神经网络

(

Convolutional Nets

)

等。

再加上前不久 Facebook 宣布全球用户突破 20 亿,使得外界更加好奇FAIR都在做什么?又已经做出了什么?不过 LeCun 并未透露太多,只表示有些已经应用在Facebook网站上,例如照片的人脸、物体辨识、建议用户可标示朋友。同时,也有希望将AI技术应用在打击恐怖主义上。

英国诗人雪莱曾说:“冬天来了,春天还会远吗?”如今,人工智能走过发展的寒冬,正迎接看似欣欣向荣的春天,但是,LeCun毫不讳言还是有很多阻碍在前,例如:

第一,机器必须学习或了解世界是如何运作的,包括物理的世界、

网络的世界、人际互动等,必须具备一定程度的常识知

识;

第二,它们必须透过观察或行动来学习大量的背景知识;

第三,机器必须感知世界;

第四,机器必须持续更新、记忆所预估的世界状态;

第五,机器要能推理和计划。

LeCun因此提出一个公式:智能+常识=感知+预测模型+记忆+推理及计划。

“有了常识就能填补空白。”LeCun说。但是,我们该怎么让机器学会常识呢?他认为,答案可能是非监督式学习(Unsupervised Learning)或预测学习(Predictive Learning)。

监督式学习(Supervised Learning)是机器学习领域的一个分支,是将资料标示出各种标签,机器就在这些标签中寻找或建立一个模型,并据此模型进行实际上的推测,例如利用历史股价来预测未来的股价走向。

非监督式学习则强调不必人工加入标签,而是让机器观察世界运作,建立起常识,就能做出直觉的反应或判断,就像小孩的学习一样。他认为,光有监督式学习是不够的,还需要非监督式学习,而训练一个大型的学习机器需要多少的范例,则是取决于我们希望它能预测出多少信息。

预测未来20年人工智能的蓝图是什么

从某种程度上来说,AI已经充斥着我们生活的各个角落了,每个人对于AI的想像及期待各有不同,未来呢?可以预测从现在未来AI的发展的样貌吗?

LeCun很直接的说:“我无法预测!”他进一步表示,“科研人员往往太过高估某项技术在短期的进步,而低估了长期的推进。”通常,我们认为只要能找出某件事、某些东西背后的原理,我们就能建立起它们,最后它们就会运作成功。

但是,回想一下,很久以前我们就发现了火箭背后的原理,但从发现原理到将火箭送上天,这中间是很大的一步路,因为太复杂了。这就是我们低估了短期内实践的复杂度。同时,我们也低估了长期的演进,因为没有人可以预先看到革命的到来。

过去有人预测AI的发展,但都失败了,所以我提出很多目前我们都还无法解决的阻碍,尽管我们可能有一些想法,但尚未发展成解决方法。“AI在我心中,就是我们有一座很高的山必须跨越。而且当我们跨越了之后,我们不知道还有多少座在前方等着我们。”LeCun说。

不过,LeCun也强调,从自然界找灵感,模仿自然是个思路,但是也不宜过多,我们必须理解很多事,例如我们该怎么知道哪些细节很重要、哪些细节只是演进的结果、哪些是生物模仿是受到限制的。就像飞机的发明一样,人类在发展了空气动力学和流体力学之后,就会知道羽毛和拍打翅膀其实并不重要。

“所以,问问自己,智能领域的‘空气动力学’会是什么?”这是LeCun留给大家思考的问题。

-End-

此文来自驻台北编辑詹小娴

欲知会员计划详情,请点击以上图片