【导读】

美国马里兰大学、复旦大学和Gobasco人工智能实验室联合提出

R-FCN-3000实时3000类目标检测框架

,对R-FCN框架中的物体检测和分类进行解耦。本文对R-FCN体系结构进行修改,其中位置敏感滤波器在不同的目标类之间共享来进行定位。对于细粒度的分类,这些位置敏感的滤波器是不需要的。因此,R-FCN-3000学习到了通用的物体性,也达到了更快的速度。R-FCN-3000在ImageNet检测数据集上获得34.9%的mAP,在每秒处理30帧图像的同时,可以以18%的优势超过YOLO-9000。作者相信,未来R-FCN-3000可以适用于更为广阔的目标检测场景(如十万类目标检测),并可以更好的整合目标类别先验。代码将会公开。

▌作者

-

Bharat Singh 马里兰大学计算机系博士生,主要研究方向为目标及动作识别

http://www.cs.umd.edu/~bharat/

-

Hengduo Li 复旦大学在读本科生

https://www.linkedin.com/in/hengduo-li-50588032/

-

Abhishek Sharma 印度德里农业供应链科技初创公司Gobasco联合创始人

https://www.linkedin.com/in/abhishek-sharma-a1204921/

-

Larry S. Davis 马里兰大学教授

http://www.umiacs.umd.edu/~lsd/

论文:R-FCN-3000 at 30fps: Decoupling Detection and Classification

▌

摘要

我们提出了

R-FCN-3000

,一个大规模的实时目标检测器,其中的目标检测和分类是解耦的。为了获得

RoI

的检测分数,我们将物体性分数(

objectnessscore

)乘以细粒度的类别分数。我们的方法是对

R-FCN

体系结构进行修改,其中位置敏感滤波器在不同的目标类之间共享来进行定位。对于细粒度的分类,这些位置敏感的滤波器是不需要的。

R-FCN-3000

在

ImageNet

检测数据集上获得

34.9

%的

mAP

,在每秒处理

30

帧图像的同时,超过

YOLO-9000 18

%。我们还表明,

R-FCN-3000

学习的物体性可以被推广到新的类中,并且性能随着训练目标类的数量增加而增加。这个结论证明了我们可以学习通用目标检测器。本文将随后提供代码。

▌

详细内容

随着深度

CNNs

的出现,目标检测在基准数据集上的性能取得了重大飞跃。这归功于

CNN

结构的强大的学习能力。在过去的五年中,

PASCAL

和

COCO

的

mAP

得分分别从

33

%提高到

88

%和从

37

%提高到

73

%(在重叠率

50

%的评价标准上)。虽然在有数十个类别的基准数据库上有了很大的改进,但是对于需要实时检测数千个类别的现实生活中的目标检测进展甚微。最近的一些努力已经构建了了大规模的检测系统,但是以牺牲准确度为代价。

这篇文章提出了一个新颖的解决方案,能够在比

YOLO-9000

提高

18

%的精度来完成大规模目标检测问题,每秒可以处理

30

帧图像,同时检测

3000

个类别,被称为

R-FCN-3000

。

R-FCN-3000

是对最近的一些目标检测体系结构

[

文章中文献

6,5,23,25,29]

进行修改以实现实时大规模目标检测的任务。最近提出的全卷积(

fullyconvolutional

)分类检测器计算给定图像中目标的每类分数。其在有限的计算预算中显示出惊人的准确性。虽然全卷积方式为诸如目标检测

[6]

,实例分割

[22]

,跟踪

[10]

,关系检测

[41]

等任务提供了一个有效的解决方案,但他们需要为每个类设置类特定的过滤器,以禁止他们应用于其他的类。例如,

R-FCN [5] / Deformable-R-FCN [6]

要求每个类别有

49/197

个位置特定的滤波器。

Retina-Net [23]

对于每个卷积特征映射,每个类需要

9

个滤波器。

因此,这样的结构将需要数十万个用于检测

3000

个类的过滤器,这将使得它们在实际应用中速度非常慢。

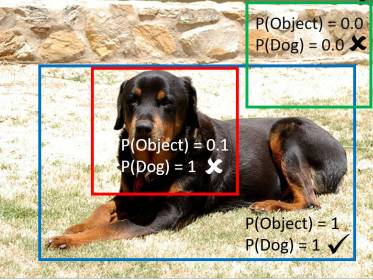

图1:这篇文章建议通过独立地预测物体性和类别得分来解耦分类和定位两个过程。这些分数相乘得到一个检测器。

转自:专知

完整内容请点击“阅读原文”