为解决传统时间序列预测方法在处理复杂和非线性问题上的局限性,研究者们致力于探索深度学习的方法。

目前,

用深度学习做时间序列预测主要有4大创新方向:基于MLP、基于Transformer、基于CNN以及基于RNN。

这些深度学习模型通过端到端学习直接生成预测,简化流程提高效率。它们能够处理高维数据,并通过大数据训练提升预测精度和适应性,为时序预测提供了新颖而强大的解决方案,也因此成为了学术研究和发表论文的热门领域。

本文介绍深度学习时序预测这4大创新方向,每个方向都附有

代表论文以及代码(共

22篇

)

,方便同学们理解学习以及复现。

扫码添加小享,

回复“

时序大方向

”

免费获取

全部论文+开源代码

基于MLP的模型

使用多层感知器来自动学习和提取时间序列数据的特征,适用于捕捉复杂模式并进行预测,但可能需要结合其他技术以更好地处理时间依赖性。

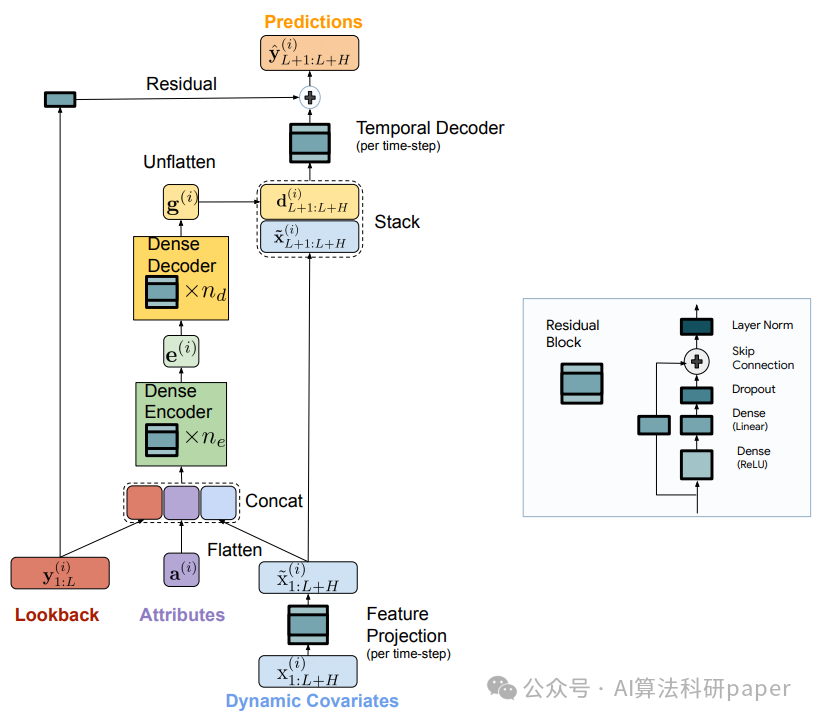

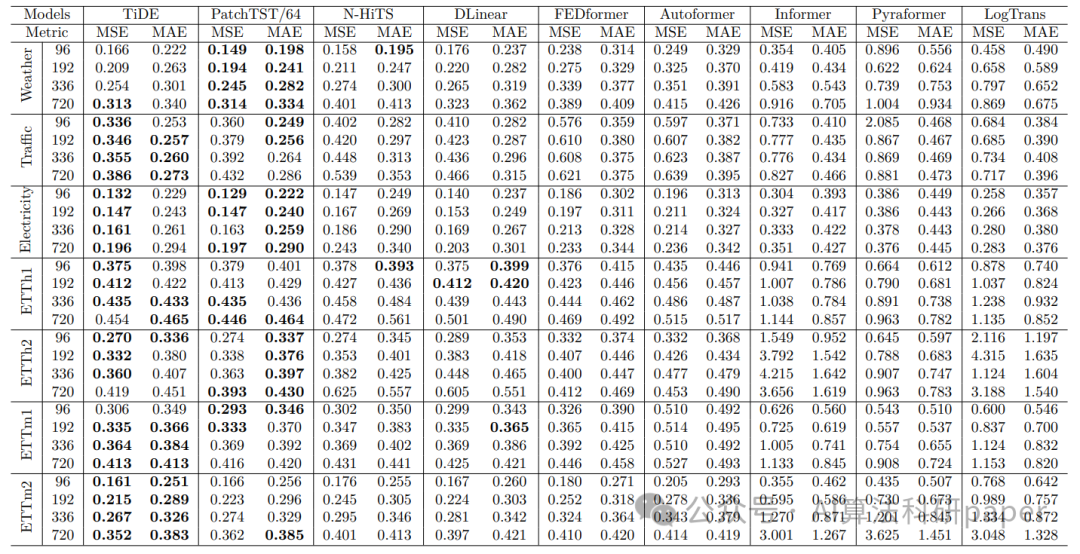

代表论文:Long-term Forecasting with TiDE: Time-series Dense Encoder

方法:

本文介绍了一种简单且高效的多层感知器(MLP)架构,称为时间序列稠密编码器(TiDE),用于长期时间序列预测。TiDE模型通过使用密集的MLP对时间序列的过去和协变量进行编码,并使用密集的MLP对时间序列和未来协变量进行解码。

创新点:

-

提出了一种简单的基于多层感知机(MLP)的编码器-解码器模型,称为TiDE,用于长期时间序列预测。TiDE模型在流行的长期时间序列预测基准测试中表现优秀,性能优于现有的神经网络模型,同时比最佳Transformer模型快5-10倍。

-

分析了模型的一个简化的线性模拟,并证明在某些条件下,这个线性模型对于线性动力系统(LDS)的预测可以达到近乎最优的误差率。

-

在流行的真实世界长期时间序列预测基准测试中,该模型在与先前的神经网络基线模型相比实现了更好或相似的性能(最大数据集的均方误差降低了超过10%)。

基于Transformer的模型

利用自注意力机制捕捉长期依赖性,通过编码器-解码器架构处理历史数据并生成预测,同时应用位置编码和掩蔽技术以确保准确性,适合处理复杂的时间序列数据。

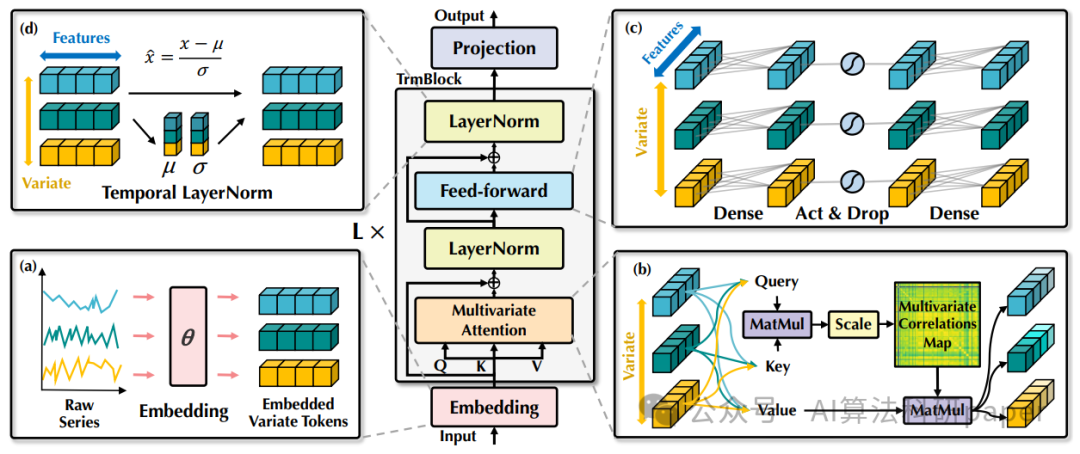

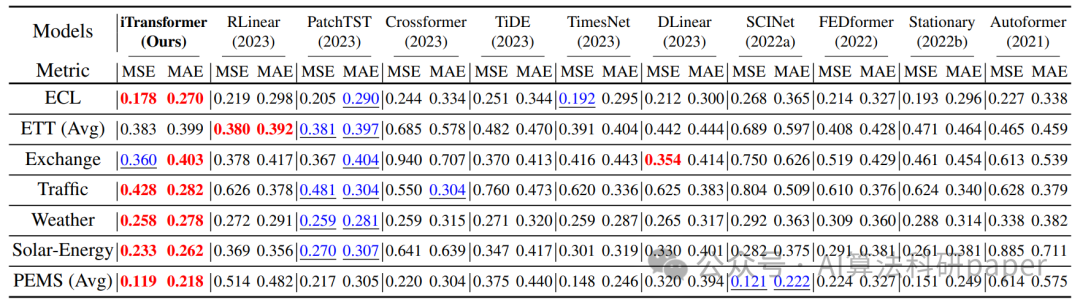

代表论文:iTransformer: Inverted Transformers Are Effective for Time Series Forecasting

方法:

论文提出了iTransformer,它是一种基于Transformer的时间序列预测模型,通过反转Transformer的结构,在变量维度上应用注意力机制和在时间维度上应用前馈网络,以捕捉多变量之间的相关性和学习序列表示。

创新点:

-

iTransformer采用了将独立的时间序列作为变量标记来捕捉多变量之间的相关性,同时利用层归一化和前馈网络来学习系列表示。

-

iTransformer的性能优于其他Transformer变体,这证明了在倒置结构中应用的注意力和前馈网络模块可以显著提升Transformer在多变量时间序列预测中的性能。

扫码添加小享,

回复“