掐指一算,距离马斯克亲自上车直播特斯拉基于端到端全神经网络的FSD已经过去六个月的时间了。

或许是因为马斯克当时选择的路线和场景有些简单,而且,在短短的半个小时里出现过低级错误和接管,又或许刚刚开始预研,还没有可以拿出可量产的端到端方案,这几个月本土车企在做智驾宣传时,宣传的依然是让人耳朵听出老茧的BEV、Transfomer、占用网络,除了少数媒体的爆料,很少有厂家公开宣传端到端。

五个月的时间过去了,特斯拉千呼万唤始出来的端到端FSD(版本为V12.1.2 Beta)终于陆续向在美公众推送了。因为还有’Beta’标识,所以,有点争议地说,V12.1.2 Beta算是特斯拉FSD技术路线转向后向大众推送的第一个端到端版本。

这个版本的实际表现如何?它又反映了哪些技术特点?今天本文就来谈上一谈。

一些博主已经上传了基于端到端的FSD白天、傍晚、夜晚在海边、郊区、市中心、停车场的测试视频。说实话,和国内头部智驾车企经常秀的包括隧道、环形高架、立交桥、繁忙交通路口的一镜到底比起来,有的不相伯仲,有的则场景过于简单。其中一位测评博主上传了包含三段行程、耗时二十多分钟的郊外行车视频,除了第一段行程前半段和第三段行程后半段的交通场景相对略复杂之外,其余行车场景都比较简单,而且,很多路口的处理风格偏保守,右转、左转的速度有些慢,有一个路口连续让行了两辆距离很远的卡车,如果是人类司机来开的话,大概率是不会让行珊珊而来的第二辆卡车的。在海边遇到了几个行人,FSD的通过速度实在太慢。当然,这个视频里有一个值得夸赞的点,在每一个STOP标识处,特斯拉都会老老实实停下来,比对交通规则充满了大大咧咧和不敬的人类司机听话多了。

图片来源:Youtube

还有另外一名视频博主上传了晚上在旧金山市中心的驾驶场景(比上个视频中的场景复杂不少),全程无接管,整个画面流畅丝滑,在城市复杂场景下的通行表现居然比郊区场景更好,这是比较出乎意外的。也许,这正说明了端到端技术路线的特点-相似场景训练得多,就表现好,训练得少,就表现差,和场景本身的简单和复杂没有太大关联。

总之,FSD V12.1.2的测评视频本身没有什么好说的,再说真的就是尬吹了。本文的重点还是技术层面,谈一谈它和国内车企方案的本质区别到底在哪里。

虽说知

识点有点老,但为了帮助大家理解,还是先简单分享一下。

在以往的技术路线中,自动驾驶系统分为感知定位、决策规划、控制执行三大模块,相比于这种分模块方案,端到端就是将这三大模块合而为一,以一个完整神经网络的形式实现。

当然,在舆论宣传上,神经网络是完整的,理论上的“端到端”就是这样,但实际上是不是一个完整的神经网络,就是各个车企压箱底的秘密了。

图片来源:高通

在感知、决策、执行三大模块中,各个模块的实现难度和技术复杂度依次递减。各个车企的感知模块大都已经完成了神经网络化,决策模块大部分还停留在规则驱动的阶段,将原本基于规则驱动的决策模块神经网络化,以端到端的形式将决策模块和感知模块形成一个大的神经网络,是端到端最为本质的特点。

怎么理解规则驱动呢?很多人都听说过那个笑话,老婆给当程序员的老公打电话,:“下班顺路买一斤包子回来,如果看到卖西瓜的,买一个。”结果,程序员老公买了一个包子回来,因为他看到了卖西瓜的。写过代码的都会会心一笑,程序员老公做的好像没错,按照Switch Case语句就是这么处理的。

从本质上,基于规则驱动的自动驾驶决策规划也是极其复杂的Switch Case,各种各样的场景可以对应到Switch Case代码各个Case中。场景越多,模块就越复杂,程序员的压力也就越大,当测试不充分或者程序员脑力Hold不住这么多Case时,自动驾驶系统就会在极个别的Case场景下出问题了。

如果把场景理解成交通场景的各种物理对象或动静态元素的时间及空间排列,就会很快地意识到,场景本身非常难以精确定义,试想一下,不同变换的交通场景会出现多少动态交通参与者,他们又会以怎样的行车轨迹表现出不一样的时空特征呢?具体到算法开发人员的编程工作,就是如何精确地用编程语言来定义这些Case?还有值得思考的第二个问题,如果驾驶场景不在已经定义的Case中怎么办?

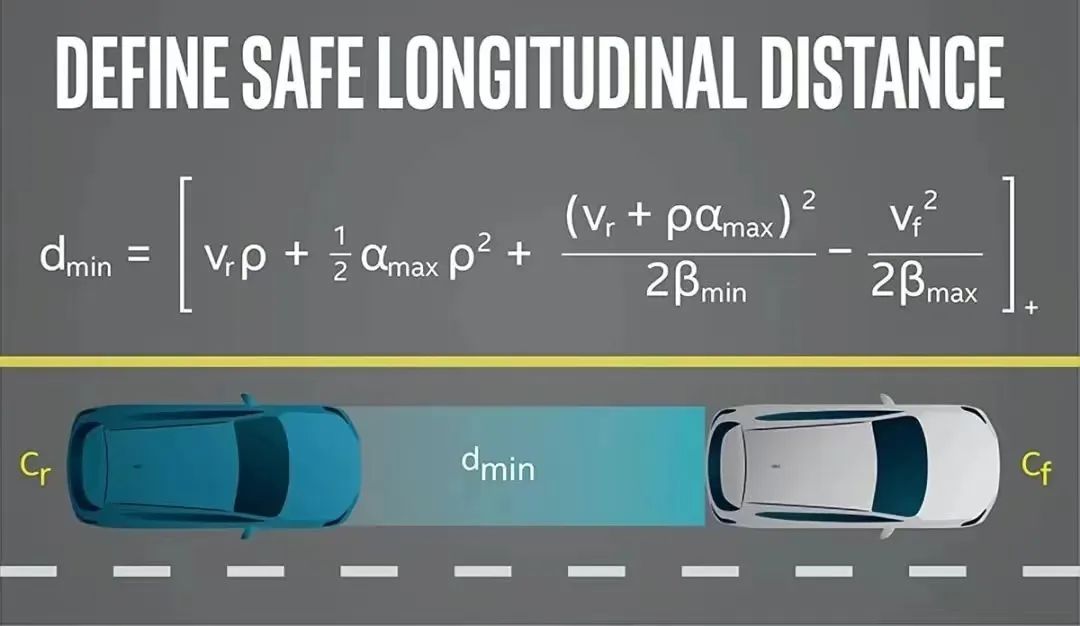

图片来源:Mobileye

第一个问题是对算法开发者而言的工作复杂度问题,第二个问题指的是算法泛化能力,这就事关自动驾驶系统的消费者和功能的实际体验者了。

怎么理解神经网络解决这两个问题的能力?先介绍一点背景知识。

面对各种各样驾驶场景下的决策规划,有规则驱动和数据驱动两种解决范式。规则驱动的方式是借助传统算法,进行手工编码,人为设计规则,像是打地鼠那样一对一地解决,出现一个新的Corner case,就针对性地编码解决它。而数据驱动的方式就是。数据驱动的方式是将决策规划神经网络化,让神经网络学习人类司机在这些复杂场景下的应对策略。

第一种方式的缺点是显而易见的,庄子曾经说过,吾生也有涯,而知也无涯,以有涯随无涯,殆已。殆已决策规划模块一旦神经网络化,繁重的编码工作消失了,面对新的长尾场景,通过带有时空信息的大量驾驶视频片段,神经网络的参数可以实时调整到逐渐逼近人类最佳的驾驶实践上,开发人员的工作相对来说就轻松多了。

算法人员的工作复杂度问题解决了,消费者的体验泛化问题呢?天大地大,客户为大,可喜的是,神经网络本身具备较强的泛化能力或者说插值能力。参照《数值分析》的曲线拟合和插值理论,对于一个未曾遇到过、但与之前训练片段相差不远的长尾场景,神经网络可以‘插值出’或‘推理出’一个合理的路径规划和驾驶决策来。当然,更多的采样点会导向更准确的曲线拟合,类比过来,训练特定长尾场景的数据,神经网络的参数本身也会进一步优化。

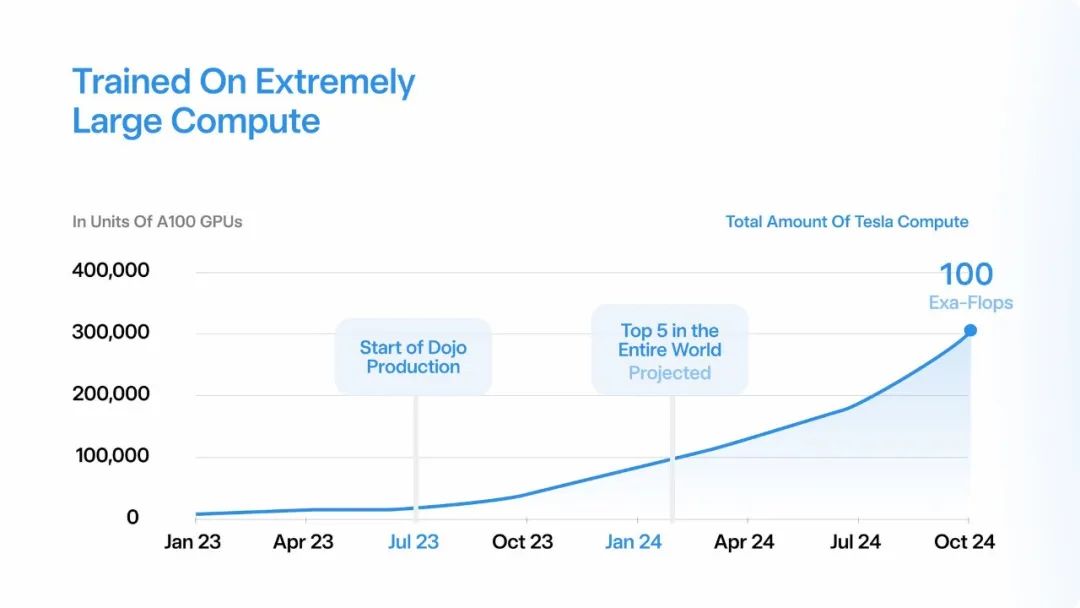

特斯拉端到端的FSD V12于2022年12月立项,依靠巨大的训练算力的支持,特斯拉在一个季度内训练了1,000万个视频片段。到了2023年4月份,V12的实际表现打动了马斯克,马老板立马追加了资源投入,也正是在同期举行的特斯拉投资者日上,马斯克宣布了要到2025年底将训练算力推高到100E的消息。

图片来源:特斯拉

一个值得思考的问题是,端到端如此巨大地消耗训练算力,而且需要天量的训练片段,不看国内车企舆论宣传的话,它们会真的转向端到端吗?

理论上,目前国内车企卷的是占用网络、BEV,为的是提高感知性能的上限,但是,感知是自动驾驶的基础,却并非自动驾驶的一切。当鸟瞰视角、占用网络这些技术触摸到天花板之后,它们应该会自然而然地把卷的战场带入到规控上面。届时,即便不全向转向端到端,规控环节也会神经网络化。

只是,不完全形式的端到端还能算端到端吗?